一种文本分类方法、系统、终端以及存储介质

文献发布时间:2023-06-19 09:57:26

技术领域

本发明涉及自然语言处理技术领域,具体地,涉及一种基于有向图卷积神经网络的文本分类方法、系统、终端以及存储介质。

背景技术

深度学习在计算机视觉以及自然语言处理两个领域取得了巨大的成功,尤其是卷积神经网络。但是卷积神经网络的研究对象还是限制在欧几里德的数据上,它们都具有规则的空间结构。但是现实生活中存在很多数据并不具备规则的空间结构,其中包括图的结构。图的结构一般来说是十分不规则的,可以认为是无限维的一种数据,所以没有平移不变性。每一个节点周围结构可能是独一无二的,这种结构的数据让传统的深度学习框架失效。而图卷积神经网络是一种新颖的能对图结构数据进行学习的方法,可以通过图谱的结构对这种不规则的数据进行信息处理。

在目前的图卷积神经网络对非结构化的数据进行处理中,不能很好的把握节点之间的方向信息,仅仅是对节点之间的连接关系进行了关注,而丢失了节点之间的正向与逆向上的差异。上述这种情况会大大降低对节点信息的判断,且对很对带有方向的图结构数据无法处理,降低网络的性能,以及适用的范围。

经过检索发现,中国发明专利申请公开号为CN110929029A,公开日为2020年3月27日公开了一种基于图卷积神经网络的文本分类方法及系统,对于目标领域的文本训练集中的每一已类别标注文本,根据该文本中词的词频、逆文档率生成该文本的文本特征向量;将各文本特征向量组合生成一文本特征矩阵,即TF-IDF矩阵,并根据词的词向量相似度构建一该文本训练集的图结构;利用所述图结构及文本特征矩阵训练图卷积神经网络;对于该目标领域的一待分类文本a,将该文本a的文本特征向量输入训练后的图卷积神经网络,得到该文本a的类别。该发明考虑了到文本的语义结构信息,而且从另一个角度捕捉文本的隐藏特征,分类准确性高。但该专利由于没有考虑图中信息流向(连接方向),对于图形数据,分类准确性差。

发明内容

本发明针对现有技术中存在的上述不足,提供了一种基于有向图卷积神经网络的文本分类方法、系统、终端以及存储介质。

根据本发明的一个方面,提供了一种文本分类方法,包括:

将每个文本作为一个节点,获取多个节点构建节点网络;

根据所述节点网络中的连接方向,构建第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵,所述第一方向和所述第二方向互为相反方向;

将每个所述节点对应文本中的词汇信息转化为词向量,再统一为相同长度的文本特征向量,形成节点矩阵;

将所述第一方向拉普拉斯矩阵、所述第二方向拉普拉斯矩阵以及所述节点矩阵进行融合,对未知类型的所述节点进行信息判断,得到文本分类结果。

优选地,所述获取多个节点构建节点网络,包括:

获取多个节点,根据所述节点之间的连接信息构建节点网络;

其中,所述节点之间的连接信息是指:所述节点之间的直接连接关系以及多个所述节点是否具有名称相同的下属节点。

优选地,每一个所述节点网络中:包括至少一个下属节点以及存在直接连接关系的两个节点;其中,采用有向的连接信息进行表示不同节点之间的直接连接关系。

优选地,根据所述节点网络中的连接方向,构建第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵,包括:

根据所述节点网络中的已知连接方向,构建第一方向邻接矩阵和第二方向邻接矩阵;

利用所述第一方向邻接矩阵、所述第二方向邻接矩阵分别构建第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵。

优选地,根据所述节点网络中的已知连接方向,构建第一方向邻接矩阵和第二方向邻接矩阵,包括:

根据所述节点网络中的节点之间的不同关系表示,搭建方向相反的第一方向邻接矩阵和第二方向邻接矩阵,其中,第一方向邻接矩阵和第二方向邻接矩阵为对称的方阵。

优选地,利用所述第一方向邻接矩阵、所述第二方向邻接矩阵分别构建第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵,其中:

根据方向相反的所述第一方向邻接矩阵、第二方向邻接矩阵中节点之间的第一方向和第二方向的信息传递关系,分别建立第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵。

优选地,将每个所述节点对应文本中的词汇信息转化为词向量,包括:

使用预先训练得到的预训练语言模型,将每个所述节点对应文本中的词汇表示为含有该词汇特征信息的词向量,将所述词向量进行拼接,组成文本矩阵。

优选地,所述再统一为相同长度的文本特征向量,形成节点矩阵,包括:

采用图卷积神经网络对用词向量表示的所述文本矩阵进行卷积运算,得到词编码的向量信息;

对所述词编码的向量信息进行编码,得到相同长度的文本特征向量,用以表示每个节点的信息,所有文本特征向量构成节点矩阵。

优选地,所述将所述第一方向拉普拉斯矩阵、所述第二方向拉普拉斯矩阵以及所述节点矩阵进行融合,对所述节点进行信息判断,包括:

将所述第一方向拉普拉斯矩阵、所述第二方向拉普拉斯矩阵中的节点之间的关系与所述节点矩阵中对应节点的信息做卷积运算进行融合,在直接相连或间接相连的所述节点之间进行信息传递,根据已知的部分节点的类型判断未知节点的类型。

根据本发明的另一个方面,提供了一种文本分类系统,包括:

节点网络构建模块,该模块将每个文本作为一个节点,获取多个节点构建节点网络;

矩阵构建模块,该模块根据所述节点网络构建模块得到的节点网络中的连接方向,构建第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵,所述第一方向和所述第二方向为相反方向;

文本特征向量获取模块,该模块将每个所述节点对应文本中的词汇信息转化为词向量,再统一为相同长度的文本特征向量,形成节点矩阵;

融合判断模块,该模块将所述矩阵构建模块得到的第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵以及所述文本特征向量获取模块得到的节点矩阵进行融合,对未知类型的所述节点进行信息判断,得到文本分类结果。

优选地,所述节点网络构建模块,将非结构化的图数据转化为相应的节点之间的关系网络,即节点网络。

优选地,所述矩阵构建模块,通过构建第一方向与第二方向两个邻接矩阵对具有方向信息的关系表达在节点网络中,其中,第一方向和第二方向两个邻接矩阵为对称的矩阵;将第一方向、第二方向邻接矩阵与单位矩阵进行矩阵运算,将节点之间的关系信息融合至拉普拉斯矩阵中,即构建了第一方向和第二方向两个拉普拉斯矩阵。其中,单位矩阵是指主对角线上的元素都为1,其余元素全为0的n阶矩阵。

优选地,所述文本特征向量获取模块,将文本中的单词通过预训练语言模型转化为相同维度的词向量,再通过图卷积神经网络,将由不同词向量表示的文本统一为相同长度的文本特征向量表示节点的信息,构成节点矩阵。

优选地,所述融合判断模块,将双向拉普拉斯矩阵中的节点之间的关系,与节点矩阵中的节点信息进行融合,从而对未知的节点进行判断与分类,进而得到需要判断的文本类型。

根据本发明的第三个方面,提供了一种终端,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时可用于上述任一项所述的方法。

根据本发明的第四个方面,提供了一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时可用于执行上述任一项所述的方法。

由于采用了上述技术方案,本发明与现有的技术相比,具有如下有益效果:

本发明提供的文本分类方法、系统、终端以及存储介质,基于有向图卷积神经网络,不仅可以处理非结构化的图形数据,而且可以对图形数据(图形数据由节点组成)中的有向图信息进行考虑,使得文本分类的结果具有更高的准确度,适用于更多的带有方向性的图结构数据中。

附图说明

通过阅读参照以下附图对非限制性实施例所作的详细描述,本发明的其它特征、目的和优点将会变得更明显:

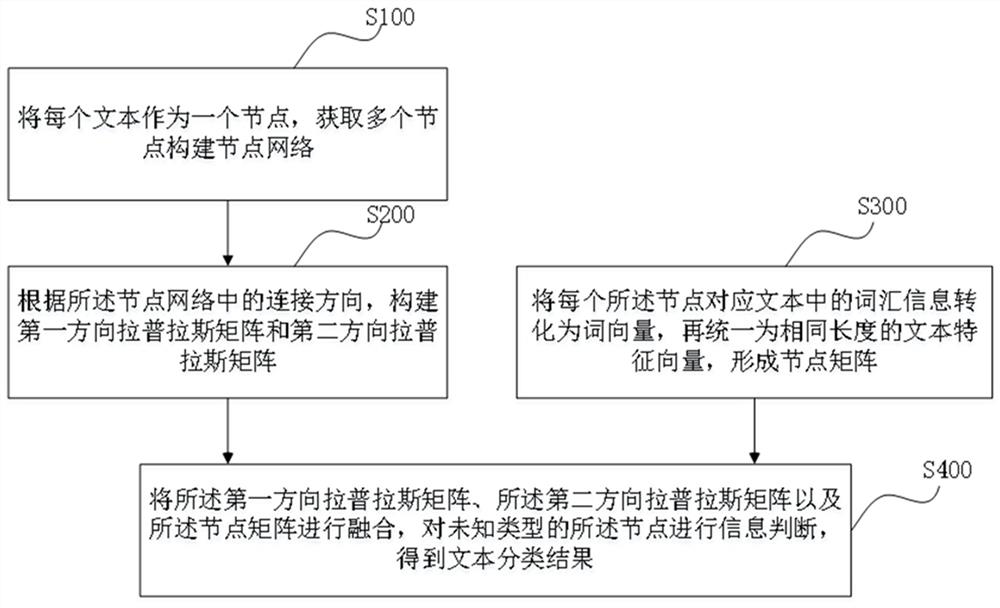

图1为本发明一实施例中文本分类方法流程图;

图2为本发明一优选实施例中文本分类方法流程图;

图3为本发明一优选实施例中节点网络构建模块的工作示意图;

图4为本发明一优选实施例中矩阵构建模块构建双向邻接矩阵的工作示意图;其中,(a)为正向邻接矩阵,(b)为反向邻接矩阵;

图5为本发明一优选实施例中矩阵构建模块构建双向拉普拉斯矩阵的工作示意图;其中,(a)为正向邻接矩阵,(b)为反向邻接矩阵,(c)为正向拉普拉斯矩阵,(d)为反向拉普拉斯矩阵;

图6为本发明一优选实施例中通过词向量构建文本信息的文本信息向量表示模块工作示意图;

图7为本发明一优选实施例中融合判断模块的工作示意图;

图8为本发明一实施例中文本分类系统的组成模块示意图。

具体实施方式

下面将详细描述本发明的各个方面的特征和示例性实施例。在下面的详细描述中,提出了许多具体细节,以便提供对本发明的全面理解。但是对于本领域技术人员来说很明显的是,本发明可以在不需要这些具体细节中的一些细节的情况下实施。下面对实施例的描述仅仅是为了通过示出本发明的示例来提供对本发明的更好的理解。本发明决不限于下面所提出的任何具体配置和算法,而是在不脱离本发明的精神 的前提下覆盖了元素、部件和算法的任何修改、替换和改进。在附图和下面的描述中,没有示出公知的结构和技术,以便避免对本发明造成不必要的模糊。

图1为本发明一实施例中文本分类方法的流程图。

参照图1所示,该实施例中文本分类方法,可以包括以下步骤:

S100,将每个文本作为一个节点,获取多个节点构建节点网络;

S200,根据节点网络中的连接方向,构建第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵,第一方向和第二方向互为相反方向;

S300,将每个节点对应文本中的词汇信息转化为词向量,再统一为相同长度的文本特征向量,形成节点矩阵;

S400,将第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵以及节点矩阵进行融合,对未知类型的节点进行信息判断,得到文本分类结果。

本发明上述实施例解决了:当前已经存在的非结构化数据中的文本分类方法中存在的对节点之间的方向性信息获取不足,尤其是对于文本之间引用与被引用关系的提取不足,缺乏方向性的信息融合等问题。对于具有方向性的信息传递有了更好选择性汇聚,使得分类具有更高的精确性。

作为一优选实施例,S100中,获取多个节点构建节点网络,包括:获取多个节点,根据节点之间的连接信息构建节点网络;其中,节点之间的连接信息是指:节点之间的直接连接关系以及多个节点是否具有名称相同的下属节点。

作为一优选实施例,每一个节点网络中:包括至少一个下属节点以及存在直接连接关系的两个节点;其中,采用有向的连接信息进行表示不同节点之间的直接连接关系。

作为一优选实施例,S200中,根据节点网络中的连接方向,构建第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵,包括:根据节点网络中的已知连接方向,构建第一方向邻接矩阵和第二方向邻接矩阵;利用第一方向邻接矩阵、第二方向邻接矩阵分别构建第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵。

作为一优选实施例,根据节点网络中的已知连接方向,构建第一方向邻接矩阵和第二方向邻接矩阵,包括:根据节点网络中的节点之间的不同关系表示,搭建方向相反的第一方向邻接矩阵和第二方向邻接矩阵,其中,第一方向邻接矩阵和第二方向邻接矩阵为对称的方阵。

作为一优选实施例,利用第一方向邻接矩阵、第二方向邻接矩阵分别构建第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵,其中:根据方向相反的第一方向邻接矩阵、第二方向邻接矩阵中节点之间的第一方向和第二方向的信息传递关系,分别建立第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵。

作为一优选实施例,S300中,将每个节点对应文本中的词汇信息转化为词向量,包括:使用预先训练得到的预训练语言模型,将每个节点对应文本中的词汇表示为含有该词汇特征信息的词向量,将词向量进行拼接,组成文本矩阵。

作为一优选实施例,S300中,再统一为相同长度的文本特征向量,形成节点矩阵,包括:采用图卷积神经网络对用词向量表示的文本矩阵进行卷积运算,得到词编码的向量信息;对词编码的向量信息进行编码,得到相同长度的文本特征向量,用以表示每个节点的信息,所有文本特征向量构成节点矩阵。

作为一优选实施例,S400中,将第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵以及节点矩阵进行融合,对节点进行信息判断,包括:将第一方向拉普拉斯矩阵、第二方向拉普拉斯矩阵中的节点之间的关系与节点矩阵中对应节点的信息做卷积运算进行融合,在直接相连或间接相连的节点之间进行信息传递,根据已知的部分节点的类型判断未知节点的类型。

在本发明上述各实施例中,一个节点表示一个文本,而节点的类型也就表示文本的类型。本实施例主要目的是通过一些已知节点类型,判断一些未知节点的类型,也就是已知部分文本类型,判断未知文本的类型。节点分类是通过图网络这种方式,学习节点之间的关系,通过对未知节点附近的已知节点类型,判断出未知节点的类型,也就是得到节点所对应的文本类型。

本发明上述各优选实施例,使用两个关系矩阵对文本间已有的关系构建邻接矩阵,分别表示正向和反向关系;用邻接矩阵生成可用于特征值分解的正向和反向拉普拉斯矩阵;通过拉普拉斯矩阵对特征向量信息的聚合;通过聚合的信息对所需要的文本进行分类;采用正反关系矩阵进行节点信息总和,用以表示图中信息流向,对于具有方向性的信息传递有了更好选择性汇聚,使得分类具有更高的精确性。该方法可应用于带有方向性的图形结构数据的分类。

图2为本发明一优选实施例中的文本分类方法流程图。

参照图2所示,该优选实施例中的文本分类方法,可以包括如下步骤:

S0,将每一个文本作为一个节点,获取多个节点;

S1a,根据节点之间具有方向性的连接信息,构建节点网络;

S1b,将节点中的词汇信息,通过预训练语言模型转化为词向量,形成采用词向量表示的节点;

S2a,根据节点网络中的已知方向,构建正向和反向的邻接矩阵;

S2b,将采用词向量表示的节点通过图卷积神经网络,统一为相同长度的文本信息向量,形成节点矩阵;

S3,根据正向和反向的邻接矩阵,构建正向和反向的拉普拉斯矩阵;

S4,对得到的双向拉普拉斯矩阵以及节点矩阵进行融合,对未知节点进行信息判断,通过相邻已知节点的类型,分类得到需要判断的文本类型。

本发明上述优选实施例使用大规模预训练语言模型进行文本特征向量表示;将长文本的特征向量表示通过循环神经网络(图卷积神经网络)进行语义的压缩;使用两个关系矩阵对文本间已有的关系构建邻接矩阵,分别表示正向和反向关系;用邻接矩阵生成可用于特征值分解的正向和反向拉普拉斯矩阵;通过拉普拉斯矩阵对特征向量信息的聚合;通过聚合的信息对所需要的文本进行分类;采用正反关系矩阵进行节点信息总和,用以表示图中信息流向,对于具有方向性的信息传递有了更好选择性汇聚,使得分类具有更高的精确性。

作为一优选实施例,S1a包括:根据节点之间的直接关联关系以及多个节点是否具有名称相同的下属对象,构建节点网络。

作为一优选实施例,每一个节点网络均包括至少一个下属节点,两个节点之间存在直接关联关系;根据不同节点之间的关系,采用有向的连接信息表示不同节点之间的关系。

作为一优选实施例,S2a包括:根据所构建节点网络中的节点之间的不同关系表示,搭建具有方向性的正向和反向邻接矩阵,其中,搭建的邻接矩阵为对称的方阵。

作为一优选实施例,S3包括:根据所构建的正向和反向的邻接矩阵中节点之间的正向和反向的信息传递关系,建立正向和反向的拉普拉斯矩阵。

作为一优选实施例,S1b包括:使用通过大型语料库训练得到的预训练语言模型,将文本中的词汇,表示为对应的含有特征信息的词向量形式;将表示的词向量进行拼接,组成文本矩阵。

作为一优选实施例,S2b包括:通过卷积神经网络,对用词向量表示的文本矩阵,进行卷积运算,得到词编码的向量信息;对词编码的向量信息进行编码,得到文本特征向量,用以表示每个节点的信息,所有文本特征向量构成节点矩阵。

作为一优选实施例,S4包括:将双向拉普拉斯矩阵与对应的节点矩阵做卷积运算,进行节点之间的信息传递,将直接相连或间接相连间的节点信息进行传递,通过相邻已知类型的节点,分类得到需要判断的文本类型。

在步骤S1a中,根据节点之间的直接关联关系以及多个节点是否具有名称相同的下属对象,构建节点网络。参照图3所示 ,其中,每个节点网络中,都至少有一个下属节点、存在直接关联关系的两个节点,并且根据不同节点之间的直接关联关系,用有向的连接信息进行表示。

在步骤S2a中,根据所获的节点关系,根据不同的节点关系,搭建具有方向性的邻接矩阵,邻接矩阵为对称的方阵。正向和反向的邻接矩阵上对应的点(i,j)分别表示节点Ai到Aj以及Aj到Ai的不同信息传递关系。参照图4中(a)和(b)所示,根据节点之间的连接关系,建立起的对应的邻接矩阵。

在步骤S3中,通过构建的正向和反向的邻接矩阵,对节点之间的正向和反向的信 息传递关系建立正向和反向的拉普拉斯矩阵,而两个拉普拉斯矩阵

其中,i=1,2分别表示正向和反向邻接矩阵,D表示的是度矩阵,

在步骤S1b中,通过使用在大型语料库训练得到的预训练语言模型,将文本中的字,表示为对应的向量形式。

在步骤S2b中,通过图卷积神经网络,对用词向量表示的文本矩阵(即节点),进行卷积运算。将词编码的向量信息进行编码。将文本信息用向量的信息表示,构成文本特征向量,用以表示每个节点的信息。参照图6所示,将用词向量表示的文本信息矩阵,通过图卷积神经网络,表示为对应的文本特征向量。一个文本特征向量对应节点矩阵中的一个节点,所有文本特征向量构成节点矩阵。

在步骤S4中,将双向拉普拉斯矩阵与对应的节点矩阵做卷积运算,进行节点之间的信息传递,将直接相连或间接相连间的节点信息进行传递,对需要分类的节点(未知节点)进行分类。参照图7所示,具体通过以下方式实现节点分类:

一个节点表示一个文本,而节点的类型也就表示文本的类型。主要目的是通过一些已知节点类型,判断一些未知节点的类型,也就是已知部分文本类型,判断未知文本的类型。节点分类是通过图网络这种方式,学习节点之间的关系,通过对未知节点附近的已知节点类型,判断出未知节点的类型,也就是得到节点所对应的文本类型。

经过具体实际实验,基于有向图卷积神经网络的文本分类方法,对一些图结构文本信息进行分类时,能较好的完成分类,具有较高的准确度。

如图8所示,本发明另一实施例提供了一种基于有向图卷积神经网络的文本分类系统,包括:

节点网络构建模块,该模块将每个文本作为一个节点,获取多个节点构建节点网络;

矩阵构建模块,该模块根据节点网络构建模块得到的节点网络中的连接方向,构建第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵,第一方向和第二方向为相反方向;

文本特征向量获取模块,该模块将每个节点对应文本中的词汇信息转化为词向量,再统一为相同长度的文本特征向量,形成节点矩阵;

融合判断模块,该模块将矩阵构建模块得到的第一方向拉普拉斯矩阵和第二方向拉普拉斯矩阵以及文本特征向量获取模块得到的节点矩阵进行融合,对未知类型的节点进行信息判断,得到文本分类结果。

作为一优选实施例,节点网络构建模块,将非结构化的图数据转化为相应的节点之间的关系网络,即节点网络。

作为一优选实施例,矩阵构建模块,通过构建第一方向与第二方向两个邻接矩阵对具有方向信息的关系表达在节点网络中,其中,第一方向和第二方向两个邻接矩阵为对称的矩阵;将第一方向、第二方向邻接矩阵与单位矩阵进行矩阵运算,将节点之间的关系信息融合至拉普拉斯矩阵中,即构建了第一方向和第二方向两个拉普拉斯矩阵。其中,单位矩阵是指主对角线上的元素都为1,其余元素全为0的n阶矩阵。

作为一优选实施例,文本特征向量获取模块,将文本中的单词通过预训练语言模型转化为相同维度的词向量,再通过图卷积神经网络,将由不同词向量表示的文本统一为相同长度的文本特征向量表示节点的信息,构成节点矩阵。

作为一优选实施例,融合判断模块,将双向拉普拉斯矩阵中的节点之间的关系,与节点矩阵中的节点信息进行融合,从而对未知的节点进行判断与分类,进而得到需要判断的文本类型。

在本发明部分实施例中:

节点网络构建模块与矩阵构建模块相连,将非结构化的图装数据转化为相应的节点之间的关系矩阵。

矩阵构建模块,通过正向与反向两个邻接矩阵对具有方向信息的关系表达在矩阵中,将双向的邻接矩阵与单位矩阵进行矩阵运算,将节点之间的信息融合与拉普拉斯矩阵中,且构建了正向和反向两个拉普拉斯矩阵。

文本特征向量获取模块,将文本中的单词通过大型的预训练模型转化为相同维度的词向量,再通过深度学习中的编码器,将由不同单词向量构成的文本表示为相同长度的向量。

融合判断模块和文本特征向量获取模块以及矩阵构建模块相连,通过节点之间的连接关系,对与融合的节点信息进行融合,从而对未知的节点信息进行判断与分类,得到需要分类的文本类型。

本发明上述实施例所提供的系统,其工作过程为:

(1)在节点网络构建模块获取节点之间的具有方向性的连接信息,传输到矩阵构建模块,生成包含节点之间连接信息的邻接矩阵。同时在文本特征向量获取模块中将文本中词汇,通过大型语料库训练的预训练模型转化为词向量。

(2)通过矩阵构建模块生成双向关系矩阵,并生成正向和反向两个拉普拉斯矩阵。同时通过文本特征向量获取模块,将用数量不同的词向量表示的文本,统一成相同长度的信息向量。

(3)通过融合判断模块对输入的双向拉普拉斯矩阵以及文本信息向量做融合,对所需节点的信息进行融合,判断、分类,得出需要判断的文本类型。

本发明另一实施例中,提供了一种终端,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,处理器执行程序时可用于本发明上述实施例中任一项的方法。

可选地,存储器,用于存储程序;存储器,可以包括易失性存储器(英文:volatilememory),例如随机存取存储器(英文:random-access memory,缩写:RAM),如静态随机存取存储器(英文:static random-access memory,缩写:SRAM),双倍数据率同步动态随机存取存储器(英文:Double Data Rate Synchronous Dynamic Random Access Memory,缩写:DDR SDRAM)等;存储器也可以包括非易失性存储器(英文:non-volatile memory),例如快闪存储器(英文:flash memory)。存储器用于存储计算机程序(如实现上述方法的应用程序、功能模块等)、计算机指令等,上述的计算机程序、计算机指令等可以分区存储在一个或多个存储器中。并且上述的计算机程序、计算机指令、数据等可以被处理器调用。

上述的计算机程序、计算机指令等可以分区存储在一个或多个存储器中。并且上述的计算机程序、计算机指令、数据等可以被处理器调用。

处理器,用于执行存储器存储的计算机程序,以实现上述实施例涉及的方法中的各个步骤。具体可以参见前面方法实施例中的相关描述。

处理器和存储器可以是独立结构,也可以是集成在一起的集成结构。当处理器和存储器是独立结构时,存储器、处理器可以通过总线耦合连接。

本发明第四个实施例提供了一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时可用于执行本发明上述实施例中任一项的方法。

本发明上述实施例提供的文本分类方法、系统、终端以及存储介质,采用正反关系矩阵进行节点信息总和,用以表示图中信息流向,对于具有方向性的信息传递有了更好选择性汇聚,使得分类具有更高的精确性。

需要说明的是,本发明提供的方法中的步骤,可以利用系统中对应的模块、装置、单元等予以实现,本领域技术人员可以参照系统的技术方案实现方法的步骤流程,即,系统中的实施例可理解为实现方法的优选例,在此不予赘述。

本领域技术人员知道,除了以纯计算机可读程序代码方式实现本发明提供的系统及其各个装置以外,完全可以通过将方法步骤进行逻辑编程来使得本发明提供的系统及其各个装置以逻辑门、开关、专用集成电路、可编程逻辑控制器以及嵌入式微控制器等的形式来实现相同功能。所以,本发明提供的系统及其各项装置可以被认为是一种硬件部件,而对其内包括的用于实现各种功能的装置也可以视为硬件部件内的结构;也可以将用于实现各种功能的装置视为既可以是实现方法的软件模块又可以是硬件部件内的结构。

以上对本发明的具体实施例进行了描述。需要理解的是,本发明并不局限于上述特定实施方式,本领域技术人员可以在权利要求的范围内做出各种变形或修改,这并不影响本发明的实质内容。

- 一种文本分类方法、系统、终端以及存储介质

- 一种文本分类方法、装置、终端及存储介质