基于迁移学习和视觉词包的遥感样本分类方法

文献发布时间:2023-06-19 18:27:32

技术领域

本发明涉及一种遥感样本分类方法,尤其涉及一种基于迁移学习和视觉词包 的遥感样本分类方法,属于遥感图像分类领域。

背景技术

随着遥感技术的发展,空间、时间分辨率的提高,遥感图像,尤其是高空间 分辨率遥感图像数据量急速增加,使得图像中土地利用场景包含多种类型的土地 覆盖类型。在这种情况下,利用人工目视解译的方法进行遥感图像土地利用场景 的分类需要大量时间和工作量,有限的专家也不能及时对海量数据进行处理。鉴 于目视解译存在的不足,利用计算机技术进行自动化、智能化的土地利用场景分 类成为当前遥感领域的一个研究热点。

针对遥感图像土地利用场景的分类,传统的方法通常采用颜色、纹理、形状 等低层特征建立遥感图像土地利用场景模型,利用分类器对场景的高层信息进行 推导。然而,采用基于低层特征描述的土地利用场景分类方法由于缺乏中间语义 的图像表示,所以泛化性差,很难用于处理训练集以外的场景图像。为了克服遥 感图像低层视觉特征与高层语义之间的鸿沟,基于中层特征对土地利用场景语义 建模描述的方法逐渐得到广泛的关注。尤其是近年来的视觉词包( bag-of-visual-words,BOVW)模型在图像分析和图像分类的应用中取得了巨大成 功,成为一种新的、有效的图像内容表达的研究思路,并在遥感图像土地利用场 景分类中取得了一定成果。视觉词包模型的优点在于无需分析场景图像中的具体 目标组成,而是应用图像场景的整体统计信息,将量化后的图像低层特征视为视 觉单词,通过图像的视觉单词分布来表达图像场景内容,为图像的场景分类提供 基础数据。

基于视觉词袋模型的图像分类系统主要由四个部分组成,分别为:图像特征 提取、视觉词典生成、视觉词汇特征构建和分类器。其中视觉词典的优劣直接影 响着系统的性能表现,如何构建区分性好、表达能力强的视觉词典成为近些年来 基于视觉词包模型的图像分类研究的重点。根据视觉词典的生成过程中是否利用 训练集中已知类别标注等信息,可将视觉词典生成方式分为两类:无监督生成视 觉词典和有监督生成视觉词典。而由于引入了额外信息对视觉词典的生成过程进 行监督,有监督方法生成的视觉词典的性能通常要比无监督的好。但有监督方法 生成视觉词典同样存在缺点:一是计算复杂度高,有监督方法通常对应求解一个 最优化问题,需要精心设计快速、有效的迭代算法;二是需要大量已标注好样本 完成训练过程,但人工标注成本很高,标注的质量也参差不齐。

发明内容

基于上述技术问题,本发明提出一种基于迁移学习和视觉词包的遥感样本分 类方法,利用迁移学习算法将前期影像丰富的标签信息和知识迁移到当前样本集 ,并采用视觉词包模型对包含标签语义信息的样本集进行场景分类,得到的场景 分类模型准确率更高。

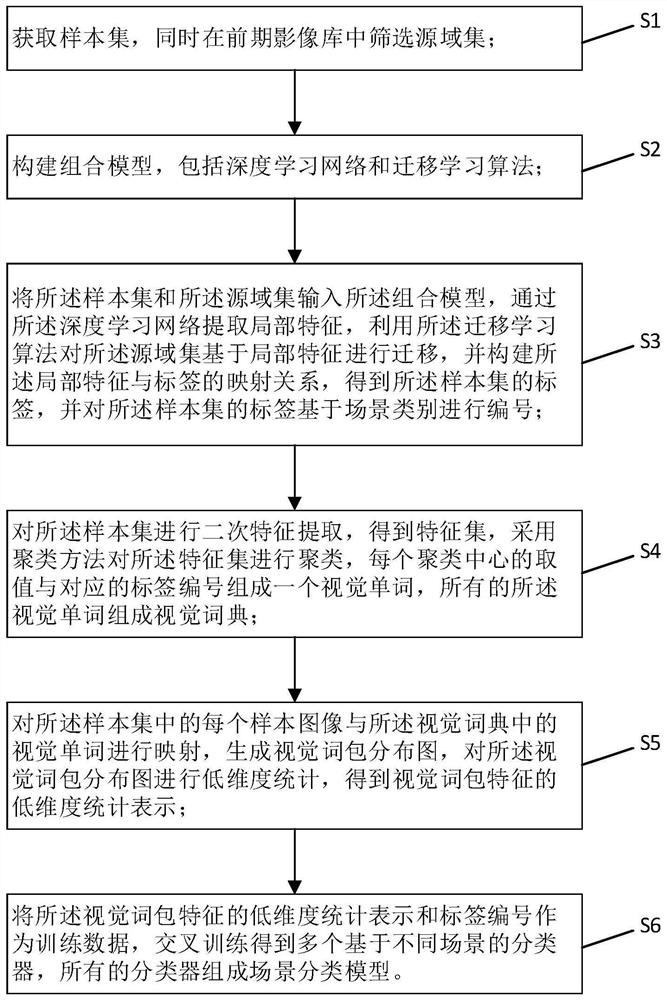

本发明提供一种基于迁移学习和视觉词包的遥感样本分类方法,该方法 包括:

S1获取样本集,同时在前期影像库中筛选源域集;

S2构建组合模型,包括深度学习网络和迁移学习算法;

S3将所述样本集和所述源域集输入所述组合模型,通过所述深度学习 网络提取局部特征,利用所述迁移学习算法对所述源域集基于局部特征进行 迁移,并构建所述局部特征与标签的映射关系,得到所述样本集的标签,并 对所述样本集的标签基于场景类别进行编号;

S4对所述样本集进行二次特征提取,得到特征集,采用聚类方法对所 述特征集进行聚类,每个聚类中心的取值与对应的标签编号组成一个视觉单 词,所有的所述视觉单词组成视觉词典;

S5对所述样本集中的每个样本图像与所述视觉词典中的视觉单词进行 映射,生成视觉词包分布图,对所述视觉词包分布图进行低维度统计,得到 视觉词包特征的低维度统计表示;

S6将所述视觉词包特征的低维度统计表示和标签编号作为训练数据, 交叉训练得到多个基于不同场景的分类器,所有的分类器组成场景分类模型 。

于本发明一具体实施例中,该方法还包括:

获取新样本,根据步骤S3-S5,得到新样本的视觉词包特征的低维度统 计表示;

将新样本的视觉词包特征的低维度统计表示输入所述场景分类模型,得 到新样本的场景类别。

于本发明一具体实施例中,深度学习网络为AlexNet、ResNet、VGGNet 或其它深度学习网络中的至少一项,迁移学习算法为基于特征的迁移学习算 法。

于本发明一具体实施例中,步骤S4包括:

对所述样本集中的每个样本进行密集格网采样,利用SIFT方法对每个 采样区进行二次特征提取,得到SIFT特征;

采用E

于本发明一具体实施例中,步骤S5包括:

计算每个采样区的SIFT特征与所述视觉词典中的每个视觉单词对应的 特征值之间的欧氏距离;

找出欧氏距离最小的视觉单词的编号,并将其作为相应的采样区的视觉 单词映射结果,得到每个样本图像的视觉词包分布图;

将所述视觉词包分布图作为图像进行LBP变换,得到视觉词包特征的 LBP直方图表示。

于本发明一具体实施例中,所述将所述样本集和所述源域集输入所述组 合模型,通过所述深度学习网络提取局部特征,包括:

分别将所述样本集中的样本图像和所述源域集中的样本图像输入深度 学习网络,所述深度学习网络包括第五层的池化层以及第六层和第七层的全 连接层

提取第六和第七两个全连接层的输出,得到两种不同的高层特征;

提取第五层池化层的输出,并采用主成分分析方法进行降维,得到第三 种高层特征;

将三种高层特征通过串联的形式进行特征融合,得到融合后的深度特征 向量,作为提取得到的局部特征。

于本发明一具体实施例中,所述得到所述样本集的标签,包括:

构建预测样本集D

将所述目标函数形式化为关于y和x

将所述损失函数公式化为两个模型θ

根据所述距离函数对所述期望损失进行调整,得到包含距离函数的目标 函数;

利用最大后验概率再近似积分对所述包含距离函数的目标函数进行估算, 得到估算的目标函数;

在所述估算的目标函数满足预设条件时,将所述估算的目标函数调整为 标签空间Y的参数分布

根据所述目标函数以及差异函数得到所述样本集的标签。

于本发明一具体实施例中,所述利用所述迁移学习算法对所述源域集基 于局部特征进行迁移,包括:

获取

确定

根据所述距离对所述源域集基于局部特征进行迁移。

于本发明一具体实施例中,获取

估计源域集特征空间X

根据所述源域集特征空间X

于本发明一具体实施例中,获取

估计任意样本集x′

根据所述任意样本集x′

本发明的有益效果为:提出一种基于迁移学习和视觉词包的遥感样本分类 方法,先构建一个组合模型,其中包括深度学习网络和迁移学习算法,利用 深度学习网络提取样本集和源域集的局部特征,然后利用迁移学习算法对源 域集进行基于局部特征的迁移,充分利用前期影像的标签信息和先验知识,得到 样本集的标签,并得到特征和标签之间的内在关系,之后采用视觉词包模型对包 含标签语义信息的样本集进行场景分类,其中利用丰富的标签信息,通过有监督 的方式生成视觉词典,提高了视觉词典性能,得到的多个分类器组成场景分类模 型的分类效果更好,准确率更高。

附图说明

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例 中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发 明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下 ,还可以根据这些附图获得其他的附图。

图1为本发明实施例的方法流程图。

具体实施方式

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚 、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部 的实施例。基于本发明中的实施例,本领域普通技术人员所获得的所有其他实施 例,都属于本发明保护的范围。

本发明提供一种基于迁移学习和视觉词包的遥感样本分类方法,该方法 包括:

S1获取样本集,同时在前期影像库中筛选源域集;

S2构建组合模型,包括深度学习网络和迁移学习算法;

S3将所述样本集和所述源域集输入所述组合模型,通过所述深度学习 网络提取局部特征,利用所述迁移学习算法对所述源域集基于局部特征进行 迁移,并构建所述局部特征与标签的映射关系,得到所述样本集的标签,并 对所述样本集的标签基于场景类别进行编号;

S4对所述样本集进行二次特征提取,得到特征集,采用聚类方法对所 述特征集进行聚类,每个聚类中心的取值与对应的标签编号组成一个视觉单 词,所有的所述视觉单词组成视觉词典;

S5对所述样本集中的每个样本图像与所述视觉词典中的视觉单词进行 映射,生成视觉词包分布图,对所述视觉词包分布图进行低维度统计,得到 视觉词包特征的低维度统计表示;

S6将所述视觉词包特征的低维度统计表示和标签编号作为训练数据, 交叉训练得到多个基于不同场景的分类器,所有的分类器组成场景分类模型 。

遥感影像也为遥感图像,首先获取遥感图像的样本集,该样本集中包含 多个遥感图像的样本,样本集未含有标签信息或只有其中少量的样本包含标 签信息。同时从前期影像库中筛选源域集,前期影像库里面包含大量的带有 标签信息的遥感图像,筛选的策略为:采用人工选取前期影像库中地表覆盖 类型与样本集的相似度达到70%以上的遥感图像,组成源域集。

构建组合模型,包括深度学习网络和迁移学习算法,其中深度学习网络 为AlexNet、ResNet、VGGNet或其它深度学习网络,迁移学习算法为基于特 征的迁移学习算法。

本实施例为七层深度学习网络,且已训练好,前五层分别为layer1,layer2 ,layer3,layer4和layer5,layer1,layer2和layer5分别包括卷积层和池化层 ,layer3和layer4分别只有一个卷积层,第六层和第七层为全连接层。其中 ,卷积层用于提取特征图,池化层用于对卷积层得到的特征图进行压缩,全 连接层用于将二维特征图转化为一维向量。

将样本集和源域集输入组合模型,通过深度学习网络提取局部特征。对 样本集和源域集进行局部特征提取的步骤相同,以样本集的局部特征提取为 例:

将样本集中的样本图像输入深度学习网络,提取第六和第七两个全连接 层的输出,得到两种不同的高层特征,同时,提取第五层池化层的输出,并 采用主成分分析方法进行降维,得到第三种高层特征;将三种高层特征通过 串联的形式进行特征融合,最后得到融合后的深度特征向量,作为提取得到 的局部特征。该步骤中提取得到的三种不同的高层特征涵盖的图像信息完整 并具有较强的鉴别性,将三种高层特征进行融合,融合后的深度特征向量可 进一步增强特征的表现力和鲁棒性。

本实施例的迁移学习算法为基于特征的迁移学习算法。迁移学习中的两 个重要概念为域和任务,域包括源域和目标域,任务是迁移学习的目标。将 源域和目标域分别表示为D

将目标函数形式化为一个关于y和x

其中,r=1代表“相关”的一个事件,即“y和x

式中,

其中,

利用最大后验概率再近似积分来计算式(4):

其中

式(5)中,

其中

其中

模型估计:

其中p(X

用翻译器φ来估计p(X

其中,p(X

根据翻译学习算法得到样本集的标签:基于式(10)估计一个模型

得到样本集的标签信息的同时,构建局部特征与标签之间的映射关系并 保存。即构建一个样本的局部特征与标签之间的映射关系,其映射路径表示 为:

对样本集中的每个样本进行密集格网采样,利用SIFT对每个采样区进 行再次特征提取,得到SIFT特征集,SIFT特征能够有效描述图像的局部区 域信息,对图像旋转、亮度变化和尺度变化具有不变性,对仿射变化、视角 变化和噪声也具有较强的鲁棒性。

局部特征能够表征图像的底层视觉特性,被大量用于图像内 容分析中。但是,图像局部特征大多位于高维空间,不便于进行 存储和后续计算。此外,高维向量通常还面临稀疏、噪声等“维数 灾难”问题,导致在低维空间表现良好的算法到了高维空间其性能 急剧恶化。因此,需要将图像的高维局部特征映射到低维空间, 以便于存储、索引和计算。将大量局部特征映射到低维空间,得 到局部特征对应的编码,这些编码就称为视觉单词,所有的视觉 单词构成视觉词典。

在本发明实施例中,构建视觉词典的步骤如下:

(1)将样本集的标签进行编号,将局部特征以特征值的形式进行记录 ,并更新映射表,该映射表中显示特征值-标签-标签编号的三元关系组。

(2)采用基于E

E

本实施例采用基于E

E

其中,v为d维原始数据,w是宽度值,a是由p-稳定分布函数产生的n 维随机向量,内积(a·v)对SIFT特征点进行随机映射,b对映射后的结果加上 一个偏移。w需要人为调动,b使用均匀分布随机产生,其均匀分布的范围 在[0,w]。

SIFT特征集在经过E

聚类集成是集成学习的一部分,对改善聚类性能有着重要的作用,这是 因为没有一个单一的聚类算法能够发现不同形状和不同分布的类,而不同数 据集的内部结构是不同的。聚类集成同一数据集的多个基聚类方案结合起来 ,得出一个统一的聚类方案,该方案比大多数基聚类方案的聚类质量要好。

所述聚类方法对SIFT进行聚类的步骤包括:确定聚类数目、生成E

首先通过三个有效性指标SI、DB和Wint为SIFT特征集I确定聚类数 目k。

然后生成服从高斯分布的n×k的随机矩阵A=(A

对所有的SIFT特征点进行随机映射,每个特征点x

之后用PAM算法对B的每一列聚成k类,得到的结果即对特征集的k 个划分。

最后使用聚类集成方法对k个基划分进行集成并得出最终划分。

在聚类结束后,在最终的聚类结果中获取k个类的聚类中心。

(3)将得到的k个聚类中心的取值与映射表进行比对,得到对应的标 签编号,将每个聚类中心的取值及其标签编号组成一个视觉单词,所有的视 觉单词构成视觉词典。

本发明实施例所采用的聚类方法结合了E

在构建得到视觉词典后,计算每个采样区的SIFT特征与视觉词典中的 每个视觉单词对应的特征值之间的欧氏距离,找出欧氏距离最小的视觉单词 的编号,并将其作为相应的采样区的视觉单词映射结果,即每个样本的每个 采样区都被赋予一个视觉单词编号,最后得到每一幅样本图像的视觉词包分 布图。

对视觉词包分布图作为图像进行低维度统计,得到视觉词包特征的低维 度统计表示,本实施例中低维度统计为LBP直方图统计,即对视觉词包分布 图作为图像进行LBP直方图变换,得到视觉词包特征的LBP直方图表示, 通过利用视觉词汇特征来表达图像,能降低遥感图像分类的复杂度,并对视 觉词包分布图进行LBP直方图变换,进一步提高了视觉词汇特征表达图像内 容的完整性,提升了遥感图像分类的准确率。

将视觉词包特征的低维度统计表示和标签编号作为训练数据,交叉训练 得到多个基于不同场景的分类器,本实施例中利用SVM算法进行交叉训练 ,具体为:每个标签编号表示一类场景,每类场景对应一个样本的子集合, 每两个样本的子集合之间都学习生成一个SVM分类器,得到多个基于不同 场景的SVM分类器,最终将所有的SVM分类器作为得到的场景分类模型。

获取一个新的样本,根据上述步骤得到新样本的视觉词包特征的低维度 统计表示,将其输入场景分类模型,采取投票机制对新样本的类别进行判定 :有一个SVM分类器判定新样本的视觉词包特征的低维度统计表示属于第x 类,则表示第x类获得了一票,最后得票数最多的场景类别就是该新样本图 像所属的类别。

本发明的有益效果为:提出一种基于迁移学习和视觉词包的遥感样本分类 方法,先构建一个组合模型,其中包括深度学习网络和迁移学习算法,利用 深度学习网络提取样本集和源域集的局部特征,然后利用迁移学习算法对源 域集进行基于局部特征的迁移,充分利用前期影像的标签信息和先验知识,得到 样本集的标签,并得到特征和标签之间的内在关系,之后采用视觉词包模型对包 含标签语义信息的样本集进行场景分类,其中利用丰富的标签信息,通过有监督 的方式生成视觉词典,提高了视觉词典性能,得到的多个分类器组成场景分类模 型的分类效果更好,准确率更高。

- 一种基于二维小波分解及视觉词包模型的遥感图像土地利用场景分类方法

- 一种基于二维小波分解及视觉词包模型的遥感图像土地利用场景分类方法