一种基于深度学习的超像素分割方法

文献发布时间:2023-06-19 10:00:31

技术领域

本发明属于图像处理与计算机视觉技术领域,涉及一种基于深度学习的超像素分割方法。

背景技术

超像素分割是一种图像过分割技术,它依据图像的空间、色彩、纹理等底层特征将图像快速分割为具有一定数量的子区域,相比于传统方法中的基本图像处理单元——像素,超像素更有利于局部特征的提取和结构信息的表达,并且可以大幅降低后续视觉任务的计算代价,该技术是计算机视觉研究中的一个重要课题。超像素分割技术在语义分割、光流计算、深度估计等需要获取准确目标边界和具备实时性要求的计算机视觉任务上普遍应用。

卷积神经网络中低层次的特征如色彩、梯度、纹理等有利于提取边缘,其高层次语义特征有利于捕捉目标边界。基于此优点,Jampani等在2018年ECCV上发表的论文《Superpixel Sampling Networks》和Tu等在2018年CVPR上发表的论文《LearningSuperpixels with Segmentation-Aware Affinity Loss》中均提出了基于卷积神经网络的超像素分割算法。其二者算法思路均为通过基于卷积神经网络的编码器对传统的图像空间、色彩特征进行编码,使用编码后的特征代替传统手工特征,并后接传统方法完成超像素分割任务。Yang等在2020年CVPR上发表的论文《SpixelFCN:Superpixel Segmentationwith Fully Convolutional Network》中提出了基于全卷积编解码网络的超像素分割算法,其不同于上述工作编码器与传统超像素分割算法融合的策略,超像素分割由编码器和解码器构成的卷积神经网络独立完成。

但是,上述方法各自存在弊端。上述方法提出的编码器在边界捕捉上仍然存在严重的丢失问题,同时采用传统超像素分割方法作用在高维特征上的方式极大增加了算法的计算代价;另一方面,采用基于卷积神经网络结构的解码器在解码过程中容易损失特征信息,进而造成超像素分割产生结构信息损失。

综上所述,目前基于深度学习的超像素分割算法存在的边界丢失严重、计算代价过大、结构性信息损失等问题均不利于超像素分割算法与其他计算机视觉任务相互融合,如何同时改善以上问题成为目前的研究热点。

发明内容

针对上述现有技术中存在的不足,本发明的主要目的是提供一种在目标边界捕捉、结构性信息保留和计算效率三方面同时较优的超像素分割方法。该方法基于深度学习并具备端到端训练和学习能力,作为图像预处理技术具备与其他计算机视觉任务更充分的融合能力。

本发明提供了一种基于深度学习的超像素分割方法,该方法包含以下步骤:

S1:网络模型初始化。首先选用U型编解码网络作为初始网络,所述的U型编解码网络结构由编码器和解码器两部分构成,并且在编码器和解码器相同尺度位置处具备跨层连接;

S2:网络模型过参数化。设计多分支特征提取模块,对初始网络编码器中任意层数的特征提取层进行替换,实现网络模型过参数化。该多分支特征提取模块为并行的多分支结构,该模块的输入与输出不要求为相同尺寸,其中不同分支由不同结构的卷积神经网络构成,每一分支的输入彼此相同,每一分支的输出尺寸彼此相同,并且每一分支具备一个初始化的可学习权重,不同分支的输出通过各自分支的可学习权重进行逐元素相加,后接批归一化和激活函数,进而构成并行的多分支特征提取结构;

S3:网络剪枝。对通过利用多分支特征提取模块替换初始网络编码器中任意层数的特征提取层得到的过参数化网络进行训练,至损失函数曲线趋于平缓时停止训练,此时网络模型具备超像素分割能力。依据训练迭代次数、学习率和可学习权重的初始化值设定剪枝阈值。根据学习到的网络模型参数,对每一个多分支特征提取模块的每一分支进行剪枝判断,完成过参数化网络剪枝,得到针对超像素分割任务的编码器。网络剪枝策略为根据训练得到的网络模型参数,针对多分支特征提取模块中的每一分支,当该分支对应的可学习权重小于设定的阈值时,剪去该分支,反之保留该分支,当所有分支权重均小于阈值时,仅保留权值最大的分支;

S4:网络解码强化。在网络剪枝之后的解码器结构上添加跨层特征融合,实现由上至下,再由下至上的解码结构,其强化后的解码器简称为TDT(Top-down-top)解码器。所述的跨层特征融合位于U型编解码网络由上至下解码阶段之后,用于实现由微至广的跨尺度特征融合,进而提升原尺度特征图质量,其跨尺度特征融合过程为由下至上的解码结构。所述的跨尺度特征融合具体操作为:在U型编解码网络原有框架下,将解码器前端大感受野下的任意一层的输出特征进行上采样后,与解码器后端原尺度网络层的输出特征进行拼接并后接卷积操作,实现两层间跨尺度的信息融合,实现网络解码强化,并后接卷积和Softmax激活函数,进而实现基于概率形式的超像素分割结果计算。通过串联U型编解码网络由上至下的解码结构和跨尺度特征融合由下至上的解码结构,实现了由上至下,再由下至上的TDT解码器整体解码结构的构建;

S5:网络模型训练,并利用训练完成的模型对图像进行超像素分割。对经过上述步骤s1到s4后得到的网络选择后的编码器和具备TDT解码结构的解码器组成的编解码网络进行训练,至损失函数完全收敛时停止训练,得到训练后的模型参数,并以此模型参数计算超像素分割结果。

有益效果

本发明由于采用了上述方法,同现有技术相比,具有以下优点:

1)本发明中提出的网络过参数化方法,在不改变编码器本身网络结构的基础上,可以根据人工经验添加多种特征提取模块,丰富网络的搜索空间,使编码器自身具备提取更适合超像素分割任务特征的能力;

2)本发明中提出的网络搜索策略可以有效筛选多分支特征提取模块中的有效分支,在减轻网络的过拟合的同时保留住适合超像素分割任务的特征提取分支,促使编码器提取到更有力的编码特征,进而可以增强编码器的边界捕捉能力,促进超像素分割结果的边界准确性;

3)本发明中提出的TDT型解码器采用自上而下,再自下而上的解码结构。该结构避免了自上而下解码结构在大感受野位置进行特征解码时,由于感受野过大造成解码误差,进而影响后续的超像素分割结果;反之,在自下而上解码结构中,解码器在小感受野位置进行特征解码时,由于解码信息过于局部产生解码误差,进而影响后续的超像素分割结果。本发明提出的解码器通过自下而上,再自上而下的TDT型解码结构实现由广入微,再由微至广的特征解码,可以有效避免上述问题,进而超像素分割结果具备更好的结构保留能力;

4)本发明提出的基于深度学习的超像素分割方法给其他视觉任务提供了一种计算速度快,边界捕捉准确,结构性信息保留充分的超像素分割图像预处理技术。

附图说明

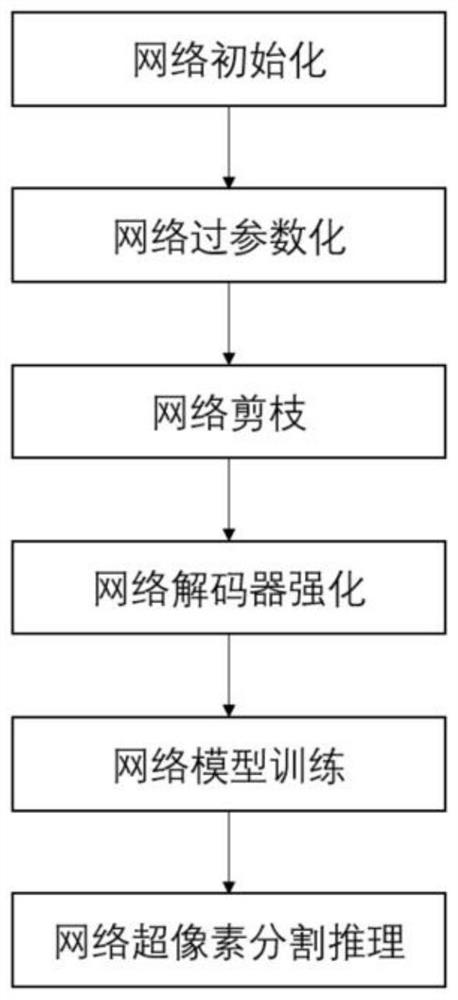

图1为本发明方法流程图;

图2为本发明所述实施例中基于SpixelFCN构建的初始化U型编解码网络结构示意图;

图3为本发明所述实施例的过参数化网络结构示意图;

图4为本发明中多分支特征提取模块的结构示意图;

图5为本发明所述实施例多分支特征提取模块中的各分支操作示意图;

图6为本发明所述实施例最终进行超像素分割推理的编解码网络结构示意图;

图7(a)为本发明所属实施例的超像素数目-ASA分数曲线;

图7(b)为本发明所属实施例的边界召回率-边界准确率曲线;

图7(c)为本发明所属实施例的超像素数目-平均计算时间曲线;

具体实施方式

为使本发明目的、技术方案和优点更加清晰可见,下文结合附图对本发明实施例的技术方案更进行详细、完整的阐述。显然,所描述的实施例是本发明的一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本发明保护的范围。

本发明提出了一种基于深度学习的超像素分割算法,流程图如图1所示,具体包括以下步骤:

S1:选取基于U型编解码结构的SpixelFCN作为本实施例初始化的U型编解码网络,其网络由编码器和解码器构成。根据网络前传过程中感受野的扩大与缩小,将网络感受野扩大编码特征的部分定义为编码器,感受野缩小解码特征的部分定义为解码器,编码器与解码器之间具备跨层连接,促使解码器恢复在编码器感受野扩大过程中损失的局部细节信息。本实施例中初始化的U型编解码网络结构如图2所示。其中编码器主要由不同步长的卷积操作的构成,实现特征的提取和感受野的扩大;解码器主要由卷积和反卷积操作构成,其中卷积主要实现编码特征的解码,并由反卷积实现特征的空间尺度恢复;

S2:设计多分支特征提取模块,对初始化的编解码网络的编码器中任意层数的特征提取层进行替换,实现网络过参数化。本实施例中,选取编码器中每一尺度下的第二个特征提取层,其作为多分支特征提取模块的替换层,其替换后的过参数化网络结构如图3所示。此外还可以替换每一尺度中的第一个特征提取层,或只替换部分尺度中的部分特征提取层,此处不做额外限制。

多分支特征提取模块结构如图4所示,该模块的输入输出可以为不同尺寸的特征,其中不同分支的操作由不同结构的卷积神经网络构成,其中每一分支的输入彼此相同,每一分支的输出尺寸彼此相同,不同分支的输出通过各自分支预先初始化的可学习权重进行逐元素相加,后接批归一化和激活函数,进而构成并行的多分支特征提取结构。通过多分支特征提取模块实现网络过参数化,网络可以提取更丰富多层次的编码特征,并且通过训练得到的各分支的可学习权重可以自适应选择更适合于任务的特征提取分支。本实施例中选取的各分支操作如图5所示,各分支赋予相同的初始化权重w=1,其组合而成的多分支特征提取模块具备多样的感受野和网络深度,可以有效地提取出丰富的编码特征;

S3:过参数化编解码网络根据重建损失进行训练,至损失函数曲线趋于平缓时停止训练,促使网络具备超像素分割能力。本实施例中采用面向目标分割真值标注图像的重建损失进行网络训练。其具体为真值标注图像根据超像素分割结果进行下采样,再根据超像素分割结果进行上采样得到重建后的真值标注图像,根据原始图像和重建图像之间的信息差异,构建基于交叉熵和欧式距离的重建损失作为网络训练的监督手段。

根据网络训练迭代次数、学习率和初始化权重w设立剪枝阈值λ,本工作中一般选取[0.85w,0.95w]作为阈值λ的候选区间,在本实施例中选取λ=0.95。设立剪枝阈值λ,根据训练后得到的网络模型参数,依据剪枝策略进行网络剪枝,得到更适合超像素分割任务的专用编码器。网络剪枝策略为对每个多分支特征提取模块中的每个分支,根据网络训练得到的模型参数,判断分支的保留和剪除。当前分支的可学习权重小于阈值,即w<λ时,剪去该分支;反之当分支可学习权重大于等于阈值,即w≥λ时,保留该分支;当所有分支的可学习权重均小于阈值时,仅保留权重最大的分支,减去其它分支;

S4:在网络剪枝之后的解码器结构上添加跨层特征融合,实现由上至下,再由下至上的解码结构,进而促进解码器解码能力增强,降低解码误差,其强化后的解码器简称为TDT(Top-down-top)解码器。所述的跨层特征融合位于U型编解码网络由上至下解码阶段之后,用于实现由微至广的跨尺度特征融合,进而提升原尺度特征图质量,其跨尺度特征融合过程为由下至上的解码结构。通过串联U型编解码网络由上至下的解码结构和跨尺度特征融合由下至上的解码结构,实现了由上至下,再由下至上的TDT解码器整体解码结构的构建。

本实施例中,最终的编解码网络结构图如图6所示,其中TDT解码器的由上至下阶段采用U型编解码网络自身的由上至下结构,由下至上阶段通过跨尺度特征融合实现,所述的跨尺度特征融合具体操作为:在U型编解码网络原有框架下,将解码器前端大感受野下的任意一层的输出特征进行上采样后,与解码器后端原尺度网络层的输出特征进行拼接并后接卷积操作,实现两层间跨尺度的信息融合,实现网络解码强化,并后接卷积和Softmax激活函数,进而实现基于概率形式的超像素分割结果计算。本实施例中TDT解码器由下至上阶段中,跨尺度特征融合选取解码器1/8尺度处的卷积层与原尺度网络层进行信息融合,同时还可选取解码器1/4尺度处的卷积层或1/16尺度处的卷积层与原尺度网络层进行跨尺度特征融合,此处不做额外限制;

S5:上述步骤s1到s4后得到的编解码网络可以有效计算像素所属超像素索引的概率,对其进行训练,至损失函数完全收敛时停止训练,获得适用于超像素分割任务的模型参数,并以此模型参数计算最终超像素分割结果。

S5-1:本实施例选取BSDS(Berkeley Segmentation Dataset)数据集作为实验数据集,其包含200张训练图像、100张验证图像和200张测试图像,其每张图像对应多个目标级别的分割标注。对数据集进行预处理,可以得到1633对训练图像和1063对测试图像作为本实施例的训练数据和测试数据。

S5-2:训练过程中数据增强手段包含随机裁剪、随机水平/垂直翻转操作。

S5-3:网络训练过程中选取Adam优化器,其中优化器参数β

使用阶段。

按照前述方法构建网络结构,初始化模型参数,准备数据训练集。当训练完成后,将待检测的图片输入已训练好的整体网络中,输出该图片的超像素分割结果。

方法测试。

对本发明公开的方法在上述实施例中进行验证,并与目前已公开方法进行对比,以此验证本发明得到的超像素分割结果在边界捕捉、结构性损失和计算效率上具有相对优势。

量化指标选用ASA(Achievable Segmentation Accuracy)、BR-BP(BoundaryRecall-Boundary Precision)和计算时间三个指标。对图像进行超像素分割获得K个超像素,其集合

ASA的指标公式为:

ASA过程中所有超像素S

边界召回率BR(Boundary Recall)和边界准确率BP(Boundary Precision)的指标公式分别为:

其中TP为真阳性,FP为假阳性,TN为真阴性,FP为假阴性。不同于ASA的区域比对方式,BR-BP以像素为元素对超像素分割的进行量化,其边界准确率和召回率可以有效反映超像素分割算法的边界捕捉能力。

对比的量化结果如图7所示,ASA分数主要用来衡量超像素分割结果的结构性信息的保留程度,其值越大越好,边界召回率-准确率主要用来衡量超像素分割结果对于目标边界的准确率和召回率,体现其边界捕捉能力,其曲线越靠近右上方代表其方法能力越强,图7(c)为不同超像素分割方法中超像素个数不同时的计算时间,其计算时间越少越好。

本实施例中我们选取Yang等在2020年CVPR上发表的《SpixelFCN:SuperpixelSegmentation with Fully Convolutional Network》中的SpixelFCN编解码网络作为我们的初始网络,在此基础上通过本发明提出的网络过参数化、网络剪枝和TDT解码强化一系列步骤,如图7所示,在ASA和边界召回率-准确率上较初始网络有明显提升。

另外,与《Superpixel Sampling Networks》提出的SSN方法和《LearningSuperpixels with Segmentation-Aware Affinity Loss》提出的SEAL方法比较可知,在衡量结构性损失的ASA上本发明的量化结果进一步缩短了与SSN差距,与SEAL相比仅在超像素数量较少时略差于SEAL;在衡量表边界捕捉能力的边界召回率-准确率上,SSN方法大幅领先目前已公开的其他所有方法,而本发明提出的方法在该项指标上与SSN表现相当,并且远优于SEAL方法。同时在计算效率上,本发明相对于SSN和SEAL方法存在绝对优势,与SpixelFCN相比基本持平,但在结构性信息保留和边界捕捉能力上远优于SpixleFCN。

综上所述,基于本发明提出的网络模型过参数化、网络剪枝和TDT解码强化,选取基于U型编解码结构的SpixelFCN为初始网络构建的实施例上,其边界捕捉能力和结构性信息保留能力有明显提升。根据本实施例的量化结果,通过对边界捕捉能力、结构性信息保留和计算效率三个量化指标与其他算法的综合对比,可知本方法为目前的最优算法。

- 一种基于深度学习的超像素分割方法

- 基于深度学习和超像素分割的大田稻穗分割方法