用于获得面部的光学性质的视频分析

文献发布时间:2023-06-19 19:23:34

相关申请的交叉引用

本申请要求2020年8月31日提交的美国专利申请No.17/007,860的优先权,其内容以引用方式全文并入本文中以用于所有目的。

本申请要求2020年11月2日提交的法国专利申请No.FR2011194的优先权,其内容以引用方式全文并入本文中以用于所有目的。

技术领域

本文中描述的实施例总体上涉及用于分析皮肤的光学性质的系统和方法。

背景技术

数码照片已经成为用于捕获和评估化妆品的颜色、光泽和形态效应的最流行的媒介。然而,即使是最高分辨率的图像也是不够的:它们是静态的,即使人看到的是运动中的世界,它们仅捕获一种具体的照明条件,并且图像处理需要非常严格的、标准化的几何形状,以确保可靠的比较分析。

为了解决这一问题,科学家们开发了机器学习方法来改善照片分析,但它们有局限性:它们是“黑匣子”,需要非常大的图像集,需要非常标准化的数据,用低分辨率图像训练最快,并且需要非常具体的训练目标。

发明内容

鉴于上面提及的问题,本公开描述了用于分析皮肤的光学性质的系统和方法,包括:捕获皮肤的视频;从捕获的皮肤的视频跟踪皮肤上的一个或多个界标;从跟踪的皮肤上的一个或多个界标识别一个或多个感兴趣区域;将捕获的视频变换到角度域中;和计算皮肤的光学性质。

在一个实施例中,光学性质包括颜色、亮度、纹理、光泽、辐亮度、均匀度、肤色、彩虹色和辉光中的至少一种。

在一个实施例中,从手持设备捕获视频。

在一个实施例中,基于计算出的皮肤的光学性质来改变环境。

在一个实施例中,皮肤在面部上。

在一个实施例中,针对预先存在的视频计算光学性质。

在一个实施例中,计算出的皮肤的光学性质被收集以用于数据分析。

附图说明

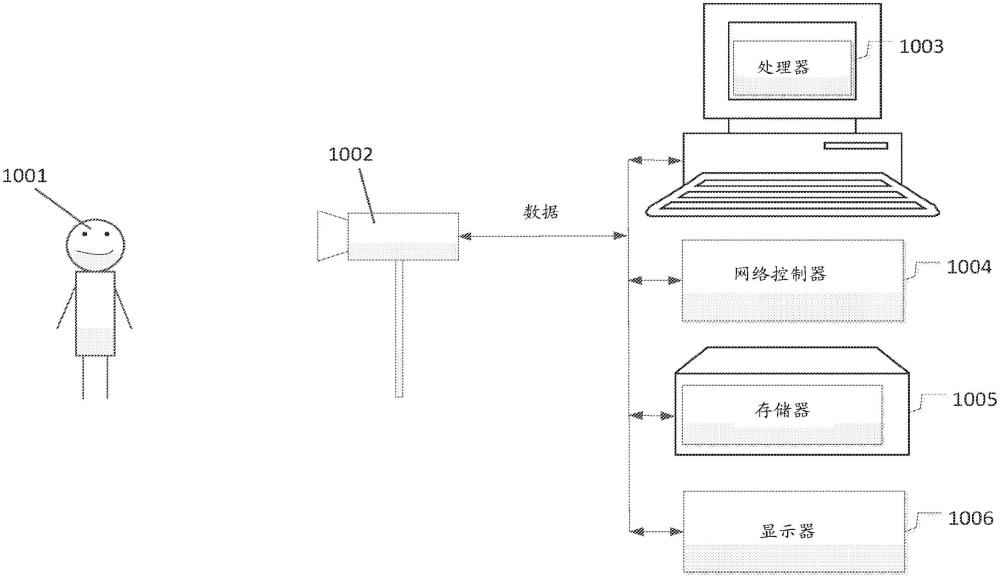

图1A是一种潜在场景的系统视图,其中相机用来捕获用户面部的视频,并且捕获的视频中的面部的光学参数在本地、通过网络或以两者的组合的方式计算。

图1B是第二种潜在场景的系统视图,其中电话用来自捕获视频,并利用云来处理视频以获得光学参数。

图2是概述在一个实施例中计算测量值/光学性质的步骤的流程图。

图3图示了来自捕获的参与者移动他们的头部的视频的帧。

图4是示出在一个示例中针对每个帧跟踪的界标的示例。

图5A是示出在一个头部取向下的面部的左侧和右侧上的感兴趣区域的第一示例,其中感兴趣区域使用跟踪的界标来创建。

图5B是示出在三个不同头部取向下的面部的左侧和右侧上的感兴趣区域的第二示例,其中感兴趣区域使用跟踪的界标来创建。

图6是示出对于视频的一个帧的面部上的皮肤的光学性质的示例,其中光学性质是每感兴趣区域的平均颜色。

图7是示出针对视频的多个帧的面部上的皮肤的光学性质的示例,其中光学性质是每感兴趣区域的平均灰度值。

图8图示了角度变换,其中示出了在不同的头部取向/角度下的左前额感兴趣区域和右前额感兴趣区域的平均RBG值。

图9A示出了使用Panasonic GH5相机为研究中的所有参与者获得的峰值明度与时间点的关系的曲线图,其中每个参与者在他们的面部的一半上使用已知具有较高峰值明度(NARS)的第一产品,并且在他们的面部的另一半上使用已知具有较低峰值明度(ELDW)的第二产品。

图9B示出了使用Panasonic GH5相机为研究中的所有参与者获得的峰值明度产品差值曲线图,其中每个参与者在他们的面部的一半上使用已知具有较高峰值明度(NARS)的第一产品,并且在他们的面部的另一半上使用已知具有较低峰值明度(ELDW)的第二产品。

图10A示出了使用iPhone 8相机为研究中的所有参与者获得的峰值明度与时间点的关系的曲线图,其中每个参与者在他们的面部的一半上使用已知具有较高峰值明度(NARS)的第一产品,并且在他们的面部的另一半上使用已知具有较低峰值明度(ELDW)的第二产品。

图10B示出了使用iPhone 8相机为研究中的所有参与者获得的峰值明度产品差值曲线图,其中每个参与者在他们的面部的一半上使用已知具有较高峰值明度(NARS)的第一产品,并且在他们的面部的另一半上使用已知具有较低峰值明度(ELDW)的第二产品。

图11A示出了使用Samba为研究中的所有参与者获得的光泽水平与时间点的关系的曲线图,其中每个参与者在他们的面部的一半上使用已知具有较高峰值明度(NARS)的第一产品,并且在他们的面部的另一半上使用已知具有较低峰值明度(ELDW)的第二产品。

图11B示出了使用Samba为研究中的所有参与者获得的光泽水平产品差值曲线图,其中每个参与者在他们的面部的一半上使用已知具有较高峰值明度(NARS)的第一产品,并且在他们的面部的另一半上使用已知具有较低峰值明度(ELDW)的第二产品。

图12示出了三种不同采集类型的光泽/峰值明度差值的并排比较,其中(A)来自Samba偏光相机,(B)是具有自行采集的iPhone视频的面部视频系统,并且(C)是具有在三脚架上的Panasonic GH5相机的面部视频系统。

图13示出了配对T检验的统计结果,该检验使用来自三种不同采集类型的结果测试是否发现ELDW和NARS在统计上不同。

图14示出了在实验中随机分配的放在每个参与者的左侧和右侧面部上的实际产品。

具体实施方式

在一个实施例中,本公开提出了用于评估人面部上的皮肤的诸如(但不限于)颜色、亮度、纹理、光泽、辐亮度、均匀度、肤色、彩虹色、辉光等的光学性质(即效果)的系统和方法。一种方法是通过在放松的真实生活捕获环境中捕获视频来(1)评估和(2)可视化光学效果,并利用具有面部界标检测能力的软件来分析它。所公开的技术可以使用人的视频和动态运动来量化人面部的光学性质;当量化这些光学性质时,结果是更好的灵敏度、鲁棒性和灵活性(不需要使用高端相机)。

图1A和图1B示出了两个示例性实施例的系统视图。在图1A中,诸如数字单镜头反光(DSLR)相机的相机1002可以用来记录面部1001的视频。在一个实施例中,面部1001和相机1002之间的距离可以是当人在涂敷化妆品时人和镜子之间的法向距离。捕获的视频数据可以被发送到处理器1003、网络控制器1004、存储器1005和/或显示器1006。处理器1003可以用来处理来自相机1002的捕获视频,并执行计算以确定光学性质。网络控制器1004可以用来通过网络发送和/或接收数据。存储器1005可以用来读取和写入数据。显示器1006可以用来可视化数据,诸如面部1001的经处理(即计算出)的光学性质。在另一个实施例中,光可以照射到面部1001上以获得更好的照明。在另一个实施例中,绿色屏幕可以被放置在用户的面部1001后面,以抠出(key-out)背景,从而更好地可视化面部1001。

在图1B中,连接到互联网的电话1007可以用于自捕获面部1001的视频。自捕获的视频可以被发送到云1008(即,通过网络)。自捕获的视频可以从云1008发送到服务器1009以进行处理。服务器1009可以根据自捕获的视频计算面部1001的光学性质,并经由云1008将结果发送回电话1007。在另一个实施例中,可以省略云1008和服务器1009,并且电话1007可以根据自捕获的视频在本地(即,不需要互联网连接)计算面部1001的所有光学性质,并为用户显示结果。

图2是遍历一种方法100的示例性实施例的流程图。该方法可以被配置成处理电路。

在图2中,S102将捕获视频。捕获的视频可以是人面部。在另一个实施例中,捕获的视频可以是其他地方的皮肤,诸如腿部、手臂、背部等。在该示例中将使用在人面部上的皮肤。视频可以被预先记录或实时记录。在记录的视频中,人可以自然地移动他们的头部(例如,向左、向中、向右看,并且然后重复)。人可以移除眼镜并用头带向后拉头发,以优化面部跟踪并最大限度地减少面部区域的遮挡。图3示出了来自捕获的视频的一些帧的示例。视频可以由能够记录视频的设备记录,诸如手持设备(例如,智能手机、平板电脑等)、来自膝上型计算机的网络摄像头、DSLR相机等。

在一个实施例中,视频捕获系统可以具有一个LED灯、与照明的中心轴线成一直线的三脚架上的DSLR以及供受试者坐在上面的椅子。视频可以以720p的分辨率(最高4K)和60fps(最大120fps)记录。在一个实施例中,在记录期间,可以指示受试者自然地移动他们的头部最多60秒和最少15秒。在另一个实施例中,受试者可以移动他们的头部少于15秒或超过60秒。在另一个实施例中,DSLR和三脚架可以由智能手机(例如iPhone)代替,并且智能手机用户可以自捕获他们面部的视频。对于店内客户体验可视化,可以使用连接到工作站的计算机视觉(例如USB3Vision类型)相机进行实时捕获。

在图2中,S104是界标跟踪。视频文件(评估系统)或视频流(实时可视化)由面部界标跟踪软件库读取。图4示出了界标跟踪的示例,其中对于每个视频帧检测面部上的70个点位置(例如,瞳孔的中心、眼角、鼻孔等)。在一个实施例中,界标的数量可以大于或小于70。界标数据可以包括存在的时间、存在的强度、x位置和y位置。数据可以被输出到逗号分隔值(CSV)文件中。

界标跟踪软件可在开源库Dlib(https://github.com/davisking/dlib)中找到。这种界标跟踪的示例可以在由Carnegie Mellon开发的OpenPose软件中看到(https://github.com/CMU-Perceptual-Computing-Lab/openpose)。

在图2中,S106将定义和跟踪感兴趣区域(ROI)。可以使用跟踪的界标来构建面部上的一个或多个感兴趣区域(即,面片或区)。此外,捕获的视频可以被过滤以仅使用最佳视频帧(例如,具有清晰ROI的帧、具有最小数量的界标的帧等)。这些ROI/面片/区可以被定义为与人感知最相关的位置。它们的大小和位置可以通过专门的感知研究来获知,例如瞳孔跟踪研究,用于了解人在受试者的面部上的确切关注点。图5A和图5B中示出了S106的示例,其中界标用来创建多个区域的ROI,诸如左前额和右前额、眼袋、脸颊和下巴。

在图2中,S108用于计算测量值/光学性质。对于所有(或一些)ROI,可以执行针对诸如颜色、亮度(即光)和纹理的光学性质的计算。从包含在ROI内的RGB三元组的集合计算平均值、中位数、上四分位数和下四分位数以估计颜色(例如,在帧12处,前额-ROI#2的平均颜色是RGB=[180,122,80])。在将RGB三元组转换为单个8位灰度值(范围从0至255)后,可以使用类似的函数来计算亮度和明度。每个ROI内的纹理可以使用如2D标准差、2D熵以及一阶和二阶导数等的块处理函数(或过滤器)来计算。图6示出了其中针对捕获视频的一帧来计算对于每个ROI的每ROI的平均颜色的示例。另外,图7示出了针对捕获的视频的每个帧的每个ROI随时间推移的计算出的颜色和明度。

在图2中,S110将执行到角度域的变换。基于时间的颜色/光/纹理数据可以被转换到角度域中。这通过计算左侧面部界标和右侧面部界标之间相对于中心轴线的距离的比率并求解三角方程来实现;例如,当头部转向右侧时,可以观察到右眼到鼻子的距离比左眼到鼻子的距离小得多,因此可以基于这些距离来估计角度。这允许产生如下结果:在头部从中心向左旋转22度时,右脸颊的颜色为RGB==[200,112,98]。换句话说,计算的测量值可以被重新映射为头部取向(即22°的角度)而不是时间(即帧数12)的函数。图8中示出了其中根据颜色/明度(y轴)和头部取向(x轴)映射左前额ROI和右前额ROI的示例。注意,在该示例中,更负的x轴值对应于参与者的面部转向更左,更正的x轴值对应于面部转向更右,并且在零处的x轴值表示参与者的面部居中。

在图2中,S112将计算附加的更高级别的测量值/光学性质,如光泽、辐亮度、均匀度、肤色、彩虹色、辉光。在颜色和光线测量值已被映射到角度域之后,可以对数据执行更高级别的分析,例如,可以将面部“光泽”与视频中的“角度范围内的峰值明度”关联。换句话说,当人向左和向右转动他们的头时,每个ROI在某个角度经历最大明度,该最大明度使光源的反射最大化,并且该“峰值明度”灰度值可以在无光泽产品和有光泽产品之间进行区分。例如,彩虹色是一种光学效果,其中颜色似乎由于角度而改变,因此可以跟踪和量化每个ROI内平均颜色的可变性,以估计颜色变化。其他度量可以通过作用于角度域和空间域(即所有ROI上的最大明度)的类似非线性函数(即最大明度与角度的函数)来确定;在辐亮度和辉光的情况下,回归模型可以用来将一组基于角度的度量与消费者感知数据和化妆专家评估数据相联系。

在另一个实施例中,S110可以在S108之前执行,并且S108和S112可以作为S110之后的一个步骤一起执行。

上述方法100使用准专业级相机(Panasonic GH 5)、手持设备相机(iPhone 8前置相机)和差分偏光相机(Bossa Nova的Samba)利用峰值明度/光泽度量来测试。Samba可以被认为是最先进的。例如,Samba在L’Oreal是标准的活体光泽仪器(in vivo shineinstrument)。

六名白人女性参与者在她们的面部的每个半部上各涂有两种产品。这些产品是(1)Estee Lauder Double Wear,3W1 Tawny(已知为哑光),缩写为ELDW,和(2)NARSNatural Radiant Longwear Foundation,Light 4.5Vienna 6606(已知比ELDW更亮),缩写为NARS。因此,在峰值明度/光泽测量中,NARS Foundation应该具有比ELDW更高的峰值明度/光泽值。在基线(T0)、涂敷后(T1)、涂敷后2小时(T2)和涂敷后5小时(T3)时捕获参与者的面部。结合上述方法100的面部分析软件被用于将每帧的界标转化成每帧的区,转化成每帧的度量。

使用由在三脚架上的Panasonic GH5采集的视频的每个参与者、每个时间点横跨所有区的计算出的峰值明度结果在图9A中示出,并且对应的峰值明度产品差值在图9B中示出。使用由iPhone采集的视频(手动采集,即由参与者自行采集)的每个参与者、每个时间点横跨所有区的计算出的峰值明度结果在图10A中示出(每个曲线表示面部的一侧),并且对应的峰值明度产品差值在图10B中示出(每个曲线表示一个参与者)。对于由Panasonic GH5和iPhone捕获的视频,结果显示,对于每个参与者来说,NARS具有比ELDW更高的峰值明度。峰值明度差中也存在一致的演变,其中NARS最初在T1比ELDW亮得多,并且然后在T2和T3演变得更接近ELDW。这种一致性在Samba结果中找不到。

使用Samba的每个参与者、每个时间点的光泽结果在图11A中示出,并且每个参与者、每个时间点的对应的光泽水平差值在图11B中示出。注意,分别在T1和T2(均在图11B中圈出),参与者#3和#5的Samba光泽水平对于ELDW来说比NARS高。总的来说,Samba光泽水平不如图9A、图9B、图10A和图10B中所示的峰值明度数据规律。

产品差值曲线图汇总在图12中,以用于并排比较,其中(A)来自Samba,(B)是带有自行采集的iPhone视频的面部视频系统,并且(C)是带有在三脚架上的Panasonic GH5相机的面部视频系统。从这两个面部视频系统中看到的光泽演变比Samba清晰得多。面部视频系统的结果显示,无论是使用带自采集功能的iPhone还是在三脚架上的准专业级相机,面部的涂敷NARS侧比Samba结果更一致地更亮(即负的产品差值)。这些光泽差值曲线可以转化为任何统计测试的优越辨别力。

如图13中所示,配对T检验(N=6)用来比较来自NARS和ELDW的每个仪器的数据。统计数据显示,使用来自自行采集的iPhone视频的峰值明度的面部视频系统能够在每个时间点并且以非常低的p值在NARS和ELDW这两种产品之间进行区分。这与使用被坚固支撑和更先进的Panasonic GH5相机的面部视频系统的统计强度基本上相同。然而,Samba在T1和T3处未能在NARS和ELDW之间进行区分。

因此,带有GH5相机的面部视频系统显示,尽管更便宜、更小、非接触式、更与消费者相关且更易于使用,但它可以以最先进技术从未见过的统计置信度在光泽性能之间进行区分。此外,当使用由测试受试者自行采集的普通智能手机视频时,也产生同样高水平的辨别力。

在实验期间,Apple iPhone 8运行Pro Camera by Moment,并且具有以下相机设置:720p@60fps,ISO22(最低),1/60s快门(60fps最慢)。Panasonic GH5放在三脚架上,距离受试者大约50厘米,白平衡校正到XRite Graycard(XRite Video Colorchecker的反面),ISO200,All-I Frame Compression 200mbps。受试者有一个可以旋转、上升和下降的气动凳子。在受试者头部后面大约100厘米处有一个绿色屏幕背景幕,用大约6000K的紧凑型荧光灯(CFL)照亮。有一个Bescor LED灯(大约6000K),且和Sekonic光色记(Light and ColorMeter)在面部前方测得的光为6200K。在实验期间,参与者ID和施用到他们面部的左侧和右侧的随机分配的产品在图14中示出。

在一个示例性实施例中,可以应用上述技术来基于某人(例如顾客)的面部特征的颜色来改变环境。例如,顾客可能进入商店寻找口红化妆品,并且货架可以改变颜色以匹配顾客的肤色。又如,顾客可能进入旗舰店,并且墙壁可以改变颜色来匹配他们的面部。这样的益处可以包括能够容易地挑选彩妆产品,提亮肤色,并且产生营销热潮,诸如例如展示商店有多先进或独特。又如,顾客可能进入旗舰店,并且机器人雕塑可以改变其形状以反映他们的彩色妆容;这使得顾客可以从多个角度观察他们的面部,就像别人会怎么看他们一样。

在一个实施例中,上述技术可以在家中(例如使用智能手机)或在供应商处(例如使用DSLR相机)执行;这可以实时(例如,在捕获视频时几乎同时地计算光学性质)或针对预先存在的视频(即,为过去记录的视频计算光学性质)完成。

在另一个实施例中,上述技术可以用来创建数据库,该数据库包括从不同用户收集的关于计算出的皮肤的光学性质的数据。该数据库可以用于数据分析。该数据可以通过诸如年龄、地区、性别等的其他特征进一步组织。例如,对于趋势分析,收集关于社交媒体红人的光学性质的数据(例如,从他们的社交媒体帖子收集)可以导致对趋势的洞察,诸如某个年龄组的特定化妆风格的流行程度、世界的某个地区的特定口红颜色等。数据分析的结果可以用来创建商业想法和做出更好的商业决策,诸如能够识别趋势。

本文中描述的方法和系统可以以多种技术实现,但是通常涉及处理电路。在一个实施例中,处理电路被实现为以下之一或组合:专用集成电路(ASIC)、现场可编程门阵列(FPGA)、通用逻辑阵列(GAL)、可编程逻辑阵列(PAL)、用于允许逻辑门(例如,使用熔断器)的一次可编程性的电路或可重编程逻辑门。此外,处理电路可以包括计算机处理器,并且具有嵌入式和/或外部非易失性计算机可读存储器(例如,RAM、SRAM、FRAM、PROM、EPROM和/或EEPROM),其存储用于控制计算机处理器执行本文中描述的过程的计算机指令(二进制可执行指令和/或解释的计算机指令)。计算机处理器电路可以实现单个处理器或多个处理器,每个处理器支持单个线程或多个线程,并且每个处理器具有单核或多核。用来训练人工神经网络的处理电路不必与用来实现执行本文中描述的图像去噪的经训练的人工神经网络的处理电路相同。例如,处理器电路和存储器可以用来产生经训练的人工神经网络(例如,由其互连和权重定义),并且FPGA可以用来实现经训练的人工神经网络。此外,经训练的人工神经网络的训练和使用可以使用串行实现或并行实现来提高性能(例如,通过在诸如图形处理器架构的并行处理器架构上实现经训练的神经网络)。

虽然已经描述了某些实施例,但是这些实施例仅通过示例的方式呈现,并且不旨在限制本发明的范围。实际上,本文中描述的新颖实施例可以以多种其他形式来实施;此外,在不脱离本发明的精神的情况下,可以对本文中描述的实施例的形式进行各种省略、替换和改变。所附权利要求书及其等同物旨在涵盖将落入本发明的范围和精神内的这样的形式或修改。

- 用于面部识别和视频分析以识别上下文视频流中的个人的装置和方法

- 用于面部识别和视频分析以识别上下文视频流中的个人的装置和方法