一种自适应特征融合的智能变电站人体目标跟踪方法

文献发布时间:2023-06-19 10:38:35

技术领域

本发明涉及目标跟踪领域,具体涉及一种自适应特征融合的智能变电站人体目标跟踪方法。

背景技术

现今有许多定位跟踪系统使用超宽波(ultra-wideband,UW)技术,基于硬件技术完成人员的定位与跟踪,但是该方法成本高,并且需要被监控对象一直携带手环等信号发生器,无法对擅自闯入的人员或工程车辆进行跟踪。视觉算法方面,有些监控系统使用自适应均值偏移(Camshift)、支持向量机(support vector machine,SVM)、自适应增强(AdaBoost)或者背景提取(ViBe)、卡尔曼滤波等传统的跟踪算法对人员或者工程车辆进行跟踪。但是传统算法往往依赖图像的底层特征的相似度,虽然速度较快,但无法适应跟踪目标的大姿态变化和由于摄像机拍摄造成的模糊、遮挡等情况,难以在较为复杂的场景下输出可以信赖的结果。

现有技术的变电站目标跟踪方法主要存在以下不足:(1)变电站视频监控的跟踪目标,一般为站内的工作人员,在特定场合对于工程车辆或入侵异物也有一定需求。考虑到实际场景,智能监控需要对各异常情况有极高的响应速度,并且往往需要对跟踪的目标进行后续分析,例如移动轨迹分析、行为识别等。(2)变电站监控视频帧率低、清晰度低,同时容易出现跟踪目标被设备遮挡的情况,这给智能监控算法提出了极大的挑战。

发明内容

为解决现有技术存在的问题,本发明提供了一种自适应特征融合的智能变电站人体目标跟踪方法。为实现本发明的目的,本发明的技术方案如下。

一种自适应特征融合的智能变电站人体目标跟踪方法,包括:

获取电站现场的人体目标图像,标定获取的人体目标图像,基于ResNet-50深度卷积网络提取特征图;

基于ResNet-50深度卷积网络的C3、C4、C5层级构造特征金字塔网络FPN的P3、P4、P5层级;

将特征金字塔网络FPN的P3、P4、P5层级的特征图输入自适应空间融合ASF进行特征融合;

采用注意力机制增强特征金字塔网络的输出特征图;

将目标图像块z和搜索图像块x分别输入自适应空间融合ASF的共享主干网络f,得到参考特征图f(z)和f(x);将参考特征图f(z)和f(x)进行深度互相关操作,得到候选窗口响应RoWs;

在增强特征金字塔网络的输出特征图上,滑动一组不同比率和不同尺度的锚点,映射到原始图像中得到不同比率和不同尺度的感兴趣区域ROIs;

拼接感兴趣区域ROIs,并将拼接后的ROIs输入三个并联的分支:边界框分支、分类分支和掩膜分支;其中,边界框分支的输出结果,用于下一帧目标的框定,掩膜分支的输出结果用于定位当前帧目标位置;

计算边界框分支的回归损失函数L

计算孪生网络的总体损失函数。

优选的,所述基于ResNet-50深度卷积网络提取深度特征信息包括:输入256维的特征图,使用1×1卷积层,将256维的特征转变为64维的特征图;经过ReLU非线性激活后,使用3×3卷积层提取目标特征图;使用ReLU非线性激活,并使用1×1卷积层将目标特征图的维度转为256;将输出的特征图与输入的特征图进行加法操作。

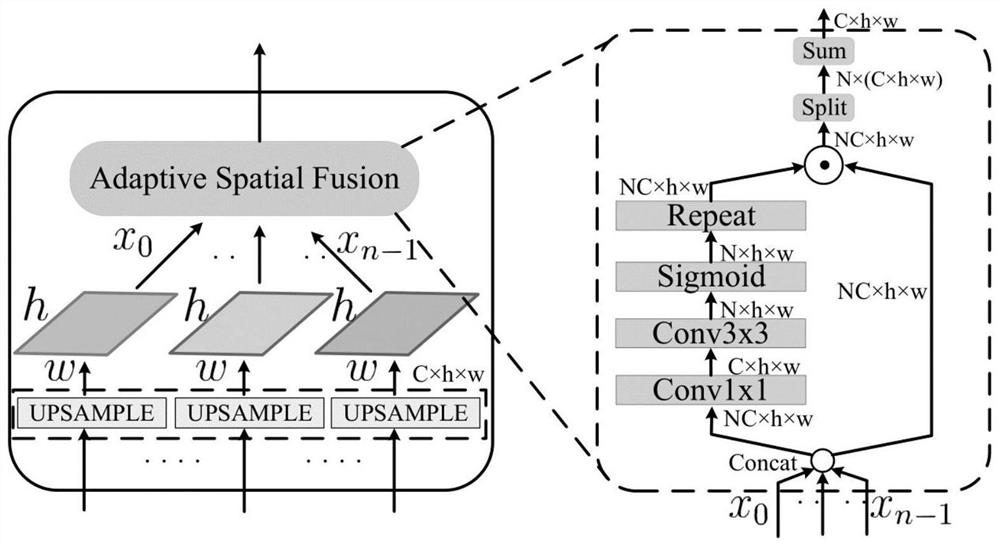

优选的,所述将特征金字塔网络的P3、P4、P5的特征图输入自适应空间融合进行特征融合包括:将P3、P4、P5的特征图进行拼接,将拼接后的特征图分为第一分支和第二分支,基于第一分支的特征图得到注意力分支;第二个分支的特征图直接和注意力分支按位相乘;合并第一分支和第二分支,并将第一分支和第二分支合并后的特征图,进行分组和求和操作,得到特征金字塔网络的输出特征图。

优选的,采用公式(1)计算边界框分支的回归损失函数L

其中,smooth L

式中,x为归一化后的距离,i为每组归一化距离的序号;

采用公式(2)计算分数分支的分类损失函数L

L

其中,p

采用公式(3)计算掩膜分支的掩模损失函数L

其中,n为RoWs的序号,y

优选的,采用公式(4)计算孪生网络的总体损失函数:

L=λ

其中,λ

相对于现有技术,本发明的有益技术效果在于:

(1)本发明针对FPN各个层级特征图,使用ASF自适应空间融合,同时,使用高斯非局部注意力机制,对ASF特征图进行特征增强。从而可以在融合后的特征图中,突出目标区域特征,抑制非目标、背景特征,进而使得深度神经网络的多尺度目标检测能力更为高效。

(2)本发明提出在ASF特征图中,滑动一组具有不同尺度和比率的锚点,与只使用单一比率的ASF相比,可以得到更高精度的检测结果。

(3)本发明在丰富了ROI区域特征的同时,引入了通道注意力机制,重复挖掘了待检测目标深度特征,有效提升目标检测精度。

附图说明

为了更清楚地说明本申请实施例的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,应当理解,以下附图仅示出了本申请的某些实施例,因此不应被看作是对范围的限定,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他相关的附图。

图1为自适应特征融合的智能变电站人体目标跟踪算法流程图;

图2为ResNet-50一个构建块的算法流程图;

图3为自适应空间融合ASF算法流程图。

具体实施方式

为使本申请实施例的目的、技术方案和优点更加清楚,下面将结合本申请实施例中附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本申请一部分实施例,而不是全部的实施例。

本实施例的自适应特征融合的智能变电站人体目标跟踪方法首先获取智能变电站现场的人体目标图像。对获取的训练数据,进行手工标定,从而形成深度学习算法的训练数据集。构造自适应特征融合的智能变电站人体目标跟踪神经网络框架。如图1所示,首先,将原始图像送入ResNet-50深度卷积网络,提取目标的深度特征信息。ResNet-50从低到高的卷积结果记为C1(图中未示出),C2,C3,C4,C5。对于C3、C4、C5没有使用池化,保证深度特征图具有较高分辨率,进而保证目标跟踪精度。然后,自上而下构造FPN融合特征,每个层级具有不同的语义信息右FPN层从低到高记为P1(图中未示出),P2(图中未示出),P3(图中未示出),P4,P5。将P3、P4、P5三个层级的参考特征图,分别送入多比率锚点和特征增强的ASF(Adaptive Spatial Fusion,自适应空间融合),使得特征融合更加高效。使用高斯非局部注意力机制实现特征增强,突出了目标特征,抑制了非目标、背景特征,从而增强了ASF特征图的特征信息,提升跟踪性能。在ASF特征图上使用了多比率锚点,进一步提升跟踪精度。此外,还对ASF特征图的不同通道特征进行拼接,训练得到通道注意力模型,实现针对特定目标更加精准的检测。经过端到端的训练,可以得到专注于变电站人体目标的高质量跟踪模型,有效提升目标跟踪精度。

示例性的,首先获取智能变电站现场的工作人员图像,例如,10000张以上的图像。图像满足包含有不同尺度、不同背景环境的人体目标,光线应包含晴天、阴天、下雨等多种类型,从而丰富训练样本所蕴含的特征信息,有效提升目标跟踪深度学习模型的精度和鲁棒性。

对获取的训练数据,进行手工标定。在手工标注的过程中,并保证标签的正确性,以及标定框的准确性,从而形成深度学习算法的训练数据集。

构造自适应特征融合的目标跟踪深度学习网络,用于智能变电站人体目标跟踪。提出的算法可以对人体目标进行高精度、强鲁棒的跟踪。

基于ResNet-50提取深度特征图。ResNet-50的一个构建块的算法流程图如图2所示,首先输入256维的特征图,使用1×1卷积层,将特征转变为64维的。经过relu非线性激活后,使用3×3卷积层提取目标特征信息。在此使用relu非线性激活层,并再次使用1×1卷积层将特征维度转为256。将得到的特征图与输入的特征图进行加法操作,经过relu层后,输入到下一个构建块。

将ResNet-50的C3、C4、C5三个层级参考特征图,构造FPN融合特征图P3、P4、P5,丰富了低层级特征图所蕴含的语义信息。对于C3、C4、C5的特征图,没有使用池化操作,是为了保证目标跟踪精度。没有使用C1、C2层级,因为二者特征图分辨率较高,会降低目标跟踪速度,除此之外,二者的语义信息相对较弱。

将FPN的P3、P4、P5三个层级的参考特征图,分别送入ASF模块,算法流程图如图3所示。首先,将各层级特征图进行拼接。拼接后的特征图,一分支经过1×1、3×3卷积层,sigmoid激活层,重复层,得到各个通道特征图的注意力分数。另一个分支的拼接后的特征图,直接和第一分支的注意力分支,按位相乘。将这两个分支合并后的特征图,进行分组、求和,得到最终的ASF输出特征图。

将ASF输出特征图,使用高斯非局部注意力机制,用于增强ASF的输出特征信息。在简化网络参数的同时,抑制了非目标、以及背景区域,使得特征图中的目标区域更为显著,实现对人体目标的高质量跟踪。

将目标图像块z和搜索图像块x分别输入深度特征融合的共享主干网络f,可以得到两组参考特征图f(z)和f(x)。将二者进行深度互相关操作,表示为*,从而得到候选窗口响应RoWs,表示为g,公式如下所示:

g(z,x)=f(z)*f(x)

在RoWs中构建RPN网络,可以精确地定位目标所在区域。通过在增强的ASF输出特征图上,滑动一组不同比率和尺度的锚点,映射到原始图像中,可以得到不同比率、不同尺度的感兴趣区域ROIs。

将ROIs送入具有通道注意力机制的卷积层,进一步提取特征信息,且拼接后的每个ROI都包含多个通道的特征图。这样做可以丰富高层级的语义特征信息,并且实现了基于通道的注意力机制,提升跟踪精度。

将多通道拼接后的ROIs送入三个并联的分支:边界框分支、分类分支、掩膜分支,实现对于目标的框定、分类和掩膜表示。其中边界框分支的输出结果,用于下一帧目标的框定,掩膜分支的输出结果用于定位当前帧目标位置。

提出的神经网络有三个分支输出,每个分支有自己的损失函数,用于优化各分支的性能。分别使用L

其中,x表示归一化后的距离。本文计算了归一化距离δ[0],δ[1],δ[2],δ[3],计算公式如下:

其中,A

分数分支的分类损失函数L

L

其中,p

掩膜分支的掩模损失函数L

由此可知,L

用L表示本文孪生网络的总体损失函数,L根据L

L=λ

其中,λ

以上所述实施例,仅为本申请的具体实施方式,用以说明本申请的技术方案,而非对其限制,本申请的保护范围并不局限于此,尽管参照前述实施例对本申请进行了详细的说明,本领域的普通技术人员应当理解:任何熟悉本技术领域的技术人员在本申请揭露的技术范围内,其依然可以对前述实施例所记载的技术方案进行修改或可轻易想到变化,或者对其中部分技术特征进行等同替换;而这些修改、变化或者替换,并不使相应技术方案的本质脱离本申请实施例技术方案的精神和范围。都应涵盖在本申请的保护范围之内。因此,本申请的保护范围应以所述权利要求的保护范围为准。

- 一种自适应特征融合的智能变电站人体目标跟踪方法

- 一种利用自适应特征融合的多尺度目标跟踪方法