乘员观察装置、乘员观察方法及存储介质

文献发布时间:2023-06-19 09:26:02

技术领域

本发明涉及乘员观察装置、乘员观察方法及存储介质。

背景技术

以往,对通过装置来判定车辆的乘员正在瞌睡的构成的研究不断进展。作为对于为了判定乘员正在瞌睡而言重要的要素,可举出眼睛的状态。因此,利用相机来拍摄乘员并解析图像而观察眼睛的状态的装置的实用化不断进展(例如,参照日本特开平6-266981号公报)。

发明要解决的课题

在此,有时乘员的睡意也显现于眼睛以外的部位。然而,在以往的技术中,不能做到基于眼睛的状态以外的要素来判定乘员是否正在瞌睡。

发明内容

本发明的目的之一在于提供能够精度良好地判定乘员是否正在瞌睡的乘员观察装置、乘员观察方法及存储介质。

用于解决课题的方案

本发明的乘员观察装置、乘员观察方法及存储介质采用了以下的结构。

(1)本发明的一方案的乘员观察装置具备:摄像部,其拍摄车辆的乘员的头部并生成图像;指标值导出部,其基于由所述摄像部生成的所述图像,来导出表示所述乘员的眼睛的开闭程度的指标值;倾斜推定部,其推定所述乘员的头部的倾斜度以清醒时为基准而得到的变化程度;以及判定部,其根据基于由所述指标值导出部导出的所述指标值和由所述倾斜推定部检测出的所述变化程度这双方进行判定的结果,来判定所述乘员是否正在瞌睡。

(2)的方案在上述(1)的方案的乘员观察装置的基础上,所述乘员观察装置还具备眼睛检测部,所述眼睛检测部基于由所述摄像部生成的所述图像,至少检测所述乘员的眼睛的轮廓的一部分,所述指标值导出部基于由所述眼睛检测部检测到的轮廓中的多个特征点的位置关系,来导出所述指标值。

(3)的方案在上述(1)或(2)的方案的乘员观察装置的基础上,所述判定部在所述指标值表示睁眼程度小于第一阈值、或所述指标值表示闭眼程度为第二阈值以上的状态持续了第一规定时间以上的情况下,判定为所述乘员正在瞌睡。

(4)的方案在上述(1)至(3)中任一个方案的乘员观察装置的基础上,所述判定部在所述变化程度倾斜了第三阈值以上的状态持续了第二规定时间以上的情况下,判定为所述乘员正在瞌睡。

(5)本发明的其他方案的乘员观察方法使计算机进行如下处理:拍摄车辆的乘员的头部并生成图像;基于生成的所述图像,来导出表示所述乘员的眼睛的开闭程度的指标值,并推定所述乘员的头部的倾斜度以清醒时为基准而得到的变化程度;以及根据基于导出的所述指标值和推定出的所述变化程度这双方进行判定的结果,来判定所述乘员是否正在瞌睡。

(6)本发明的其他方案的存储介质中存储的程序使计算机进行如下处理:拍摄车辆的乘员的头部并生成图像;基于生成的所述图像,来导出表示所述乘员的眼睛的开闭程度的指标值,并推定所述乘员的头部的倾斜度以清醒时为基准而得到的变化程度;以及根据基于导出的所述指标值和推定出的所述变化程度这双方进行判定的结果,来判定所述乘员是否正在瞌睡。

发明效果

根据(1)~(6),能够精度良好地判定乘员是否正在瞌睡。

根据(3)~(4),能够更加精度良好地判定乘员是否正在瞌睡。

附图说明

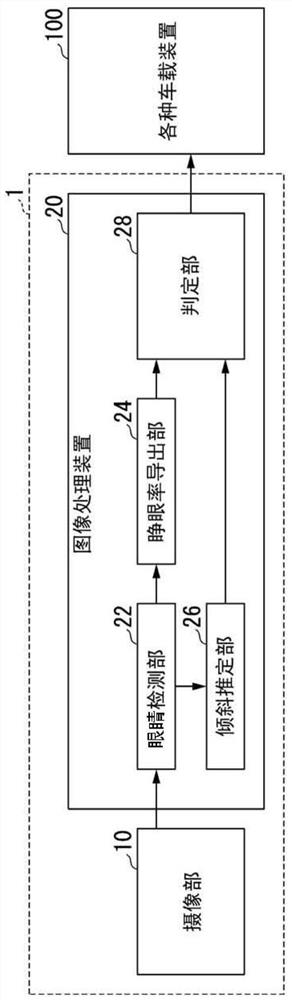

图1是示出乘员观察装置的结构和使用环境的一例的图。

图2是例示设置摄像部的位置的图。

图3是示意性地示出由眼睛检测部进行的处理的内容的图。

图4是用于对睁眼率导出部的处理进行说明的图(其1)。

图5是用于对睁眼率导出部的处理进行说明的图(其2)。

图6是示意性地示出由倾斜推定部进行的处理的内容的图。

图7是示出由图像处理装置执行的处理的流程的一例的流程图。

附图标记说明

1…乘员观察装置、10…摄像部、20…图像处理装置、22…眼睛检测部、24…睁眼率导出部、26…推定部、28…判定部、100…各种车载装置、BN…鼻梁、CL1…第一线段、CL2…第二线段、CL2d…规定线段、CT…脸的轮廓、ECT…眼睛的轮廓、EG…边缘、EW…眼睛检测窗、NM…鼻检测窗、Th1…第一阈值、Th2…第二阈值、Th3…第三阈值、α…睁眼率、β…闭眼率、θ1…角度、θ2…角度、θini…基准角度。

具体实施方式

以下,参照附图,对本发明的乘员观察装置、乘员观察方法及存储介质的实施方式进行说明。

<实施方式>

图1是示出乘员观察装置1的结构和使用环境的一例的图。乘员观察装置1例如具备摄像部10和图像处理装置20。图像处理装置20例如具备眼睛检测部22、睁眼率导出部24、倾斜推定部26及判定部28。乘员观察装置1例如判定车辆的乘员的状态是否为正在瞌睡,并将判定结果向各种车载装置100输出。乘员至少包括驾驶员,也可以包括副驾驶座乘员。各种车载装置100是驾驶支援装置、自动驾驶控制装置、智能体装置、其他装置,乘员观察装置1推定并输出与各种车载装置100的种类、目的相应的乘员的状态。

图2是例示设置摄像部10的位置的图。摄像部10例如设置于车辆的仪表板的中央部,拍摄车辆的乘员的至少头部,并生成图像。摄像部10设置于如下位置:相对于设置有转向盘SW的驾驶座DS(就座位置的一例)、以及副驾驶座AS(就座位置的另一例)中的任一个,从与它们正对的位置沿横向偏置了的位置。因此,摄像部10所生成的图像成为在横向上从斜方拍摄乘员的头部而生成的图像。换言之,成为在摄像部10的光轴上不存在乘员的至少头部的状况。

返回图1,对图像处理装置20的各部分进行说明。图像处理装置20的构成要素例如通过CPU(Central Processing Unit)等硬件处理器执行程序(软件)来实现。这些构成要素中的一部分或全部可以通过LSI(Large Scale Integration)、ASIC(ApplicationSpecific Integrated Circuit)、FPGA(Field-Programmable Gate Array)、GPU(GraphicsProcessing Unit)等硬件(包括电路部:circuitry)来实现,也可以通过软件与硬件的协同配合来实现。程序可以预先保存于HDD(Hard Disk Drive)、闪存器等存储装置(具备非暂时性的存储介质的存储装置),也可以保存于DVD、CD-ROM等能够装卸的存储介质(非暂时性的存储介质),并通过存储介质装配于驱动装置来安装。

关于眼睛检测部22的功能,作为一例,对在提取了边缘后检测眼睛的方法进行说明。眼睛检测部22例如首先在由摄像部10生成的图像(以下,称为拍摄图像)中提取边缘。边缘是指与自身的周边的像素之间的像素值的差比基准大的像素(或像素组)、即特征性的像素。眼睛检测部22例如使用SOBEL滤波器等边缘提取滤波器来提取边缘。需要说明的是,使用SOBEL滤波器仅为一例,眼睛检测部22也可以基于其他滤波器、或算法来提取边缘。

眼睛检测部22例如基于在拍摄图像中提取出的边缘的分布,来检测拍摄图像中的至少乘员的眼睛的一部分。此时,眼睛检测部22将乘员的眼睛中的与摄像部10接近的一方的眼睛作为检测对象。与摄像部10接近的一方的眼睛是指,若是就座于驾驶座DS的乘员则为左眼,若是就座于副驾驶座AS的乘员则为右眼。眼睛检测部22也可以不提取边缘,而通过将拍摄图像输入由深度学习等机器学习方法生成的学习完毕模型,来直接地检测眼睛的一部分(或后述的特征点)。

图3是示意性地示出由眼睛检测部22进行的处理的内容的图。图中,IM表示使边缘EG与拍摄图像重叠而得到的图像。另外,在本图中,专门着眼于就座于驾驶座DS的乘员。眼睛检测部22首先如图3的上图所示,通过对边缘EG拟合椭圆、鸡蛋型等模型,来提取脸的轮廓CT。接着,如图3的中图所示,眼睛检测部22以脸的轮廓CT为基准而设定鼻检测窗NM,在鼻检测窗NM中检测容易明确地提取边缘的部位即鼻梁BN的位置。接着,如图3的下图所示,眼睛检测部22以鼻梁BN的位置为基准,在应存在乘员的左眼的鼻梁BN的右侧设定规定的尺寸的眼睛检测窗EW,在眼睛检测窗EW中检测眼睛的至少一部分。由此,眼睛检测窗EW设定在与就座于驾驶座DS的乘员的左眼重合的位置,因此在眼睛检测窗EW中检测左眼。需要说明的是,对“检测眼睛的至少一部分”的处理的具体例进行各种定义,但在以下的说明中,是指“检测眼睛的轮廓的至少一部分”。在检测轮廓时,眼睛检测部22例如通过对边缘EG的分布拟合曲线模型,来检测轮廓。

睁眼率导出部24基于由眼睛检测部22检测到的眼睛的轮廓中的多个特征点的位置关系,而导出乘员的眼睛的睁眼率α。多个特征点例如包括眼睛的轮廓中的、在横向上与摄像部10接近的一侧的端部(相当于外眼角)即第一特征点、上端部即第二特征点、以及下端部即第三特征点。图4是用于对睁眼率导出部24的处理进行说明的图(其1)。图中,P1是第一特征点,P2是第二特征点,P3是第三特征点。睁眼率导出部24例如在眼睛检测窗EW内使垂直线从眼睛检测窗EW的右端朝向左假想地移动,将最开始与眼睛的轮廓ECT相交时的交点作为第一特征点P1。另外,睁眼率导出部24例如在眼睛检测窗EW内使水平线从眼睛检测窗EW的上端朝向下假想地移动,将最开始与眼睛的轮廓ECT相交时的交点作为第二特征点P2。另外,睁眼率导出部24例如在眼睛检测窗EW内使水平线从眼睛检测窗EW的下端朝向上假想地移动,将最开始与眼睛的轮廓ECT相交时的交点作为第三特征点P3。

然后,睁眼率导出部24基于将第一特征点P1与第二特征点P2连结的第一直线和将第一特征点P1与第三特征点P3连结的第二直线所成的角度,导出乘员的睁眼率α。图5是用于对睁眼率导出部24的处理进行说明的图(其2)。图中,L1为第一直线,L2为第二直线,θ1为它们所成的角度。睁眼率导出部24例如将基于从该乘员乘入车辆起最开始的几分钟程度的拍摄图像而导出的角度求平均得到的基准角度θini定义为睁眼率α的100[%],之后将所导出的角度θ1除以基准角度θini而导出睁眼率α(参照式(1))。需要说明的是,不限定于此,也可以在进行乘员的人物认证的情况下,使每个乘员的与100[%]对应的基准角度存储于存储器,并按每个乘员从存储器读出基准角度而用于计算。另外,可以将规定值设定为基准角度θini,也可以最开始使用规定值,并逐渐地与乘员的平均的角度相匹配。

α=MIN{θ1/θini,100[%]}…(1)

另外,在此前的说明中,只不过基于在图像平面上的角度θ1来导出睁眼率α,但例如,通过预先准备眼睛的三维模型,并在从根据脸朝向角度而旋转的眼睛的模型中二维地映射后进行上述说明了的处理,能够使睁眼率α的推定精度提升,所述脸朝向角度根据脸的轮廓CT与鼻梁BN的关系而推定出。另外,睁眼率导出部24也可以导出乘员的闭眼率来作为表示眼睛的开闭程度的指标值。在该情况下,睁眼率导出部24导出从100[%]减去睁眼率α而得到的值来作为闭眼率β。睁眼率α及闭眼率β是“表示眼睛的开闭程度的指标值”的一例,睁眼率导出部24是“指标值导出部”的一例,睁眼率α是“睁眼程度”的一例,闭眼率β是“闭眼程度”的一例。

图6是示意性地示出由倾斜推定部26进行的处理的内容的图。另外,在本图中专门着眼于就座于驾驶座DS的乘员。首先,倾斜推定部26利用眼睛检测部22的处理过程的一部分,如图6的上图所示,对边缘EG拟合椭圆、鸡蛋型等模型,由此提取脸的轮廓CT。接着,如图6的中图所示,倾斜推定部26检测第二线段CL2的位置,所述第二线段CL2从将由眼睛检测部22检测到的左眼与右眼连结的假想的第一线段CL1的中点连结到提取出的脸的轮廓CT的弧的中点(即,颚的位置)。也可以代替上述,倾斜推定部26通过将拍摄图像输入由深度学习等的机器学习方法生成的学习完毕模型,来直接地检测第二线段CL2。

然后,如图6的下图所示,倾斜推定部26推定以规定线段CL2d为基准而得到的第二线段CL2的变化程度。规定线段CL2d是在乘员的清醒时检测出的线段。规定线段CL2d用作评价第二线段CL2与清醒时相比倾斜了何种程度的基准。例如,在乘员乘坐车辆的时机检测规定线段CL2d。表示检测到的规定线段CL2d的信息例如存储(更新)于乘员观察装置1所具备的存储部(未图示)。倾斜推定部26例如将使第二线段CL2的下方的端部与规定线段CL2d的下方的端部重合时的第二线段CL2与规定线段CL2d所成的角度θ2推定为以规定线段CL2d为基准而得到的第二线段CL2的变化程度。

需要说明的是,在此前的说明中,只不过基于在图像平面上的角度θ2来导出变化程度,但例如通过预先准备第二线段CL2的三维模型,并在从根据脸朝向角度而旋转的第二线段CL2的模型二维地映射后进行上述说明了的处理,能够使变化程度的推定精度提升,所述脸朝向角度根据脸的轮廓CT与鼻梁BN的关系而推定出。

判定部28例如基于由睁眼率导出部24导出的睁眼率α、以及由倾斜推定部26推定出的角度θ2,来判定乘员是否正在瞌睡,并向各种车载装置100输出。例如,睁眼率α越小则判定部28判定为乘员的睡意越强,在睁眼率α小于第一阈值Th1的情况下,判定部28判定为乘员的睡意强、或乘员正在瞌睡。另外,闭眼率β越大则判定部28判定为乘员的睡意越强,在闭眼率β为第二阈值Th2以上情况下,判定部28判定为乘员的睡意强、或乘员正在瞌睡。例如,第一阈值Th1是表示能够识别乘员没有在瞌睡的状态与正在瞌睡的状态的睁眼率α的值,第二阈值Th2是表示能够识别乘员没有在瞌睡的状态与正在瞌睡的状态的闭眼率β的值。

另外,角度θ2越大则判定部28判定为乘员的睡意越强,在角度θ2为第三阈值Th3以上的情况下,判定部28判定为乘员的睡意强、或乘员正在瞌睡。第三阈值Th3是表示能够识别乘员没有在瞌睡的状态与正在瞌睡的状态的角度θ2的值。

需要说明的是,第一阈值Th1、第二阈值Th2及第三阈值Th3可以预先设定,也可以针对乘坐车辆的每个乘员而决定,还可以使用学习模型来导出,所述学习模型是通过使用了由摄像部10生成的图像的深度学习而学习得到的学习模型。

另外,判定部28在睁眼率α小于第一阈值Th1的状态持续了第一规定时间以上的情况下、或闭眼率β为第二阈值Th2以上的状态持续了第一规定时间以上的情况下,判定为乘员正在瞌睡。另外,判定部28在角度θ2为第三阈值Th3以上的状态持续了第二规定时间以上的情况下判定为乘员正在瞌睡。

[动作流程]

图7是示出由图像处理装置20执行的处理的流程的一例的流程图。首先,图像处理装置20取得由摄像部10生成的图像(步骤S100)。接着,眼睛检测部22在所取得的图像中提取边缘(步骤S102)。

眼睛检测部22基于在拍摄图像中提取出的边缘的分布,来检测拍摄图像中的至少乘员的眼睛的一部分(步骤S104)。睁眼率导出部24基于由眼睛检测部22检测到的眼睛的轮廓中的多个特征点的位置关系,来导出乘员的眼睛的睁眼率α(步骤S106)。需要说明的是,睁眼率导出部24也可以基于多个特征点的位置关系来导出乘员的眼睛的闭眼率β。

判定部28判定由睁眼率导出部24导出的睁眼率α是否小于第一阈值Th1、或闭眼率β是否为第二阈值Th2以上(步骤S108)。判定部28在判定为睁眼率α为第一阈值Th1以上、或闭眼率β小于第二阈值Th2的情况下,认为乘员没有感到睡意而结束处理。判定部28在判定为睁眼率α小于第一阈值Th1、或闭眼率β为第二阈值Th2以上的情况下,认为乘员感到了睡意,并进一步判定睁眼率α小于第一阈值Th1的状态、或闭眼率β为第二阈值Th2以上的状态是否持续了第一规定时间以上(步骤S110)。判定部28在判定为睁眼率α小于第一阈值Th1的状态、或闭眼率β为第二阈值Th2以上的状态持续了第一规定时间以上的情况下,将处理移至步骤S120,判定为乘员正在瞌睡(步骤S120)。

在由判定部28判定为乘员感到了睡意但是睁眼率α小于第一阈值Th1的状态、或闭眼率β为第二阈值Th2以上的状态未持续第一规定时间以上的情况下,倾斜推定部26基于由眼睛检测部22提取出的边缘EG,来检测第二线段CL2的位置(步骤S112)。倾斜推定部26推定以规定线段CL2d为基准而得到的第二线段CL2的变化程度(即,角度θ2)(步骤S114)。

判定部28判定由倾斜推定部26推定出的角度θ2是否为第三阈值Th3以上(步骤S116)。判定部28在判定为角度θ2小于第三阈值Th3的情况下,认为乘员没有感到睡意而结束处理。判定部28在判定为角度θ2为第三阈值Th3以上的情况下,认为乘员感到了睡意,并进一步判定角度θ2为第三阈值Th3以上的状态是否持续了第二规定时间以上(步骤S118)。

判定部28在判定为乘员感到了睡意但是睁眼率α小于第一阈值Th1的状态、或闭眼率β为第二阈值Th2以上的状态未持续第一规定时间以上、以及角度θ2为第三阈值Th3以上的状态未持续第二规定时间以上的情况下,认为乘员没有在瞌睡并结束处理。判定部28在判定为角度θ2为第三阈值Th3以上的状态持续了第二规定时间以上的情况下,判定为乘员正在瞌睡(步骤S120)。

需要说明的是,在上述中,对图像处理装置20在首先进行了睁眼率α或闭眼率β所涉及的判定处理(步骤S104~S110的处理)后进行角度θ2所涉及的判定处理(步骤S112~S118的处理)的情况进行了说明,但不限定于此。图像处理装置20例如也可以并行地进行睁眼率α或闭眼率β所涉及的判定处理和角度θ2所涉及的判定处理,还可以在进行了角度θ2所涉及的判定处理后进行睁眼率α或闭眼率β所涉及的判定处理。

如以上所说明那样,根据本实施方式的乘员观察装置1,根据基于指标值及变化程度这双方进行判定的结果,与使用任意一个指标相比能够精度良好地判定乘员是否正在瞌睡,所述指标值是通过眼睛检测部22及睁眼率导出部24的处理而导出的表示眼睛的开闭程度的指标值,所述变化程度是由倾斜推定部26推定出的乘员的头部的倾斜度以清醒时为基准而得到的变化程度。

以上使用实施方式说明了本发明的具体实施方式,但本发明丝毫不被这样的实施方式限定,在不脱离本发明的主旨的范围内能够施加各种变形及替换。

- 乘员观察装置、乘员观察方法及存储介质

- 乘员观察装置