一种基于空间特征编码改进的YOLOv3车道线检测方法

文献发布时间:2023-06-19 11:22:42

技术领域

本发明涉及深度学习无人驾驶领域,一种基于空间特征编码改进的YOLOv3车道线检测方法。

背景技术

随着科技的飞速发展与时代的变迁,人工智能已经越来越接近我们的生活,且人工智能可以为人们的生活带来诸多便捷,计算机视觉一直作为人工智能之中比较火热的一个领域,而智能驾驶主要依靠的核心技术即为基于计算机视觉的多种技术,其中车道线检测就是一个较为核心的领域。只有在准确快速地检测车道线的前提下,智能车才可以决定具体要走哪一条路线,因此设计一个快速准确检测车道线的算法系统十分必要。

传统的卷积神经网络速度较慢,且在车道线数量较多或者模糊、遮挡等情况下无法检测,YOLO算法实现了将检测问题转化为回归问题,可以较好的将检测目标与背景进行区分,而后改进的YOLOV2算法精简了算法结构,并显著提高了准确率,并具有一定的普适性;再一次改进后的YOLOV3算法既具有精确的检测率,又具有较高的速度,在目标检测领域具有较高的地位,然而YOLOV3算法也存在一些问题,如过多的卷积层会使得小目标特征难以检测,并且在这些检测算法之中,都没有充分利用车道线的空间位置信息,这导致在子任务增加的情况下,网络训练十分复杂,特别是在车道线数量较多时,位于侧面的车道线往往会因为光线、摄像头角度等问题变的模糊,使得检测任务变得困难;考虑到以上的难题,为了充分利用车道线图片中的高级语义信息从而掌握车道线的空间信息,本系统利用了一种空间特征编码技术进行对YOLOV3算法的改进,将特征图进行横向切割为多个片,将每一片进行一个卷积操作,并将上下的多个片之间进行纵向连接,通过这种方式实现对车道线空间连续特征的获取与分析,对图片的空间信息进行充分利用,从而做到对于边缘模糊的车道线也能够分析其高级语义信息,实现了在保持检测速度的同时进一步提升精度并能够充分利用空间信息检测边缘车道线。

发明内容

为解决上述问题,本发明实例提供了一种基于空间特征编码改进的YOLOv3车道线检测方法,目的是在保证当前检测速度的前提下增加检测准确率并实现检测图像边缘车道线的能力,包括以下形成步骤:

步骤一,将图像进行预处理,重塑大小变为416×416宽高的统一尺寸图像;

步骤二,将预处理后的图像输入特征提取网络提取特征,首先得到第一个尺度特征图;

步骤三,将特征图进行16倍上采样,与前层特征进行融合,之后将融合特征继续进行卷积,得到第二尺度特征;

步骤四,将第二尺度特征进行8倍上采样,与前层特征融合,将融合特征继续输入后续特征提取网络,得到第三尺度特征;

步骤五,将三种不同尺度特征分别进行空间特征编码,得到编码处理后的特征图;

步骤六,将新的特征图输入YOLO层进行车道线检测;

步骤七,将检测图像进行标注以及非极大抑制处理,计算损失函数;

步骤八,将得到的结果图像保存并输出;

优选的,在步骤一中,将图片尺寸放缩为416×416尺度,这一尺度在实验当中具有较高的检测准确率与速度,是同时兼顾速度与精度的一个较为高效的尺度规模;

优选的,在步骤二中,网络采用改进的Darknet-53网络,为了避免卷积深度过大的退化问题,将五次上采样更改为两次,减少网络深度,交替使用1×1以及3×3卷积核进行卷积,并引用类似ResNet的残差结构模块实现特征的映射与融合,使得计算量减少而特征提取更高效,并且具备较强的深度训练低误差能力,网络中卷积实现包括卷积、BatchNormalization以及Leaky ReLU三部分,以上模块共同构成基础特征提取的部分;

优选的,步骤三、四中的上采样均使用双线性插值的方法,使得算法精确且运算量较小;

优选的,步骤五中空间特征编码结构包括自顶向下和自底向上两个方向的特征传递,包括以下形成步骤:

步骤一,将三维张量进行横向按行分割,一个高度为H的张量分割为H片,自顶向下标记为1,2,H片;

步骤二,按照自顶向下的方式,从第1片开始运算,将第1片进行卷积操作,后接ReLU非线性激活函数,得到处理过后的第1片空间特征;

步骤三,将步骤二中得到的特征按对应元素相加到第2片中,实现对第2片的更新,此时第2片得到第1片的空间特征信息;

步骤四,重复步骤二、三,直到第H片更新完毕,此时完成自顶向下的特征传递;

步骤五,将顺序翻转,按照自底向上的顺序,对第H片进行卷积以及ReLU操作,得到第H片的空间特征,并将特征传递给第H-1片;

步骤六,重复步骤五,直到第1片更新完毕,此时完成自底向上的特征传递;

步骤七,将以上步骤结果获得的H片特征进行拼接,得到一个高度为H的三维张量,此即为经过空间特征编码后的特征图;

优选的,使用logistic regression的方式进行车道线检测而非传统的softmax,实现对多标签对象的检测,检测公式如下:

b

b

Pr(object)*IOU(b,object)=σ(t

其中,cx,cy表示grid cell的偏移量,其数值为grid cell左上角坐标,ph,pw为预设的anchor锚框大小,而tx,ty,th,tw为YOLO卷积模型中的4个预测值,其中σ(z)的计算公式为:

优选的,使用三项求和损失函数,从anchor置信度、anchor位置偏移、anchor预测误差三个方面进行综合误差分析,损失函数公式如下:

loss=lbox+lobj+lcls

其中,B为YOLO每个网格中预测的边界框个数,C为整个算法的总分类数,S为图像划分系数,p为对应类别的预测概率,c=0,1,…C为类别序号,i=0,1,…S

优选的,空间特征编码使用自顶向下和自底向上两中方式,使得不同层之间的特征充分传递融合;

优选的,本发明采用空间编码处理特征,使得原有的特征能够附加空间特征,实现对隐藏层高级语义信息的利用,探索车道线空间连续性特征,能够实现对边缘车道线的准确检测。

与现有技术相比,本发明实例中采用空间特征编码技术对YOLOv3进行改进,将提取到的特征进行空间特征编码,提取分析图像中的空间语义信息,使得传统算法难以解决的边缘车道线检测问题得以解决,并取得较为优秀的效果。且在anchor计算之中采用K-means++技术并使用IOU代替传统欧氏距离进行聚类,使得参数更为精确,受随机性影响较低。在网络之中进行残差网络的改进以及卷积层后归一化的操作使得网络可以进行更为复杂的深度训练而误差较低,具有较强的鲁棒性。

附图说明

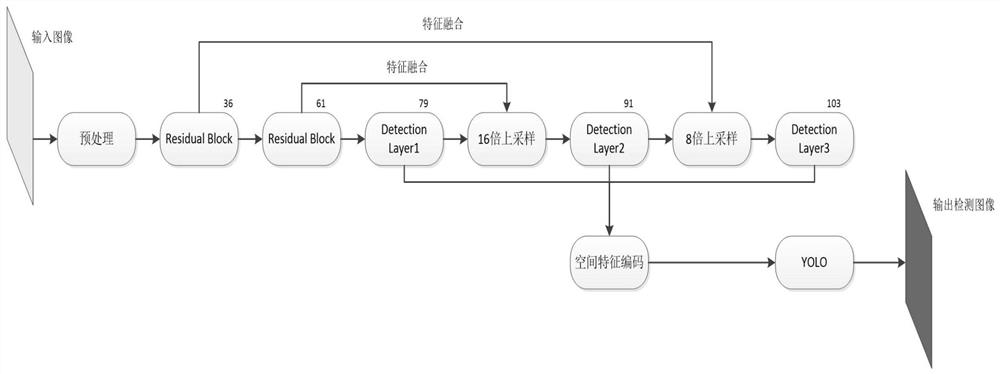

图1为本发明的一种基于空间特征编码改进的YOLOv3车道线检测方法的形成步骤的整体流程图;

图2为本发明的一种基于空间特征编码改进的YOLOv3车道线检测方法的形成步骤中的Residual Block模块;

图3为本发明的一种基于空间特征编码改进的YOLOv3车道线检测方法的形成步骤中的卷积细节模块;

图4为本发明的一种基于空间特征编码改进的YOLOv3车道线检测方法的形成步骤中的特征融合模块;

图5为本发明的一种基于空间特征编码改进的YOLOv3车道线检测方法的形成步骤中的空间特征编码模块;

图6、7为本发明的一种基于空间特征编码改进的YOLOv3车道线检测方法的结果展示。

具体实施方式

下面将结合本发明实施例中的附图,对本发明实施例中模型方案进行完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本发明保护的范围。

请参阅图1,本发明提供一种基于空间特征编码改进的YOLOv3车道线检测方法,该发明实例形成步骤为:

步骤一,将图像进行预处理,重塑大小变为416×416宽高的统一尺寸图像;

步骤二,将预处理后的图像输入特征提取网络提取特征,采取Darknet-53网络进行特征提取,网络共53个卷积层,分为三个尺度的特征图提取过程,并且在卷积操作之中附加Batch Normalization归一化以及Leaky ReLU非线性激活操作,并结合使用残差结构Residual Block,。首先使用多层1×1卷积核,步长为1对图像进行卷积,再使用3×3卷积核,步长为2进行进一步卷积,卷积核的数量逐渐增加至512,在网络第79层首先获得一个13×13×512的特征张量;

其中残差结构Residual Block如图2所示,卷积操作附加细节如图3所示,使用残差结构与归一化处理可以使得模型具备深度复杂训练的能力,且将数据重新分布,增加模型的泛化能力。

步骤三,将上一步特征图进行16倍上采样,与网络第61层的卷积所得到的特征进行融合,之后将融合特征继续进行3×3卷积,卷积核数量为728,在网络第91层获得26×26×728尺度的特征图;

特征融合结构与过程如下图4所示,特征融合即将尺度不同的特征图关联起来,本发明之中的特征融合使用双线性插值上采样的技术先将低维度特征图进行上采样使得其与高维度特征尺寸一致,再经过3×3卷积核进行卷积操作,并同时对高维度特征图采取尺度相同的3×3卷积核进行操作以保证两个特征尺度相同,之后将两个特征图进行融合,在使用卷积时卷积核的种类较多,在尝试过5×5,7×7等尺寸的卷积核之后,实验证明使用3×3卷积尺寸效果最优越。

步骤四,将步骤三所得特征进行8倍上采样,与网络第36层特征融合,将融合特征继续输入后续特征提取网络,在网络第103层获得52×52×384尺度的特征图;

步骤五,将三种不同尺度特征分别进行空间特征编码,得到编码处理后的特征图;空间特征编码结构与过程如下图5所示;传统车道线检测算法很难检测边缘车道线特别是当车道线数量过多且边缘较为模糊之时,究其原因是没有有效利用图像的空间结构信息与车道线的连续性信息,因此本发明采用空间特征编码的方式处理提取特征,使得其能够充分利用车道线空间连续性特征以及图像的高级语义信息;

步骤六,将新的特征图输入YOLO层进行车道线检测,在检测的过程中使用logistic regression的方式进行车道线检测而非传统的softmax,实现对多标签对象的检测,检测公式如下:

b

b

Pr(object)*IOU(b,object)=σ(t

其中,cx,cy表示grid cell的偏移量,其数值为grid cell左上角坐标,ph,pw为预设的anchor锚框大小,而tx,ty,th,tw为YOLO卷积模型中的4个预测值,其中σ(z)的计算公式为:

步骤七,将检测图像进行标注以及非极大抑制处理,计算损失函数,使用三项求和损失函数,从anchor置信度、anchor位置偏移、anchor预测误差三个方面进行综合误差分析,损失函数公式如下:

loss=lbox+lobj+lcls

其中,B为YOLO每个网格中预测的边界框个数,C为整个算法的总分类数,S为图像划分系数,p为对应类别的预测概率,c=0,1,…C为类别序号,i=0,1,…S

步骤八,将得到的结果图像保存并输出;

其中在步骤五空间特征编码的具体过程包括以下步骤:

步骤一,将三维张量进行横向按行分割,一个高度为H的张量分割为H片,自顶向下标记为1,2,H片;

步骤二,按照自顶向下的方式,从第1片开始运算,将第1片进行卷积操作,后接ReLU非线性激活函数,得到处理过后的第1片空间特征;

步骤三,将步骤二中得到的特征按对应元素相加到第2片中,实现对第2片的更新,此时第2片得到第1片的空间特征信息;

步骤四,重复步骤二、三,直到第H片更新完毕,此时完成自顶向下的特征传递;

步骤五,将顺序翻转,按照自底向上的顺序,对第H片进行卷积以及ReLU操作,得到第H片的空间特征,并将特征传递给第H-1片;

步骤六,重复步骤五,直到第1片更新完毕,此时完成自底向上的特征传递;

步骤七,将以上步骤结果获得的H片特征进行拼接,得到一个高度为H的三维张量,此即为经过空间特征编码后的特征图;

本发明采用空间编码处理特征,使用自顶向下和自底向上两中方式,使得不同层之间的特征充分传递融合,使得原有的特征能够附加空间特征,实现对隐藏层高级语义信息的利用,探索车道线空间连续性特征,能够实现对边缘车道线的准确检测。

通过使用通用测试数据的实际测试,本发明实例的平均像素交叠率达到了72.5%,mAP值达到了95%,相比传统YOLOv3提升约12%,处理速度达到45fps,并且能够准确检测出边缘车道线,克服了传统算法中难以检测多车道线中边缘的问题,并具有实时检测的能力,可以运用在智能驾驶领域之中。实际效果如下图6、7所示

综上所述,本发明实例中的一种基于空间特征编码改进的YOLOv3车道线检测方法,首先将输入图像进行预处理,然后输入Darknet-53网络进行特征提取,先获得13×13尺度的特征,将其进行16倍上采样与前层特征融合,再进行卷积得到26×26尺度的特征图,对其进行8倍上采样并与前层特征融合,再进行卷积得到52×52尺度特征图,将三种尺度的特征图分别进行空间特征编码使其利用空间特征信息,将处理后的特征图输入YOLO层使用logistic regression进行车道线检测并输出经过检测标注的图像。本发明实例采用空间特征编码对YOLOv3算法进行改进,使得改进后的算法即具备YOLOv3的快速高效检测特征,又可以使用空间特征编码对于隐藏层高级语义信息的利用实现对较多条车道线以及边缘模糊车道线的检测。

尽管已经示出和描述了本发明的实施例,对于本领域的普通技术人员而言,可以理解在不脱离本发明的原理和精神的情况下可以对这些实施例进行多种变化、修改、替换和变型,本发明的范围由所附权利要求及其等同物限定。

- 一种基于空间特征编码改进的YOLOv3车道线检测方法

- 基于无监督深度空间特征编码的航拍图像分类方法