基于类别掩码的神经网络剪枝方法

文献发布时间:2023-06-19 13:49:36

技术领域

本发明涉及人工神经网络的压缩与加速,尤其是涉及一种基于类别掩码的神经网络剪枝方法。

背景技术

卷积神经网络(CNN)在计算机视觉的多个领域取得巨大的突破,例如图像分类、图像超分、目标检测等,然CNN对计算开销的巨大需求限制其在移动和小型设备上的应用。为解决该问题,研究人员开发几种用于CNN压缩的技术,例如网络修剪、参数量化、张量分解和知识蒸馏等。其中,通道剪枝因其与通用硬件和基本线性代数子程序(BLAS)库的方便适配而引起越来越多的关注。

通道剪枝的核心思想是删除神经网络中卷积核里的整个通道,从而以较少的计算成本生成原始CNN的子网络。现有研究大致可分为两类。第一类方法一般为三步剪枝流程,包括预训练初始模型模型,选择“重要”的通道和微调训练子网络。通常,该类别的大多数工作都将重点放在第二步,即找出过滤器重要性估计值,例如l1范式、几何信息和激活值稀疏程度,或将通道剪枝视为优化问题。第二类通过对网络进行从头开始的重新训练并在每个通道上施加额外的稀疏性约束来实现动态的通道剪枝。

尽管通道剪枝过去几年取得进步,但现有的方法只通过观察CNN输出,即最终分类性能来进行通道剪枝,而几乎没有考虑CNN模型的内部影响。Li等人(Hao Li,Asim Kadav,Igor Durdanovic,Hanan Samet,and Hans Peter Graf.Pruning filters for efficientconvnets.In Proceedings of the International Conference on LearningRepresentations[C],2017)删除具有较小l1范数的通道,实际上可以将其视为使原始模型与修剪后的模型之间的输出差异最小化。CNN内的大量非线性操作使得研究人员无法解释剪枝内部的原理,因此,现有方法选择将CNN视为黑盒,并观察网络修剪的最终输出。从这个角度来看,这些方法可称为“黑盒剪枝”。

尽管如此,解深层CNN的内部解释已引起越来越多的关注,这也推进各种视觉任务的进步。例如,Zeiler等人(Matthew D Zeiler and Rob Fergus.Visualizing andunderstanding convolutional networks.In European conference on computervision[C],pages 818–833.Springer,2014)通过内部特征图的可视化调整架构赢得ILSVRC-2013冠军。受此启发,认为探索CNN的内部逻辑可能是指导频道修剪的有前途的前景。Yosinki等人(Jason Yosinski,Jeff Clune,Anh Nguyen,Thomas Fuchs,and HodLipson.Understanding neural networks through deep visualization.In DeepLearning Workshop,International 1053Conference on Machine Learning[C],2015)发现每个通道会激活一个特征图中的特定区域。

发明内容

本发明的目的在于针对目前已有剪枝方法中的不可解释性,可能导致次优性能等问题,提供具有可解释性的、高效的一种基于类别掩码的神经网络剪枝方法。为模拟每个通道对差异类别的贡献,为每个通道分配一个类别掩码,从而得到每个通道对不同类识别的贡献。

本发明包括以下步骤:

1)为神经网络中每一个通道分配一个类别掩码,其维度等于数据集图像类别数;

2)基于输入图像的类别激活相应的掩码来进行训练网络;

3)基于训练后的类别掩码进行全局投票,剪枝分数较小的通道;

4)对保留下来的卷积核继续进行训练,得到最终的剪枝网络。

在步骤2)中,所述基于输入图像的类别激活相应的掩码来进行训练网络,具体为:当训练类别A时,即激活通道对应的类别A的掩码与该通道生成的特征图进行相乘,进行前向和反向传播。

在步骤3)中,所述基于训练后的类别掩码进行全局投票,即对每个通道的类别掩码进行取和操作。

本发明具有以下突出优点:

1)使用一种类别掩码技术来找到网络中的通道对不同类的识别贡献,去保留那些对大多数类有识别作用的通道,从而获得性能优异且紧凑的剪枝模型,具有较好的可解释性。

2)在没有引入额外人工约束情况下,本发明提出的基于类别掩码网络剪枝方案,性能相对于以往剪枝方案有很大的提升。相比于未剪枝的网络模型,本发明实现神经网络模型大程度的压缩与加速。例如,在ResNet上,能够移除65.23%的浮点型运算,同时甚至能够提高0.62%在CIFAR-10数据集上的图片分俩准确率;在ResNet-50上,本发明可以移除45.6%浮点型运算,并且只在ImageNet数据集上损失0.83%的分类准确度。

3)本发明的剪枝方案可以直接应用在大规模的分类、检测、分割等应用系统中,非参数自适应神经网络剪枝方案使得模型要求极小的计算量和存储量,能够极大地便利主流网络模型在资源受限的嵌入式设备中的使用。

附图说明

图1为本发明的发明动机示意图;

图2为本发明剪枝方案的框架图;

图3为不同超参数对剪枝性能影响的对比图。

具体实施方式

以下实施例将结合附图对本发明作进一步的说明。本发明目的在于能够自动地找到神经网络中每一个通道对识别不同类别图片的贡献,从而保留那些对大多数类都有较大贡献的通道。本发明将ImageNet上训练的VGG16-Net生成的特征图可视化,以探索CNN内部层中的本地信息。从图1可以看出,第12个卷积层的第5个通道总是生成包含头部信息的特征图,而第144个通道尝试激活文本信息。即使没有明确标记的标题或文本,该CNN模型也会自动学习提取部分信息以做出更好的决策,这在分类图像时完全符合人类的直觉。即,由第5通道提取的头部信息有助于网络识别动物,而由第144通道提取的文本信息则有助于用文本(例如数字手表)对类别进行分类。但是,某些局部特征可能不利于识别所有类别。例如,在处理没有文本语义的图像(例如狗和熊猫)的图像时,第144个通道始终选择不激活大多数像素点(如图1中的第三和第五列)。CNN中间层上的此类局部特征表明,通道对图像分类中的不同类别有不同的贡献,这促使重新考虑通道修剪的重要性标准。

本发明剪枝算法流程如表1。

表1

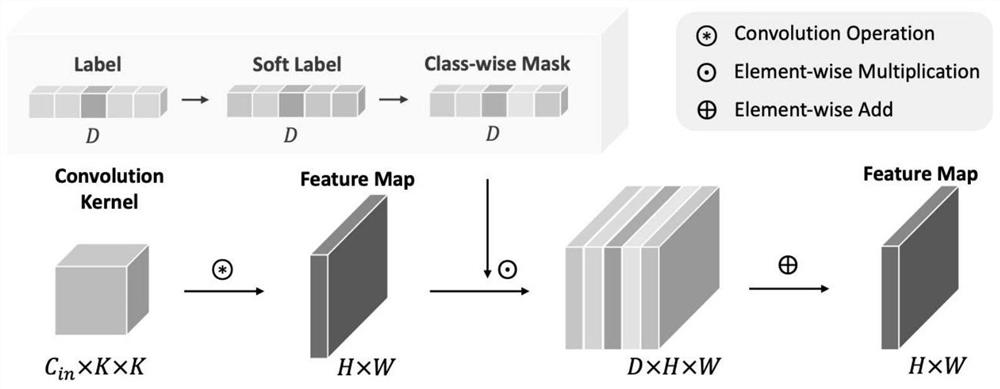

本发明剪枝方案的框架图如图2,具体步骤如下:

首先为每一层的卷积核W

其中,

该掩码的设计理念在于,在反向传播的过程中,掩码

值得注意的是,与以往方法不同,本发明中的训练方法更加依赖于标签,因为标签信息会指导每一层的卷积操作,这通常会带来过拟合的问题,即在前向过程中引入标签,这与测试阶段的数据流动差别较大。受label-smoothing正则项(Christian Szegedy,Vincent Vanhoucke,Sergey Ioffe,JonShlens,and Zbigniew Wojna.Rethinking theinception architecture for computer vision.In Proceedings of the IEEEconference on computer vision and pattern recognition(CVPR)[C],pages 2818–2826,2016)的启发,提出对标签进行松弛化,每个标签将被松弛为:

其中,

基于松弛的标签,卷积操作被定义为

为实现通道剪枝,为每个掩码添加稀疏约束:

如果某个通道收到的梯度较小,那么稀疏约束就会将通道对应的掩码惩罚到绝对值接近0,反之,如果某个通道对大部分类都有较大的识别贡献,那么其对应的类别掩码都会保持比较高的绝对值大小。最终的损失函数为:

在对该类别掩码进行较少的训练轮后(完整训练轮数的十分之一),基于训练后的类别掩码进行全局投票,具体而言,每个通道的重要性分数为:

在进行投票之后,将类别掩码融入卷积核本身权重中,由于在松弛时采用标准分布

最后,对剪枝网络进行微调(fine-tune)训练以完成剪枝流程。

CIFAR-10数据集中VGGNet-16与其他剪枝方案的性能比较见表2。

表2

CIFAR-10数据集中ResNet-32与其他剪枝方案的性能比较见表3。

表3

CIFAR-10数据集中ResNet-56与其他剪枝方案的性能比较见表4。

表4

CIFAR-10数据集中MobileNet-v2与其他剪枝方案的性能比较见表5。

表5

ImageNet数据集中ResNet50与其他剪枝方案的性能比较见表6。

表6

表2~5展示本发明提出的剪枝方案在CIFAR-10和ImageNet数据集上与其他现金方法的性能对比。表6对不加入软掩码以及不加入类别掩码的方式进行消融分析,发现本发明提出的类别软掩码是效果最优的。

图3中分析不同超参数对剪枝模型性能的影响,发现本发明提出的算法对超参数不敏感,具有较好的泛化能力和应用前景。

实验表明,本发明提出的可解释性通道剪枝算法性能优于目前的先进技术。

- 基于类别掩码的神经网络剪枝方法

- 一种基于类别的滤波器剪枝方法