基于BERT模型的医学应用模型训练方法及装置

文献发布时间:2023-06-19 09:51:02

技术领域

本发明涉及自然语言处理技术领域,尤其涉及一种基于BERT模型的医学应用模型训练方法及装置。

背景技术

在当今自然语言处理领域,预训练语言模型开创了研究的新范式,刷新了多项自然语言处理任务的最好水平。预训练语言模型即先基于大量无监督语料进行语言模型预训练(Pre-training),再使用少量标注语料进行微调(Fine-tuning)来完成文本分类、序列标注、机器翻译、阅读理解等下游NLP任务。

预训练语言模型BERT,引入了MLM(Masked Language Model)及NSP(NextSentence Prediction,NSP)两个预训练任务,并在更大规模语料上进行预训练,在11项自然语言理解任务上刷新了最好指标。为了保证BERT模型的通用性,BERT所基于的大规模语料覆盖各个知识领域,基于这样的语料训练出来的预训练语言模型可用于解决不同领域的自然语言问题,但也会导致用这样语料训练出来的预训练语言模型在一些专业领域上的表现一般,无法适应性的解决专业领域的自然语言问题。

目前的预训练语言模型虽然在一般通用领域内表现较好,但由于其基于的大规模语料并非针对某一特定领域,所以目前常用的预训练语言模型无法很好的解决专业领域内的自然语言处理问题。在医学领域,这一缺点尤为严重,因为医学领域专业性极强,并且在医学领域使用深度学习模型的容错程度更低,所以目前常用的预训练语言模型如BERT等,在医学领域的适用性不好,无法解决医学领域某些特定研究场景下的自然语言问题。

因此,如何提供一种模型方案,能够更好地在医学领域适用,提高医学领域特定研究场景下的自然语言的理解能力,是本领域技术人员亟待解决的技术问题。

发明内容

本发明实施例提供一种基于BERT模型的医学应用模型训练方法及装置,能够更好地在医学领域适用,提高医学领域特定研究场景下的自然语言的理解能力。

本发明实施例提供一种基于BERT模型的医学应用模型训练方法,包括:

获取循证医学训练样本;

对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;

利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型;

其中,所述实体词汇对应于循证医学中具有实际意义的实体。

进一步地,所述获取循证医学训练样本包括:

获取医学文献;

在所述医学文献中提取PICO实体;所述PICO实体包括:问题的对象、干预措施、备选措施、结果;

将每篇医学文献中的PICO实体确定为一条循证医学训练样本。

进一步地,所述对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本包括:

对所述循证医学训练样本进行分词,得到分词结果;

将所述分词结果与PICO实体进行对齐,得到对齐结果;

利用所述对齐结果中的实体词汇对所述循证医学训练样本进行屏蔽,得到MLM训练样本;

其中,所述PICO实体为循证医学中具有实际自然意义的实体。

进一步地,所述实体词汇包括以下至少一种:疾病种类词汇、药物词汇、生物酶词汇、病理反应词汇。

进一步地,所述利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型包括:

将BERT模型置于训练模式;

将所述MLM训练样本输入所述BERT模型,得到训练后的BERT模型;

将训练后的BERT模型确定为PICO-BERT模型。

进一步地,删除所述PICO-BERT模型中的NSP训练任务。

第二方面,本发明实施例提供一种基于BERT模型的医学应用模型训练装置,包括:

样本获取模块,用于获取循证医学训练样本;

样本处理模块,用于对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;

模型训练模块,用于利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型;

其中,所述实体词汇对应于循证医学中具有实际意义的实体。

进一步地,所述样本处理模块包括:

分词单元,用于对所述循证医学训练样本进行分词,得到分词结果;

对齐单元,用于将所述分词结果与PICO实体进行对齐,得到对齐结果;

屏蔽单元,用于利用所述对齐结果中的实体词汇对所述循证医学训练样本进行屏蔽,得到MLM训练样本;

其中,所述PICO实体为循证医学中具有实际自然意义的实体。

本发明实施例还提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现如上述任一种所述基于BERT模型的医学应用模型训练方法的步骤。

本发明实施例还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现如上述任一种所述基于BERT模型的医学应用模型训练方法的步骤。

本发明实施例提供的一种基于BERT模型的医学应用模型训练方法及装置,利用循证医学训练样本将BERT模型进行MLM训练,而且训练时,对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;利用屏蔽实体词汇得到的MLM训练样本进行MLM训练,得到PICO-BERT模型,从而增强模型的整体语义表征能力,使得训练的PICO-BERT模型语义理解能力更强,对特定领域复杂场景的自然语言问题处理能力更强,能够更好地在医学领域适用,提高医学领域特定研究场景下的自然语言的理解能力。

附图说明

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作一简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

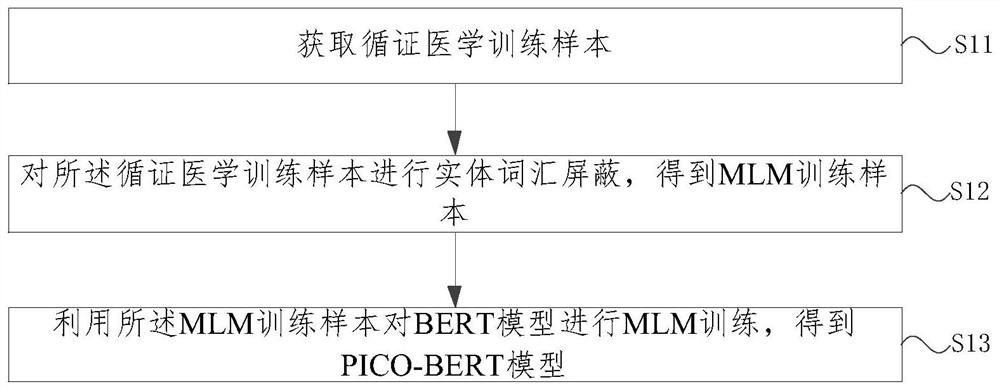

图1为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的流程图;

图2为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的样本获取流程图;

图3为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的样本处理流程图;

图4为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的模型训练流程图;

图5为本发明实施例提供一种基于BERT模型的医学应用模型训练装置的组成示意图;

图6为本发明实施例提供一种基于BERT模型的医学应用模型训练装置的样本处理模块组成示意图;

图7是本发明实施例提供的一种电子设备的结构示意图。

具体实施方式

为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

下面结合图1-图4描述本发明实施例的一种基于BERT模型的医学应用模型训练方法。

图1为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的流程图;图2为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的样本获取流程图;图3为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的样本处理流程图;图4为本发明实施例提供的一种基于BERT模型的医学应用模型训练方法的模型训练流程图。

在本发明一种具体实施方式中,本发明实施例提供一种基于BERT模型的医学应用模型训练方法,包括:

步骤S11:获取循证医学训练样本;

在本发明实施例中,首先需要获取循证医学训练样本,循证医学是指将最佳临床证据、熟练的临床经验和患者的具体情况这三大要素循证医学紧密结合在一起寻找和收集最佳临床证据,旨在得到更敏感和更可靠的诊断方法,更有效和更安全的治疗方案,力争使患者获得最佳治疗结果。可见循证医学的研究覆盖诊疗的全部流程,并且能充分体现医学知识的实际价值。PICO是基于循证医学(EBM)理论的一种将信息格式化的检索方式。为participants,interventions,comparisons,utcomes的缩写。P为问题的对象(patientrpopulation,患者或人群),I为干预措施(intervention,如诊断治疗方法),C为其他备选措施(comparison,即比较因素),O为结果(outcome,即干预措施的诊疗效果)。每一篇医学文献中,都会有PICO。

步骤S12:对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;

循证医学训练样本,本发明实施例中还要进行特异化的具处理,体地,可以基于循证医学知识,搭建循证医学领域的知识图谱,然后通过实体抽取的方法,将循证医学知识图谱内部包含的PICO实体抽取出来,这些实体就是一些带有循证医学意义的医学实体。

在现有的BERT预训练过程包含两个不同的预训练任务,分别是Masked LanguageModel任务和Next Sentence Prediction任务。Masked Language Model(MLM)通过随机遮盖一些词,然后预测这些被遮盖的词来训练双向语言模型,并且使每个词的表征参考上下文信息。但原BERT遮盖时,对于英文来说是遮盖一个词,对于中文来说是遮盖一个字,这种聚焦单字的建模策略,只学习到了实体内单字之间共现关系,并没有学习到实体的整体语义表示。

步骤S13:利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型;其中,所述实体词汇对应于循证医学中具有实际意义的实体。

另外,在Masked Language Model(MLM)任务中,随机”遮蔽”时,不再选择遮蔽单字,而是选择“遮蔽”实体对应的词。这需要我们在预训练之前,对语料做分词,并将分词结果和循证医学图谱抽取出的PICO实体对齐。例如:亚甲基四氢叶酸还原酶(I)基因多态性与急性淋巴细胞白血病(P)患者甲氨蝶呤(P)化疗药物不良反应的相关性研究,PICO-BERT需要根据“基因多态性”,“化疗药物”,“不良反应”等信息,准确的预测出“亚甲基四氢叶酸还原酶”、“白血病”、“甲氨蝶呤”。通过“实体遮蔽”的方式,将实体知识融入到PICO-BERT模型的预训练过程中。PICO-BERT可以学到“基四氢叶酸还原酶”、“白血病”、“甲氨蝶呤”这些实体的语义表示,以及它跟上下文其他实体之间的关联,增强了模型语义表征能力。

另外,在BERT模型存在,Next Sentence Prediction任务,而Next SentencePrediction(NSP)为了训练一个理解句子间关系的模型,引入一个下一句预测任务。但是去掉NSP任务之后,模型效果在本发明实施例中也不会受到影响,因此,可以删除PICO-BERT模型中的NSP训练任务,精简模型。

具体地,为了获取循证医学训练样本可以进行以下步骤:

步骤S21:获取医学文献;

步骤S22:在所述医学文献中提取PICO实体;所述PICO实体包括:问题的对象、干预措施、备选措施、结果;

步骤S23:将每篇医学文献中的PICO实体确定为一条循证医学训练样本。

也就是说,现有的医疗文献,病例中存在大量的可以利用的数据,但是这些数据并不是BERT模型可以直接使用的形式,因此,本发明实施例中按照PICO的格式,将这些医学文献中具有价值的数据提取出来,从而得到一条条的循证医学训练样本。当然,也不一定是医疗文献,也可以是医院里的病例实践等其他方式获得的PICO格式的训练样本。

更进一步地,为了对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本包括:

步骤S31:对所述循证医学训练样本进行分词,得到分词结果;

步骤S32:将所述分词结果与PICO实体进行对齐,得到对齐结果;

步骤S33:利用所述对齐结果中的实体词汇对所述循证医学训练样本进行屏蔽,得到MLM训练样本;其中,所述PICO实体为循证医学中具有实际自然意义的实体。

也就是说,可以对循证医学训练样本进行分词,然而并PICO实体进行对齐,具体地可以利用循证医学图谱抽取出的PICO实体建立PICO词典,在进行循证医学样本的分词对齐时,可以利用PICO词典中的PICO词条进行对齐,从而在进行MLM训练样本的随机遮蔽时,使用PICO词典中的PICO实体的词条进行遮蔽,从而得到MLM训练样本。具体地,实体词汇包括以下至少一种:疾病种类词汇、药物词汇、生物酶词汇、病理反应词汇。

在上述任一实施例的基础上,本实施例中,为了利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型可以具体进行以下步骤:

步骤S41:将BERT模型置于训练模式;

步骤S42:将所述MLM训练样本输入所述BERT模型,得到训练后的BERT模型;

步骤S43:将训练后的BERT模型确定为PICO-BERT模型。

现有多种预训练好的BERT模型,有针对不同语言的和不同模型大小的。对于中文模型,本发明实施例中可以使用[Bert-Base,Chinese],当然也可以选择其他的版本,之后将该BERT模型置于训练模式,将准备好的MLM训练样本输入,训练完成后得到PICO-BERT模型。

本方实施例将循证医学研究知识融合进预训练语言模型中,训练了更适配循证医学业务场景的PICO-BERT模型,使其能够适应医学领域的特定场景需求。并通过微调将PICO-BERT落地到多个业务场景中,取得更好的业务效果

本发明实施例充分发挥领域数据的优势,在训练的PICO-BERT模型上加入领域数据继续训练进行医学领域自适应,完成领域迁移,使得模型更适合解决医学领域的自然语言问题。本发明实施例重新设置了BERT模型的预训练任务,不仅精简模型,去掉了NSP任务,还将MLM任务中的单字遮蔽方式改成实体遮蔽的方式,从而实现在预训练过程中融入循证医学知识图谱中的PICO实体信息,进一步增强模型的整体语义表征能力,使得训练的PICO-BERT模型语义理解能力更强,对特定领域复杂场景的自然语言问题处理能力更强。

请参考图5、图6,图5为本发明实施例提供一种基于BERT模型的医学应用模型训练装置的组成示意图;图6为本发明实施例提供一种基于BERT模型的医学应用模型训练装置的样本处理模块组成示意图。

下面对本发明实施例提供的基于BERT模型的医学应用模型训练装置进行描述,下文描述的基于BERT模型的医学应用模型训练装置与上文描述的基于BERT模型的医学应用模型训练方法可相互对应参照。

在本发明又一具体实施方式中,本发明实施例提供一种基于BERT模型的医学应用模型训练装置500,包括:

样本获取模块510,用于获取循证医学训练样本;

样本处理模块520,用于对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;

模型训练模块530,用于利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型;

其中,所述实体词汇对应于循证医学中具有实际意义的实体。

进一步地,所述样本处理模块520包括:

分词单元521,用于对所述循证医学训练样本进行分词,得到分词结果;

对齐单元522,用于将所述分词结果与PICO实体进行对齐,得到对齐结果;

屏蔽单元523,用于利用所述对齐结果中的实体词汇对所述循证医学训练样本进行屏蔽,得到MLM训练样本;

其中,所述PICO实体为循证医学中具有实际自然意义的实体。

本发明实施例提供的一种基于BERT模型的医学应用模型训练方法及装置,利用循证医学训练样本将BERT模型进行MLM训练,而且训练时,对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;利用屏蔽实体词汇得到的MLM训练样本进行MLM训练,得到PICO-BERT模型,从而增强模型的整体语义表征能力,使得训练的PICO-BERT模型语义理解能力更强,对特定领域复杂场景的自然语言问题处理能力更强,能够更好地在医学领域适用,提高医学领域特定研究场景下的自然语言的理解能力。

图7示例了一种电子设备的实体结构示意图,如图7所示,该电子设备可以包括:处理器(processor)710、通信接口(Communications Interface)720、存储器(memory)730和通信总线740,其中,处理器710,通信接口720,存储器730通过通信总线740完成相互间的通信。处理器710可以调用存储器730中的逻辑指令,以执行基于BERT模型的医学应用模型训练方法,该方法包括:获取循证医学训练样本;对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型;其中,所述实体词汇对应于循证医学中具有实际意义的实体。

此外,上述的存储器730中的逻辑指令可以通过软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:U盘、移动硬盘、只读存储器(ROM,Read-Only Memory)、随机存取存储器(RAM,Random Access Memory)、磁碟或者光盘等各种可以存储程序代码的介质。

另一方面,本发明实施例还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现以执行上述各实施例提供的基于BERT模型的医学应用模型训练方法,该方法包括:获取循证医学训练样本;对所述循证医学训练样本进行实体词汇屏蔽,得到MLM训练样本;利用所述MLM训练样本对BERT模型进行MLM训练,得到PICO-BERT模型;其中,所述实体词汇对应于循证医学中具有实际意义的实体。

以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如ROM/RAM、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行各个实施例或者实施例的某些部分所述的方法。

最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

- 基于BERT模型的医学应用模型训练方法及装置

- 基于Bert的语言模型的训练方法及装置