用于使用帧间预测的特征点跟踪的设备和方法

文献发布时间:2023-06-19 11:21:00

技术领域

本发明一般地涉及图形处理器领域。更特别地,本发明涉及用于使用帧间预测来跟踪视频图像中的特征点的设备和方法。

背景技术

特征点跟踪是在诸如运动恢复结构(SFM)和全景处理(例如,如用于虚拟现实实现)的许多视频处理和图形领域中使用的技术。任何实现的第一步是相机校准,其使用特征点跟踪来确定相机的外在参数,这是复杂的问题。

要求特征点跟踪和匹配技术来从每个图像或视频流帧中检测特征点。然后,在图像对之间匹配特征点。对于每对图像,可使用近似最近邻方法来在这对图像之间匹配关键点描述符。

附图说明

从结合以下附图的以下详细描述中能够获得本发明的更好理解,附图中:

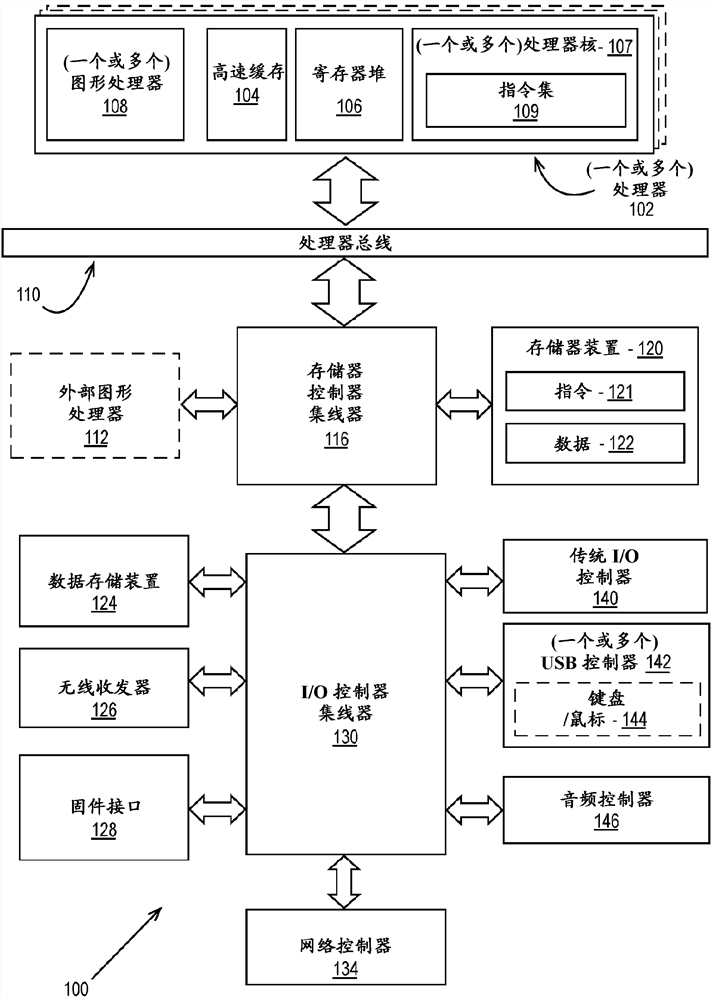

图1是带有处理器的计算机系统的实施例的框图,所述处理器具有一个或多个处理器核和图形处理器;

图2是处理器的一个实施例的框图,所述处理器具有一个或多个处理器核、集成存储器控制器和集成图形处理器;

图3是图形处理器的一个实施例的框图,所述图形处理器可以是分立的图形处理单元,或者可以是与多个处理核集成的图形处理器;

图4是用于图形处理器的图形处理引擎的实施例的框图;

图5是图形处理器的另一实施例的框图。

图6是包括处理元件的阵列的线程执行逻辑的框图;

图7示出了根据实施例的图形处理器执行单元指令格式;

图8是图形处理器的另一实施例的框图,所述图形处理器包括图形流水线、媒体流水线、显示引擎、线程执行逻辑和渲染输出流水线;

图9A是示出根据实施例的图形处理器命令格式的框图;

图9B是示出根据实施例的图形处理器命令序列的框图;

图10示出了根据实施例的用于数据处理系统的示例性图形软件架构;

图11示出了根据实施例的可以被用来制造集成电路以执行操作的示例性IP核开发系统;

图12示出了根据实施例的可以使用一个或多个IP核来制作的示例性片上系统集成电路;

图13示出了可以使用一个或多个IP核来制作的片上系统集成电路的示例性图形处理器;

图14示出了可以使用一个或多个IP核来制作的片上系统集成电路的另外的示例性图形处理器;

图15是示出配置成实现本文中描述的实施例的一个或多个方面的计算机系统的框图;

图16A-16D示出根据实施例的并行处理器组件;

图17A-17B是根据实施例的图形多处理器的框图;

图18A-18F示出了示例性架构,其中多个GPU在通信上耦合到多个多核处理器;

图19示出了根据实施例的图形处理流水线;

图20示出了关键点映射技术;

图21示出了与视频流的帧间块(inter-block)相关联的运动向量;

图22示出了基于运动向量从第一帧映射到第二帧的帧间块;

图23示出了用于使用帧间块的运动向量来映射关键点的架构的一个实施例;

图24示出了用于使用帧间块的运动向量来映射关键点的方法的一个实施例;以及

图25示出了用于示出当前帧和参考帧之间的匹配的点对的示例。

具体实施方式

在以下描述中,出于解释的目的,阐述众多具体细节以便提供对下面描述的本发明的实施例的透彻理解。然而,本领域的技术人员将明白,可以在没有这些具体细节中的一些具体细节的情况下实践本发明的实施例。在其他实例中,以框图形式示出公知的结构和装置,以避免混淆本发明的实施例的根本原理。

示例性图形处理器架构和数据类型

图1是根据实施例的处理系统100的框图。在各种实施例中,系统100包括一个或多个处理器102和一个或多个图形处理器108,并且可以是单处理器桌面系统、多处理器工作站系统、或具有大量处理器102或处理器核107的服务器系统。在一个实施例中,系统100是并入在供移动式、手持式或嵌入式装置中使用的片上系统(SoC)集成电路内的处理平台。

系统100的实施例可包括以下各项或并入在以下各项内:基于服务器的游戏平台、游戏控制台,包括游戏和媒体控制台、移动游戏控制台、手持式游戏控制台或在线游戏控制台。在一些实施例中,系统100是移动电话、智能电话、平板计算装置或移动互联网装置。数据处理系统100还可包括可穿戴装置,与可穿戴装置耦合或集成在可穿戴装置内,所述可穿戴装置诸如智能手表可穿戴装置、智能眼镜装置、增强现实装置或虚拟现实装置。在一些实施例中,数据处理系统100是具有一个或多个处理器102和由一个或多个图形处理器108生成的图形界面的电视或机顶盒装置。

在一些实施例中,一个或多个处理器102各自包括用于处理指令的一个或多个处理器核107,所述指令在被执行时执行系统和用户软件的操作。在一些实施例中,一个或多个处理器核107中的每个处理器核配置成处理特定指令集109。在一些实施例中,指令集109可促进复杂指令集计算(CISC)、精简指令集计算(RISC)、或经由超长指令字(VLIW)的计算。多个处理器核107可各自处理不同指令集109,其可包括用于促进其他指令集的仿真的指令。处理器核107还可包括诸如数字信号处理器(DSP)的其他处理装置。

在一些实施例中,处理器102包括高速缓冲存储器104。取决于架构,处理器102可具有单个内部高速缓存或多个等级的内部高速缓存。在一些实施例中,在处理器102的各个组件之间共享高速缓冲存储器。在一些实施例中,处理器102还使用外部高速缓存(例如,3级(L3)高速缓存或末级高速缓存(LLC))(未示出),其可使用已知的高速缓存一致性技术在处理器核107之间共享。处理器102中另外包括寄存器堆106,所述寄存器堆106可包括用于存储不同类型的数据的不同类型的寄存器(例如,整数寄存器、浮点寄存器、状态寄存器和指令指针寄存器)。一些寄存器可以是通用寄存器,而其他寄存器可特定于处理器102的设计。

在一些实施例中,处理器102与处理器总线110耦合,以在处理器102和系统100中的其他组件之间传送诸如地址、数据或控制信号的通信信号。在一个实施例中,系统100使用示例性“集线器”系统架构,其包括存储器控制器集线器116和输入输出(I/O)控制器集线器130。存储器控制器集线器116促进在存储器装置和系统100的其他组件之间通信,而I/O控制器集线器(ICH)130提供经由本地I/O总线到I/O装置的连接。在一个实施例中,存储器控制器集线器116的逻辑集成在处理器内。

存储器装置120可以是动态随机存取存储器(DRAM)装置、静态随机存取存储器(SRAM)装置、闪速存储器装置、相变存储器装置或具有适合于充当进程存储器的性能的某种其他存储器装置。在一个实施例中,存储器装置120可作为系统100的系统存储器进行操作,以存储数据122和指令121以供在一个或多个处理器102执行应用或进程时使用。存储器控制器集线器116还与可选的外部图形处理器112耦合,所述可选的外部图形处理器112可与处理器102中的一个或多个图形处理器108通信以执行图形和媒体操作。

在一些实施例中,ICH 130使得外围设备能够经由高速I/O总线连接到存储器装置120和处理器102。I/O外围设备包括但不限于音频控制器146、固件接口128、无线收发器126(例如,Wi-Fi、蓝牙)、数据存储装置124(例如,硬盘驱动器、闪速存储器等)和用于将传统(例如,个人系统2(PS/2))装置耦合到系统的传统I/O控制器140。一个或多个通用串行总线(USB)控制器142连接输入装置,诸如键盘和鼠标144组合。网络控制器134也可与ICH 130耦合。在一些实施例中,高性能网络控制器(未示出)与处理器总线110耦合。将意识到,示出的系统100是示例性而非限制性的,因为也可使用不同配置的其他类型的数据处理系统。例如,I/O控制器集线器130可集成在所述一个或多个处理器102内,或者存储器控制器集线器116和I/O控制器集线器130可集成到分立的外部图形处理器(诸如外部图形处理器112)中。

图2是具有一个或多个处理器核202A-202N、集成存储器控制器214和集成图形处理器208的处理器200的实施例的框图。与本文中任何其他附图的元件具有相同参考标号(或名称)的图2的元件能够以与本文中其他地方所描述的方式类似的任何方式操作或起作用,但不限于这样。处理器200能够包括另外的核,所述另外的核多达并且包括由虚线框表示的另外的核202N。处理器核202A-202N中的每个处理器核包括一个或多个内部高速缓存单元204A-204N。在一些实施例中,每个处理器核还可以访问一个或多个共享高速缓存单元206。

内部高速缓存单元204A-204N和共享高速缓存单元206表示处理器200内的高速缓冲存储器层级。高速缓冲存储器层级可以包括在每个处理器核内的至少一级的指令和数据高速缓存,以及一级或多级的共享中间级高速缓存,诸如2级(L2)、3级(L3)、4级(L4)或其他级的高速缓存,其中在外部存储器前的最高级的高速缓存被分类为LLC。在一些实施例中,高速缓存一致性逻辑维持各种高速缓存单元206与204A-204N之间的一致性。

在一些实施例中,处理器200还可以包括一组一个或多个总线控制器单元216和系统代理核210。一个或多个总线控制器单元216管理一组外围总线,诸如一个或多个外围组件互连总线(例如,PCI、PCI Express)。系统代理核210提供用于各种处理器组件的管理功能性。在一些实施例中,系统代理核210包括一个或多个集成存储器控制器214以管理对各种外部存储器装置(未示出)的访问。

在一些实施例中,处理器核202A-202N中的一个或多个处理器核包括对同时多线程的支持。在此类实施例中,系统代理核210包括用于在多线程的处理期间协调和操作核202A-202N的组件。系统代理核210可以另外包括功率控制单元(PCU),所述功率控制单元(PCU)包括用来调节处理器核202A-202N和图形处理器208的功率状态的逻辑和组件。

在一些实施例中,处理器200另外包括用来执行图形处理操作的图形处理器208。在一些实施例中,图形处理器208与一组共享高速缓存单元206和包括一个或多个集成存储器控制器214的系统代理核210耦合。在一些实施例中,显示控制器211与图形处理器208耦合以将图形处理器输出驱动到一个或多个耦合的显示器。在一些实施例中,显示控制器211可以是经由至少一个互连与图形处理器耦合的单独模块,或者可以被集成在图形处理器208或系统代理核210内。

在一些实施例中,基于环的互连单元212被用来耦合处理器200的内部组件。然而,可以使用备选互连单元,诸如点对点互连、交换互连或其他技术,包括本领域中公知的技术。在一些实施例中,图形处理器208经由I/O链路213与环形互连212耦合。

示例性I/O链路213表示多个种类的I/O互连中的至少一个,包括促进在各种处理器组件与诸如eDRAM模块的高性能嵌入式存储器模块218之间的通信的封装上I/O互连。在一些实施例中,处理器核202A-202N中的每个处理器核和图形处理器208使用嵌入式存储器模块218作为共享末级高速缓存。

在一些实施例中,处理器核202A-202N是执行相同指令集架构的同质核。在另一实施例中,处理器核202A-202N在指令集架构(ISA)方面是异质的,其中处理器核202A-202N中的一个或多个处理器核执行第一指令集,而其他核中的至少一个核执行第一指令集的子集或不同指令集。在一个实施例中,处理器核202A-202N在微架构方面是异质的,其中具有相对较高功耗的一个或多个核与具有较低功耗的一个或多个功率核耦合。另外,处理器200能够在一个或多个芯片上被实现,或者被实现为除其他组件外还具有图示的组件的SoC集成电路。

图3是图形处理器300的框图,该图形处理器300可以是分立的图形处理单元,或者可以是与多个处理核集成的图形处理器。在一些实施例中,图形处理器经由到图形处理器上的寄存器的存储器映射I/O接口并且利用放置在处理器存储器中的命令进行通信。在一些实施例中,图形处理器300包括用来访问存储器的存储器接口314。存储器接口314能够是到本地存储器、一个或多个内部高速缓存、一个或多个共享外部高速缓存和/或到系统存储器的接口。

在一些实施例中,图形处理器300还包括用来将显示输出数据驱动到显示装置320的显示控制器302。显示控制器302包括用于一个或多个覆盖平面的硬件,以用于显示和组合多个层的视频或用户接口元件。在一些实施例中,图形处理器300包括视频编解码器引擎306以将媒体编码成一种或多种媒体编码格式、从一种或多种媒体编码格式解码媒体或在一种或多种媒体编码格式之间将媒体转码,所述媒体编码格式包括但不限于运动图像专家组(MPEG)格式(诸如MPEG-2)、高级视频编码(AVC)格式(诸如H.264/MPEG-4 AVC)以及电影与电视工程师协会(SMPTE)421M/VC-1和联合图像专家组(JPEG)格式(诸如JPEG和运动JPEG(MJPEG)格式)。

在一些实施例中,图形处理器300包括用来执行二维(2D)光栅化器操作(包括例如位边界块传输)的块图像传输(BLIT)引擎304。然而,在一个实施例中,使用图形处理引擎(GPE)310的一个或多个组件来执行2D图形操作。在一些实施例中,GPE 310是用于执行包括三维(3D)图形操作和媒体操作的图形操作的计算引擎。

在一些实施例中,GPE 310包括用于执行3D操作的3D流水线312,所述3D操作诸如使用作用于3D图元形状(例如,矩形、三角形等)的处理功能来渲染三维图像和场景。3D流水线312包括可编程和固定功能元件,所述可编程和固定功能元件在元件内执行各种任务和/或将执行线程派生(spawn)到3D/媒体子系统315。虽然3D流水线312能够被用来执行媒体操作,但GPE 310的实施例还包括特别用来执行媒体操作(诸如视频后处理和图像增强)的媒体流水线316。

在一些实施例中,媒体流水线316包括固定功能或可编程逻辑单元以代替或者代表视频编解码器引擎306来执行一个或多个专用媒体操作,诸如视频解码加速、视频去交织和视频编码加速。在一些实施例中,媒体流水线316另外包括线程派生单元以派生用于在3D/媒体子系统315上执行的线程。派生的线程在3D/媒体子系统315中包括的一个或多个图形执行单元上执行用于媒体操作的计算。

在一些实施例中,3D/媒体子系统315包括用于执行由3D流水线312和媒体流水线316派生的线程的逻辑。在一个实施例中,流水线将线程执行请求发送到3D/媒体子系统315,所述3D/媒体子系统315包括线程分派逻辑,以用于将各种请求仲裁(arbitrate)并分派到可用线程执行资源。执行资源包括用来处理3D和媒体线程的图形执行单元的阵列。在一些实施例中,3D/媒体子系统315包括用于线程指令和数据的一个或多个内部高速缓存。在一些实施例中,子系统还包括共享存储器,所述共享存储器包括寄存器和可寻址存储器,以在线程之间共享数据和存储输出数据。

图4是根据一些实施例的图形处理器的图形处理引擎410的框图。在一个实施例中,图形处理引擎(GPE)410是图3中示出的GPE 310的某一版本。与本文中任何其他附图的元件具有相同参考标号(或名称)的图4的元件能够以与本文中其他地方所描述的方式类似的任何方式操作或起作用,但不限于这样。例如,示出了图3的3D流水线312和媒体流水线316。媒体流水线316在GPE 410的一些实施例中是可选的,并且可以未被显式地包括在GPE410内。例如,并且在至少一个实施例中,单独的媒体和/或图像处理器被耦合到GPE 410。

在一些实施例中,GPE 410与提供命令流到3D流水线312和/或媒体流水线316的命令流转化器403耦合,或者包括该命令流转化器403。在一些实施例中,命令流转化器403与存储器耦合,所述存储器能够是系统存储器,或内部高速缓冲存储器和共享高速缓冲存储器中的一个或多个。在一些实施例中,命令流转化器403接收来自存储器的命令,并且将命令发送到3D流水线312和/或媒体流水线316。命令是从环形缓冲器获取的指示,所述环形缓冲器存储用于3D流水线312和媒体流水线316的命令。在一个实施例中,环形缓冲器能够另外包括存储批量的多个命令的批量命令缓冲器。用于3D流水线312的命令还能够包括对在存储器中存储的数据的引用,所述数据诸如但不限于用于3D流水线312的顶点和几何数据和/或用于媒体流水线316的图像数据和存储器对象。3D流水线312和媒体流水线316通过经由相应流水线内的逻辑执行操作或者通过将一个或多个执行线程分派到图形核阵列414来处理命令和数据。

在各种实施例中,3D流水线312能够通过将指令和分派执行线程处理到图形核阵列414来执行一个或多个着色器程序,诸如顶点着色器、几何着色器、像素着色器、片段着色器、计算着色器或其他着色器程序。图形核阵列414提供执行资源的统一块。图形核阵列414内的多用途执行逻辑(例如,执行单元)包括对各种3D API着色器语言的支持,并且能够执行与多个着色器关联的多个同时执行线程。

在一些实施例中,图形核阵列414还包括用来执行媒体功能(诸如视频和/或图像处理)的执行逻辑。在一个实施例中,执行单元另外包括通用逻辑,该通用逻辑可编程以除图形处理操作外还执行并行通用计算操作。该通用逻辑能够与在图1的(一个或多个)处理器核107或如在图2中的核202A-202N内的通用逻辑并行或结合地执行处理操作。

由在图形核阵列414上执行的线程生成的输出数据能够将数据输出到统一返回缓冲器(URB)418中的存储器。URB 418能够存储用于多个线程的数据。在一些实施例中,URB418可以被用来在图形核阵列414上执行的不同线程之间发送数据。在一些实施例中,URB418可以另外被用于在图形核阵列上的线程与在共享功能逻辑420内的固定功能逻辑之间的同步。

在一些实施例中,图形核阵列414是可缩放的,使得该阵列包括可变数量的图形核,这些图形核各自基于GPE 410的目标功率和性能水平而具有可变数量的执行单元。在一个实施例中,执行资源是动态可缩放的,使得可以按需要来启用或禁用执行资源。

图形核阵列414与共享功能逻辑420耦合,该共享功能逻辑420包括在图形核阵列中的图形核之间共享的多个资源。在共享功能逻辑420内的共享功能是硬件逻辑单元,所述硬件逻辑单元提供专用补充功能性到图形核阵列414。在各种实施例中,共享功能逻辑420包括但不限于采样器421、数学422和线程间通信(ITC)423逻辑。另外,一些实施例在共享功能逻辑420内实现一个或多个高速缓存425。

在对给定专用功能的需求不足以包含在图形核心阵列414内的情况下,实现共享功能。替代地,该专用功能的单个实例化被实现为共享功能逻辑420中的独立实体,并且在图形核阵列414内的执行资源之间共享。在图形核阵列414之间共享并且被包括在图形核阵列414内的功能的精确集合在实施例之间变化。

图5是图形处理器500的另一个实施例的框图。与本文中任何其他附图的元件具有相同参考标号(或名称)的图5的元件能够以与本文中其他地方所描述的方式类似的任何方式操作或起作用,但不限于这样。

在一些实施例中,图形处理器500包括环形互连502、流水线前端504、媒体引擎537和图形核580A-580N。在一些实施例中,环形互连502将图形处理器耦合到其他处理单元,包括其他图形处理器或一个或多个通用处理器核。在一些实施例中,图形处理器是集成在多核处理系统内的许多处理器之一。

在一些实施例中,图形处理器500经由环形互连502接收成批命令。通过流水线前端504中的命令流转化器503解释传入的命令。在一些实施例中,图形处理器500包括用于借助于(一个或多个)图形核580A-580N执行3D几何处理和媒体处理的可缩放执行逻辑。对于3D几何处理命令,命令流转化器503将命令提供给几何流水线536。对于至少一些媒体处理命令,命令流转化器503将命令提供给视频前端534,所述视频前端534与媒体引擎537耦合。在一些实施例中,媒体引擎537包括用于视频和图像后处理的视频质量引擎(VQE)530以及用于提供硬件加速的媒体数据编码和解码的多格式编码/解码(MFX)引擎533。在一些实施例中,几何流水线536和媒体引擎537各自为由至少一个图形核580A提供的线程执行资源生成执行线程。

在一些实施例中,图形处理器500包括以可缩放的线程执行资源为特征的模块化核580A-580N(有时称为核切片),其各自具有多个子核550A-550N、560A-560N(有时称为核子切片)。在一些实施例中,图形处理器500可具有任意数量的图形核580A至580N。在一些实施例中,图形处理器500包括至少具有第一子核550A和第二子核560A的图形核580A。在其他实施例中,图形处理器是具有单个子核(例如,550A)的低功率处理器。在一些实施例中,图形处理器500包括多个图形核580A-580N,其各自包括第一子核550A-550N的集合和第二子核560A-560N的集合。第一子核550A-550N的集合中的每个子核至少包括执行单元552A-552N和媒体/纹理采样器554A-554N的第一集合。第二子核560A-560N的集合中的每个子核至少包括执行单元562A-562N和采样器564A-564N的第二集合。在一些实施例中,每个子核550A-550N、560A-560N共享共享资源570A-570N的集合。在一些实施例中,共享资源包括共享高速缓冲存储器和像素操作逻辑。图形处理器的各种实施例中还可包括其他共享资源。

图6示出包括在GPE的一些实施例中采用的处理元件的阵列的线程执行逻辑600。与本文中任何其他附图的元件具有相同参考标号(或名称)的图6的元件能够以与本文中其他地方所描述的方式类似的任何方式操作或起作用,但不限于这样。

在一些实施例中,线程执行逻辑600包括着色器处理器602、线程分派器604、指令高速缓存606、包括多个执行单元608A-608N的可缩放执行单元阵列、采样器610、数据高速缓存612和数据端口614。在一个实施例中,可缩放执行单元阵列能够通过基于工作负载的计算要求来启用或禁用一个或多个执行单元(例如,执行单元608A、608B、608C、608D直到608N-1和608N中的任何执行单元)来动态地进行缩放。在一个实施例中,被包括的组件经由链接到组件中的每个组件的互连组构而互连。在一些实施例中,线程执行逻辑600包括通过指令高速缓存606、数据端口614、采样器610和执行单元608A-608N中的一个或多个到存储器(诸如系统存储器或高速缓冲存储器)的一个或多个连接。在一些实施例中,每个执行单元(例如,608A)是独立可编程通用计算单元,其能执行多个同时硬件线程,同时为每个线程并行处理多个数据元素。在各种实施例中,执行单元608A-608N的阵列是可缩放的,以包括任何数量的各个执行单元。

在一些实施例中,执行单元608A-608N主要被用来执行着色器程序。着色器处理器602能够处理各种着色器程序,并且经由线程分派器604分派与着色器程序关联的执行线程。在一个实施例中,线程分派器包括用来对来自图形和媒体流水线的线程发起请求进行仲裁并且在执行单元608A-608N中的一个或多个执行单元上实例化所请求的线程的逻辑。例如,几何流水线(例如,图5的536)能够分派顶点、曲面细分(tessellation)或几何着色器到线程执行逻辑600(图6)以用于处理。在一些实施例中,线程分派器604还能够处理来自执行的着色器程序的运行时线程派生请求。

在一些实施例中,执行单元608A-608N支持指令集,所述指令集包括对许多标准3D图形着色器指令的本机支持,使得来自图形库(例如Direct 3D和OpenGL)的着色器程序以最小的转换来执行。执行单元支持顶点和几何处理(例如顶点程序、几何程序、顶点着色器)、像素处理(例如像素着色器、片段着色器)和通用处理(例如计算和媒体着色器)。执行单元608A-608N中的每个执行单元能进行多发布单指令多数据(SIMD)执行,并且多线程操作在面临更高时延存储器访问时实现高效的执行环境。每个执行单元内的每个硬件线程具有专用高带宽寄存器堆和关联的独立线程状态。执行是对能够进行整数、单精度和双精度浮点运算、SIMD分支能力、逻辑运算、超越运算和其他杂项运算的流水线的每时钟多发布。在等待来自存储器或共享功能之一的数据时,执行单元608A-608N内的依赖性逻辑使等待的线程休眠,直到所请求的数据已返回为止。当等待的线程正在休眠时,硬件资源可以专用于处理其他线程。例如,在与顶点着色器操作关联的延迟期间,执行单元能够执行用于像素着色器、片段着色器或另一类型的着色器程序(包括不同顶点着色器)的操作。

执行单元608A-608N中的每个执行单元对数据元素的阵列进行操作。数据元素的数量是“执行大小”或用于指令的通道的数量。执行通道是用于指令内的数据元素访问、屏蔽和流控制的执行的逻辑单元。通道的数量可以独立于用于特定图形处理器的物理算术逻辑单元(ALU)或浮点单元(FPU)的数量。在一些实施例中,执行单元608A-608N支持整数和浮点数据类型。

执行单元指令集包括SIMD指令。各种数据元素能够作为打包数据类型存储在寄存器中,并且执行单元将基于元素的数据大小来处理各种元素。例如,在对256位宽向量进行操作时,向量的256位被存储在寄存器中,并且执行单元对作为四个单独的64位打包数据元素(四字(QW)大小数据元素)、八个单独的32位打包数据元素(双字(DW)大小数据元素)、十六个单独的16位打包数据元素(字(W)大小数据元素)或三十二个单独的8位数据元素(字节(B)大小数据元素)的向量进行操作。然而,不同向量宽度和寄存器大小是可能的。

线程执行逻辑600中包括一个或多个内部指令高速缓存(例如,606)以对用于执行单元的线程指令进行高速缓存。在一些实施例中,包括一个或多个数据高速缓存(例如,612)以在线程执行期间对线程数据进行高速缓存。在一些实施例中,包括采样器610以提供用于3D操作的纹理采样和用于媒体操作的媒体采样。在一些实施例中,采样器610包括专用纹理或媒体采样功能性,以在向执行单元提供采样的数据前在采样进程期间处理纹理或媒体数据。

在执行期间,图形和媒体流水线经由线程派生和分派逻辑向线程执行逻辑600发送线程发起请求。一旦几何对象的群组已被处理并且光栅化成像素数据,着色器处理器602内的像素处理器逻辑(例如,像素着色器逻辑、片段着色器逻辑等)便被调用来进一步计算输出信息,并且使结果被写入到输出表面(例如颜色缓冲器、深度缓冲器、模板缓冲器等)。在一些实施例中,像素着色器或片段着色器计算要跨光栅化对象内插的各种顶点属性的值。在一些实施例中,着色器处理器602内的像素处理器逻辑然后执行应用编程接口(API)供应的像素或片段着色器程序。为执行着色器程序,着色器处理器602经由线程分派器604向执行单元(例如,608A)分派线程。在一些实施例中,像素着色器602使用采样器610中的纹理采样逻辑来访问存储在存储器中的纹理映射中的纹理数据。对纹理数据和输入几何数据的算术运算计算每个几何片段的像素颜色数据,或者从进一步处理中丢弃一个或多个像素。

在一些实施例中,数据端口614为线程执行逻辑600提供存储器访问机制,以将经处理的数据输出至存储器以用于在图形处理器输出流水线上处理。在一些实施例中,数据端口614包括或者耦合到一个或多个高速缓冲存储器(例如,数据高速缓存612)来对数据进行高速缓存以用于经由数据端口的存储器访问。

图7是示出根据一些实施例的图形处理器指令格式700的框图。在一个或多个实施例中,图形处理器执行单元支持具有采用多种格式的指令的指令集。实线框示出了一般被包括在执行单元指令中的组成部分,而虚线包括可选的或者仅被包括在指令的子集中的组成部分。在一些实施例中,描述和图示的指令格式700是宏指令,因为它们是供应给执行单元的指令,而与一旦指令被处理则由指令解码产生的微操作相反。

在一些实施例中,图形处理器执行单元本机地支持采用128位指令格式710的指令。基于所选择的指令、指令选项和操作数的数量,64位紧凑指令格式730可用于一些指令。本机128位指令格式710提供对所有指令选项的访问,而在64位指令格式730中一些选项和操作被限制。采用64位指令格式730的可用的本机指令随实施例而变化。在一些实施例中,使用索引字段713中的一组索引值来部分地压缩指令。执行单元硬件基于索引值来引用一组压缩表,并且使用压缩表输出来重构采用128位指令格式710的本机指令。

对于每种格式,指令操作码712定义执行单元要执行的操作。执行单元跨每个操作数的多个数据元素并行执行每个指令。例如,响应于相加指令,执行单元跨表示纹理元素或图片元素的每个颜色通道来执行同时相加运算。默认情况下,执行单元跨操作数的所有数据通道来执行每个指令。在一些实施例中,指令控制字段714实现对诸如通道选择(例如,断定(predication))和数据通道次序(例如,搅混(swizzle))之类的某些执行选项的控制。对于采用128位指令格式710的指令,执行大小字段716限制将被并行执行的数据通道的数量。在一些实施例中,执行大小字段716不可用于在64位紧凑指令格式730中使用。

一些执行单元指令具有多达三个操作数,这三个操作数包括两个源操作数、src0720、src1 722和一个目的地718。在一些实施例中,执行单元支持双目的地指令,其中目的地之一是隐含的。数据操纵指令能够具有第三源操作数(例如SRC2 724),其中指令操作码712确定源操作数的数量。指令的最后源操作数能够是利用指令传递的立即(例如,硬编码的)值。

在一些实施例中,128位指令格式710包括访问/地址模式字段726,该访问/地址模式字段726指定例如使用直接寄存器寻址模式还是间接寄存器寻址模式。在使用直接寄存器寻址模式时,由指令中的位来直接提供一个或多个操作数的寄存器地址。

在一些实施例中,128位指令格式710包括访问/地址模式字段726,该访问/地址模式字段726指定指令的地址模式和/或访问模式。在一个实施例中,访问模式被用来定义指令的数据访问对齐。一些实施例支持包括16字节对齐的访问模式和1字节对齐的访问模式的访问模式,其中访问模式的字节对齐确定指令操作数的访问对齐。例如,当处于第一模式中时,指令可将字节对齐的寻址用于源操作数和目的地操作数,并且当处于第二模式中时,指令可将16字节对齐的寻址用于所有源操作数和目的地操作数。

在一个实施例中,访问/地址模式字段726的地址模式部分确定指令将使用直接寻址还是间接寻址。在使用直接寄存器寻址模式时,指令中的位直接提供一个或多个操作数的寄存器地址。在使用间接寄存器寻址模式时,可以基于指令中的地址寄存器值和地址立即字段来计算一个或多个操作数的寄存器地址。

在一些实施例中,基于操作码712位字段对指令进行分组,以简化操作码解码740。对于8位操作码,4、5和6位允许执行单元确定操作码的类型。所示出的精确操作码分组仅是示例。在一些实施例中,移动和逻辑操作码群组742包括数据移动和逻辑指令(例如,移动(mov)、比较(cmp))。在一些实施例中,移动和逻辑群组742共享五个最高有效位(MSB),其中移动(mov)指令采用0000xxxxb的形式,并且逻辑指令采用0001xxxxb的形式。流控制指令群组744(例如调用、跳(jmp))包括采用0010xxxxb(例如,0x20)形式的指令。杂项指令群组746包括指令的混合,包括采用0011xxxxb(例如0x30)形式的同步指令(例如等待、发送)。并行数学指令群组748包括采用0100xxxxb(例如0x40)形式的逐组成部分的算术指令(例如,加、乘(mul))。并行数学群组748跨数据通道并行执行算术运算。向量数学群组750包括采用0101xxxxb(例如,0x50)形式的算术指令(例如,dp4)。向量数学群组对向量操作数执行诸如点积计算的算术。

图8是图形处理器800的另一实施例的框图。与本文中任何其他附图的元件具有相同参考标号(或名称)的图8的元件能够以与本文中其他地方所描述的方式类似的任何方式操作或起作用,但不限于这样。

在一些实施例中,图形处理器800包括几何流水线820、媒体流水线830、显示引擎840、线程执行逻辑850和渲染输出流水线870。在一些实施例中,图形处理器800是包括一个或多个通用处理核的多核处理系统内的图形处理器。通过对一个或多个控制寄存器(未示出)的寄存器写入或者经由经过环形互连802发布至图形处理器800的命令来控制图形处理器。在一些实施例中,环形互连802将图形处理器800耦合到其他处理组件,诸如其他图形处理器或通用处理器。来自环形互连802的命令由命令流转化器803解译,该命令流转化器803将指令供应至图形流水线820或媒体流水线830的各个组件。

在一些实施例中,命令流转化器803指导顶点获取器805的操作,该顶点获取器805从存储器读取顶点数据并执行由命令流转化器803提供的顶点处理命令。在一些实施例中,顶点获取器805将顶点数据提供给顶点着色器807,该顶点着色器807对每个顶点执行坐标空间变换和照明操作。在一些实施例中,顶点获取器805和顶点着色器807通过经由线程分派器831向执行单元852A-852B分派执行线程来执行顶点处理指令。

在一些实施例中,执行单元852A-852B是具有用于执行图形和媒体操作的指令集的向量处理器的阵列。在一些实施例中,执行单元852A-852B具有附接的L1高速缓存851,所述L1高速缓存851特定于每个阵列,或者在阵列之间共享。高速缓存能够被配置为数据高速缓存、指令高速缓存或被分区以在不同分区中含有数据和指令的单个高速缓存。

在一些实施例中,图形流水线820包括曲面细分组件以执行3D对象的硬件加速的曲面细分。在一些实施例中,可编程外壳着色器(programmable hull shader)811配置曲面细分操作。可编程域着色器817提供曲面细分输出的后端评估。曲面细分器813在外壳着色器811的指导下进行操作,并且含有专用逻辑以基于作为到图形流水线820的输入而提供的粗略几何模型来生成一组详细的几何对象。在一些实施例中,如果未使用曲面细分,则能够绕过曲面细分组件(例如,外壳着色器811、曲面细分器813和域着色器817)。

在一些实施例中,完整几何对象能够由几何着色器819经由分派给执行单元852A-852B的一个或多个线程来处理,或者能够直接行进至裁剪器(clipper)829。在一些实施例中,几何着色器对整个几何对象进行操作,而不是如在图形流水线的先前阶段中那样对顶点或顶点的补片(patch)进行操作。如果曲面细分被禁用,则几何着色器819接收来自顶点着色器807的输入。在一些实施例中,几何着色器819可由几何着色器程序编程以在曲面细分单元被禁用时执行几何曲面细分。

在光栅化前,裁剪器829处理顶点数据。裁剪器829可以是具有裁剪和几何着色器功能的可编程裁剪器或固定功能裁剪器。在一些实施例中,渲染输出流水线870中的光栅化器和深度测试组件873分派像素着色器以将几何对象转换成它们的每像素表示。在一些实施例中,像素着色器逻辑被包括在线程执行逻辑850中。在一些实施例中,应用能够绕过光栅化器和深度测试组件873,并且经由流输出单元823访问未光栅化的顶点数据。

图形处理器800具有允许数据和消息在处理器的主要组件之间传递的互连总线、互连组构或某种其他互连机构。在一些实施例中,执行单元852A-852B和关联的(一个或多个)高速缓存851、纹理和媒体采样器854以及纹理/采样器高速缓存858经由数据端口856互连,以执行存储器访问并且与处理器的渲染输出流水线组件进行通信。在一些实施例中,采样器854、高速缓存851、858和执行单元852A-852B各自具有单独的存储器访问路径。

在一些实施例中,渲染输出流水线870含有光栅化器和深度测试组件873,其将基于顶点的对象转换成关联的基于像素的表示。在一些实施例中,光栅化器逻辑包括用来执行固定功能三角形和线光栅化的窗口化器(windower)/掩蔽器单元。关联的渲染高速缓存878和深度高速缓存879在一些实施例中也是可用的。像素操作组件877对数据执行基于像素的操作,尽管在一些实例中,与2D操作关联的像素操作(例如,带有混合(blending)的位块图像传输)由2D引擎841执行,或者在显示时由显示控制器843使用覆盖显示平面代替。在一些实施例中,共享L3高速缓存875对于全部图形组件是可用的,从而允许在不使用主系统存储器的情况下共享数据。

在一些实施例中,图形处理器媒体流水线830包括媒体引擎837和视频前端834。在一些实施例中,视频前端834接收来自命令流转化器803的流水线命令。在一些实施例中,媒体流水线830包括单独的命令流转化器。在一些实施例中,视频前端834在将命令发送至媒体引擎837之前处理媒体命令。在一些实施例中,媒体引擎837包括线程派生功能性来派生线程,以便经由线程分派器831分派到线程执行逻辑850。

在一些实施例中,图形处理器800包括显示引擎840。在一些实施例中,显示引擎840在处理器800的外部,并且经由环形互连802或某一其他互连总线或组构与图形处理器耦合。在一些实施例中,显示引擎840包括2D引擎841和显示控制器843。在一些实施例中,显示引擎840含有能独立于3D流水线操作的专用逻辑。在一些实施例中,显示控制器843与显示装置(未示出)耦合,该显示装置可以是系统集成的显示装置(如在膝上型计算机中),或者可以是经由显示装置连接器附接的外部显示装置。

在一些实施例中,图形流水线820和媒体流水线830可配置成基于多个图形和媒体编程接口来执行操作,并且不特定于任何一个应用编程接口(API)。在一些实施例中,用于图形处理器的驱动器软件将特定于特定图形或媒体库的API调用转换成能够由图形处理器处理的命令。在一些实施例中,为全部来自Khronos Group的开放图形库(OpenGL)、开放计算语言(OpenCL)和/或Vulkan图形和计算API提供支持。在一些实施例中,还可以为来自微软公司的Direct3D库提供支持。在一些实施例中,可支持这些库的组合。还可以为开源计算机视觉库(OpenCV)提供支持。如果能够进行从未来API的流水线到图形处理器的流水线的映射,则具有可兼容3D流水线的未来API也将被支持。

图9A是示出根据一些实施例的图形处理器命令格式900的框图。图9B是示出根据实施例的图形处理器命令序列910的框图。图9A中的实线框示出了一般被包括在图形命令中的组成部分,而虚线包括可选的或者仅被包括在图形命令的子集中的组成部分。图9A的示例性图形处理器命令格式900包括用来标识命令的目标客户端902、命令操作代码(操作码)904和命令的相关数据906的数据字段。一些命令中还包括子操作码905和命令大小908。

在一些实施例中,客户端902指定处理命令数据的图形装置的客户端单元。在一些实施例中,图形处理器命令解析器检查每个命令的客户端字段以调节命令的进一步处理,并且将命令数据路由到适当的客户端单元。在一些实施例中,图形处理器客户端单元包括存储器接口单元、渲染单元、2D单元、3D单元和媒体单元。每个客户端单元具有处理命令的对应处理流水线。一旦客户端单元接收到命令,客户端单元便读取操作码904和子操作码905(如果子操作码905存在的话),以确定要执行的操作。客户端单元使用数据字段906中的信息来执行命令。对于一些命令,预期显式命令大小908来指定命令的大小。在一些实施例中,命令解析器基于命令操作码来自动确定命令中的至少一些命令的大小。在一些实施例中,经由双字的倍数来对齐命令。

图9B中的流程图示出了示例性图形处理器命令序列910。在一些实施例中,以图形处理器的实施例为特征的数据处理系统的软件或固件使用所示出的命令序列的版本来设置、执行和终止一组图形操作。仅出于示例的目的示出并描述了样本命令序列,因为实施例不限于这些特定命令或此命令序列。另外,命令可作为命令序列中的批量的命令被发布,使得图形处理器将至少部分并发地处理命令的序列。

在一些实施例中,图形处理器命令序列910可以以流水线转储清除命令(pipelineflush command)912开始,以促使任何活动的图形流水线完成该流水线的当前未决命令。在一些实施例中,3D流水线922和媒体流水线924没有并发地操作。执行流水线转储清除以促使活动的图形流水线完成任何未决命令。响应于流水线转储清除,用于图形处理器的命令解析器将暂停命令处理,直至活动的绘图引擎完成未决操作并且相关的读取高速缓存失效。可选地,能够将渲染高速缓存中标记为“脏”的任何数据转储清除到存储器。在一些实施例中,流水线转储清除命令912能够被用于流水线同步,或者在将图形处理器置于低功率状态前被使用。

在一些实施例中,在命令序列要求图形处理器在流水线之间显式地切换时,使用流水线选择命令913。在一些实施例中,除非上下文将为两个流水线发布命令,否则在发布流水线命令前,在执行上下文内仅要求一次流水线选择命令913。在一些实施例中,紧接在经由流水线选择命令913的流水线切换之前,要求流水线转储清除命令912。

在一些实施例中,流水线控制命令914配置图形流水线以用于操作,并且被用来对3D流水线922和媒体流水线924进行编程。在一些实施例中,流水线控制命令914为活动的流水线配置流水线状态。在一个实施例中,流水线控制命令914被用于流水线同步,并且在处理一批命令前从活动的流水线内的一个或多个高速缓冲存储器中清除数据。

在一些实施例中,用于返回缓冲器状态916的命令被用来为相应流水线配置一组返回缓冲器以写入数据。一些流水线操作要求分配、选择或配置一个或多个返回缓冲器,在处理期间这些操作将中间数据写入到所述一个或多个返回缓冲器中。在一些实施例中,图形处理器还使用一个或多个返回缓冲器来存储输出数据并且执行跨线程通信。在一些实施例中,配置返回缓冲器状态916包括选择要用于一组流水线操作的返回缓冲器的大小和数量。

命令序列中的剩余命令基于用于操作的活动流水线而不同。基于流水线确定920,将命令序列定制到以3D流水线状态930开始的3D流水线922或者在媒体流水线状态940开始的媒体流水线924。

用来配置3D流水线状态930的命令包括3D状态设置命令,其用于在处理3D图元命令之前要配置的顶点缓冲器状态、顶点元素状态、恒定颜色状态、深度缓冲器状态以及其他状态变量。至少部分基于使用中的特定3D API来确定这些命令的值。在一些实施例中,如果将不使用某些流水线元件,则3D流水线状态930命令还能够选择性地禁用或绕过那些元件。

在一些实施例中,3D图元932命令被用来提交要由3D流水线处理的3D图元。经由3D图元932命令传递到图形处理器的命令和关联参数被转发到图形流水线中的顶点获取功能。顶点获取功能使用3D图元932命令数据来生成顶点数据结构。顶点数据结构被存储在一个或多个返回缓冲器中。在一些实施例中,3D图元932命令被用来经由顶点着色器对3D图元执行顶点操作。为处理顶点着色器,3D流水线922将着色器执行线程分派到图形处理器执行单元。

在一些实施例中,经由执行934命令或事件来触发3D流水线922。在一些实施例中,寄存器写入触发命令执行。在一些实施例中,经由命令序列中的“go”或“kick”命令来触发执行。在一个实施例中,使用用来转储清除通过图形流水线的命令序列的流水线同步命令来触发命令执行。3D流水线将执行用于3D图元的几何处理。一旦操作完成,所得到的几何对象便被光栅化,并且像素引擎对所得到的像素进行上色。对于那些操作,还可以包括用来控制像素着色和像素后端操作的附加的命令。

在一些实施例中,在执行媒体操作时,图形处理器命令序列910沿着媒体流水线924路径。一般而言,用于媒体流水线924的编程的特定使用和方式取决于要执行的媒体或计算操作。可以在媒体解码期间将特定媒体解码操作卸载到媒体流水线。在一些实施例中,还能够绕过媒体流水线,并且能够使用由一个或多个通用处理核提供的资源来全部或部分地执行媒体解码。在一个实施例中,媒体流水线还包括用于通用图形处理器单元(GPGPU)操作的元件,其中图形处理器被用于使用计算着色器程序来执行SIMD向量运算,所述计算着色器程序与图形图元的渲染不是明确相关的。

在一些实施例中,以与3D流水线922类似的方式对媒体流水线924进行配置。将用来配置媒体流水线状态940的一组命令分派或放置到在媒体对象命令942之前的命令队列中。在一些实施例中,用于媒体流水线状态940的命令包括用来配置媒体流水线元件的数据,所述媒体流水线元件将被用来处理媒体对象。这包括用来配置媒体流水线内的视频解码和视频编码逻辑的数据,诸如编码和解码格式。在一些实施例中,用于媒体流水线状态940的命令还支持使用到含有一批状态设置的“间接”状态元素的一个或多个指针。

在一些实施例中,媒体对象命令942将指针供应到媒体对象以便由媒体流水线处理。媒体对象包括存储器缓冲器,所述存储器缓冲器含有要处理的视频数据。在一些实施例中,在发布媒体对象命令942之前,所有媒体流水线状态必须是有效的。一旦配置了流水线状态,并且将媒体对象命令942排队,便经由执行命令944或等效执行事件(例如,寄存器写入)来触发媒体流水线924。然后可以通过由3D流水线922或媒体流水线924提供的操作对来自媒体流水线924的输出进行后处理。在一些实施例中,以与媒体操作类似的方式配置和执行GPGPU操作。

图10示出了根据一些实施例的用于数据处理系统1000的示例性图形软件架构。在一些实施例中,软件架构包括3D图形应用1010、操作系统1020和至少一个处理器1030。在一些实施例中,处理器1030包括图形处理器1032和一个或多个通用处理器核1034。图形应用1010和操作系统1020各自在数据处理系统的系统存储器1050中执行。

在一些实施例中,3D图形应用1010包含一个或多个着色器程序,该一个或多个着色器程序包括着色器指令1012。着色器语言指令可以采用高级着色器语言,诸如高级着色器语言(HLSL)或OpenGL着色器语言(GLSL)。应用还包括采用适合由通用处理器核1034执行的机器语言的可执行指令1014。应用还包括由顶点数据定义的图形对象1016。

在一些实施例中,操作系统1020是来自微软公司的Microsoft® Windows®操作系统、专有的类UNIX操作系统或使用Linux内核的变型的开源类UNIX操作系统。操作系统1020能够支持图形API 1022,诸如Direct3D API、OpenGL API或Vulkan API。当Direct3DAPI在使用中时,操作系统1020使用前端着色器编译器1024来将采用HLSL的任何着色器指令1012编译成更低级着色器语言。编译可以是即时(JIT)编译或者应用能够执行着色器预编译。在一些实施例中,在3D图形应用1010的编译期间将高级着色器编译成低级着色器。在一些实施例中,以中间形式(诸如由Vulkan API使用的标准可移植中间表示(SPIR)的版本)提供着色器指令1012。

在一些实施例中,用户模式图形驱动器1026包含用来将着色器指令1012转换成硬件特定表示的后端着色器编译器1027。当OpenGL API在使用中时,将采用GLSL高级语言的着色器指令1012传递到用户模式图形驱动器1026以用于编译。在一些实施例中,用户模式图形驱动器1026使用操作系统内核模式功能1028来与内核模式图形驱动器1029进行通信。在一些实施例中,内核模式图形驱动器1029与图形处理器1032进行通信以分派命令和指令。

至少一个实施例的一个或多个方面可以由存储在机器可读介质上的代表性代码来实现,该代表性代码表示和/或定义诸如处理器的集成电路内的逻辑。例如,机器可读介质可以包括表示处理器内的各种逻辑的指令。在由机器读取时,指令可以促使机器制作逻辑以执行本文中描述的技术。称为“IP核”的此类表示是用于集成电路的逻辑的可重复使用单元,其可以作为对集成电路的结构进行描述的硬件模型而被存储在有形机器可读介质上。可以将硬件模型供应至各种客户或制造设施,所述客户或制造设施将硬件模型加载在制造集成电路的制作机器上。可制作集成电路,使得电路执行与本文中描述的实施例中的任何实施例关联地描述的操作。

图11是示出根据实施例的可被用来制造集成电路以执行操作的IP核开发系统1100的框图。IP核开发系统1100可以被用来生成能够被并入到更大的设计中或被用来构造整个集成电路(例如,SOC集成电路)的模块化、可重复使用设计。设计设施1130能够生成采用高级编程语言(例如,C/C++)的IP核设计的软件仿真1110。软件仿真1110能够被用于使用仿真模型1112来设计、测试和验证IP核的行为。仿真模型1112可以包括功能、行为和/或时序仿真。然后能够从仿真模型1112创建或合成寄存器传输级(RTL)设计1115。RTL设计1115是对硬件寄存器之间的数字信号流进行建模的集成电路的行为的抽象,包括使用建模的数字信号执行的相关联逻辑。除RTL设计1115外,还可以创建、设计或合成处于逻辑级或晶体管级的较低级设计。因此,初始设计和仿真的特定细节可以不同。

可以由设计设施将RTL设计1115或等效物进一步合成为硬件模型1120,该硬件模型1120可以采用硬件描述语言(HDL)或物理设计数据的某种其他表示。可以进一步对HDL进行仿真或测试以验证IP核设计。能够使用非易失性存储器1140(例如,硬盘、闪速存储器或任何非易失性存储介质)来存储IP核设计以用于递送到第三方制作设施1165。备选地,可以通过有线连接1150或无线连接1160(例如经由因特网)来传送IP核设计。制作设施1165然后可以制作至少部分基于IP核设计的集成电路。制作的集成电路能够被配置成执行根据本文中描述的至少一个实施例的操作。

图12-14示出了根据本文中描述的各种实施例的可以使用一个或多个IP核来制作的示例性集成电路和相关联的图形处理器。除了所示出的内容外,还可以包括其他逻辑和电路,包括附加的图形处理器/核、外围接口控制器或通用处理器核。

图12是示出根据实施例的可以使用一个或多个IP核来制作的示例性片上系统集成电路1200的框图。示例性集成电路1200包括一个或多个应用处理器1205(例如,处理器)、至少一个图形处理器1210,并且可以另外包括图像处理器1215和/或视频处理器1220,以上处理器中的任何处理器可以是来自相同或多个不同设计设施的模块化IP核。集成电路1200包括外围或总线逻辑,所述外围或总线逻辑包括USB控制器1225、UART控制器1230、SPI/SDIO控制器1235和I2S/I2C控制器1240。另外,集成电路能够包括耦合到高清晰度多媒体接口(HDMI)控制器1250和移动工业处理器接口(MIPI)显示接口1255中的一个或多个的显示装置1245。可以通过包括闪速存储器和闪速存储器控制器的闪速存储器子系统1260来提供存储。可以经由存储器控制器1265提供存储器接口以便访问SDRAM或SRAM存储器装置。一些集成电路另外包括嵌入式安全引擎1270。

图13是示出根据实施例的可使用一个或多个IP核制造的片上系统集成电路的示例性图形处理器1310的框图。图形处理器1310可以是图12的图形处理器1210的变型。图形处理器1310包括顶点处理器1305和一个或多个片段处理器1315A-1315N(例如,1315A、1315B、1315C、1315D直到1315N-1和1315N)。图形处理器1310能够经由单独的逻辑执行不同着色器程序,使得顶点处理器1305被优化以执行用于顶点着色器程序的操作,而一个或多个片段处理器1315A-1315N执行用于片段或像素着色器程序的片段(例如,像素)着色操作。顶点处理器1305执行3D图形流水线的顶点处理阶段,并且生成图元和顶点数据。(一个或多个)片段处理器1315A-1315N使用由顶点处理器1305生成的图元和顶点数据来产生在显示装置上显示的帧缓冲器。在一个实施例中,(一个或多个)片段处理器1315A-1315N被优化以执行如在OpenGL API中提供的片段着色器程序,该片段着色器程序可以被用来执行与如在Direct 3D API中提供的像素着色器程序相似的操作。

图形处理器1310另外包括一个或多个存储器管理单元(MMU)1320A-1320B、(一个或多个)高速缓存1325A-1325B和(一个或多个)电路互连1330A-1330B。一个或多个MMU1320A-1320B为图形处理器1310(包括为顶点处理器1305和/或(一个或多个)片段处理器1315A-1315N)提供虚拟地址到物理地址映射,这些处理器除了在一个或多个高速缓存1325A-1325B中存储的顶点或图像/纹理数据之外还可以引用在存储器中存储的顶点或图像/纹理数据。在一个实施例中,一个或多个MMU 1320A-1320B可以与系统内的其他MMU同步,所述其他MMU包括与图12的一个或多个应用处理器1205、图像处理器1215和/或视频处理器1220关联的一个或多个MMU,使得每个处理器1205-1220能够参与到共享或统一虚拟存储器系统中。根据实施例,一个或多个电路互连1330A-1330B使得图形处理器1310能够经由SoC的内部总线或者经由直接连接来与SoC内的其他IP核通过接口交互。

图14是示出根据实施例的可使用一个或多个IP核制造的片上系统集成电路的另外的示例性图形处理器1410的框图。图形处理器1410可以是图12的图形处理器1210的变型。图形处理器1410包括图13的集成电路1300的一个或多个MMU 1320A-1320B、(一个或多个)高速缓存1325A-1325B和(一个或多个)电路互连1330A-1330B。

图形处理器1410包括一个或多个着色器核1415A-1415N(例如,1415A、1415B、1415C、1415D、1415E、1415F至1415N-1和1415N),其提供统一的着色器核架构,其中单个核或类型的核可执行所有类型的可编程着色器代码,包括用于实现顶点着色器、片段着色器和/或计算着色器的着色器程序代码。在实施例和实现中,存在的着色器核的确切数量可改变。另外,图形处理器1410包括:核间任务管理器1405,其充当线程分派器以将执行线程分派给一个或多个着色器核1415A-1415N;以及拼贴单元(tiling unit)1418,其用于加速拼贴操作以用于基于贴片(tile)的渲染,其中用于场景的渲染操作在图像空间中被细分,例如以利用场景内的局部空间相干性或优化内部高速缓存的使用。

示例性图形微架构

在一些实施例中,图形处理单元(GPU)在通信上耦合到主机/处理器核以加速图形操作、机器学习操作、模式分析操作和各种通用GPU(GPGPU)功能。GPU可通过总线或另一互连(例如,高速互连,诸如PCIe或NVLink)在通信上耦合到主机处理器/核。在其他实施例中,GPU可集成在与核相同的封装或芯片上,并且通过内部处理器总线/互连(即,在封装或芯片内部)在通信上耦合到核。不管连接GPU的方式如何,处理器核可以用工作描述符中包含的命令/指令的序列的形式将工作分配给GPU。GPU接着使用专用电路/逻辑以便高效地处理这些命令/指令。

在以下描述中,阐述了许多具体细节以提供更透彻的理解。然而,对于本领域技术人员来说将显而易见的是,可以在没有这些具体细节中的一个或多个的情况下实践本文中描述的实施例。在其他情况下,没有描述公知的特征以避免模糊本实施例的细节。

图15是示出被配置成实现本文中描述的实施例的一个或多个方面的计算系统1500的框图。计算系统1500包括处理子系统1501,其具有一个或多个处理器1502和系统存储器1504,它们经由可以包括存储器集线器1505的互连路径进行通信。存储器集线器1505可以是芯片组组件内的单独组件,或者可以集成在一个或多个处理器1502内。存储器集线器1505经由通信链路1506与I/O子系统1511耦合。I/O子系统1511包括I/O集线器1507,其可使计算系统1500能够从一个或多个输入装置1508接收输入。另外,I/O集线器1507可实现可以被包括在一个或多个处理器1502中的显示控制器,以向一个或多个显示装置1510A提供输出。在一个实施例中,与I/O集线器1507耦合的一个或多个显示装置1510A可包括本地、内部或嵌入式显示装置。

在一个实施例中,处理子系统1501包括经由总线或其他通信链路1513耦合到存储器集线器1505的一个或多个并行处理器1512。通信链路1513可以是任何数量的基于标准的通信链路技术或协议中的一种,诸如但不限于PCI Express,或者可以是供应商特定的通信接口或通信组构。在一个实施例中,一个或多个并行处理器1512形成计算集中的并行或向量处理系统,其包括大量处理核和/或处理集群,诸如集成众核(MIC)处理器。在一个实施例中,一个或多个并行处理器1512形成图形处理子系统,其可将像素输出到经由I/O集线器1507耦合的一个或多个显示装置1510A之一。一个或多个并行处理器1512还可包括显示控制器和显示接口(未示出),以使得能够直接连接到一个或多个显示装置1510B。

在I/O子系统1511内,系统存储单元1514可以连接到I/O集线器1507来为计算系统1500提供存储机制。I/O交换器1516可用于提供接口机制,以实现I/O集线器1507与其他组件之间的连接,所述其他组件诸如可以集成到平台中的网络适配器1518和/或无线网络适配器1519以及可以经由一个或多个插件装置1520添加的各种其他装置。网络适配器1518可以是以太网适配器或另一有线网络适配器。无线网络适配器1519可以包括以下各项中的一个或多个:Wi-Fi、蓝牙、近场通信(NFC)或包括一个或多个无线无线电设备的其他网络装置。

计算系统1500可以包括未明确示出的其他组件(包括USB或其他端口连接、光存储驱动器、视频捕获装置等),其也可以连接到I/O集线器1507。将图15中的各种组件互连的通信路径可以使用任何合适的协议来实现,所述协议诸如基于PCI(外围组件互连)的协议(例如,PCI-Express),或者任何其他总线或点对点通信接口和/或(一个或多个)协议,诸如NV-Link高速互连或者在本领域中已知的互连协议。

在一个实施例中,一个或多个并行处理器1512合并针对图形和视频处理而优化的电路(包括例如视频输出电路),并且构成图形处理单元(GPU)。在另一实施例中,一个或多个并行处理器1512合并针对通用处理而优化的电路,同时保留底层计算架构,如本文中更详细描述的。在又一个实施例中,计算系统1500的组件可以与一个或多个其他系统元件集成在单个集成电路上。例如,一个或多个并行处理器1512、存储器集线器1505、(一个或多个)处理器1502和I/O集线器1507可以集成到片上系统(SoC)集成电路中。备选地,计算系统1500的组件可以集成到单个封装中以形成系统级封装(SIP)配置。在一个实施例中,计算系统1500的组件的至少一部分可以集成到多芯片模块(MCM)中,所述多芯片模块(MCM)可以与其他多芯片模块一起互连到模块化计算系统中。

将意识到,本文中所示的计算系统1500是说明性的,并且变化和修改是可能的。可以根据需要修改连接拓扑(包括桥的数量和布置)、(一个或多个)处理器1502的数量和(一个或多个)并行处理器1512的数量。例如,在一些实施例中,系统存储器1504直接而不是通过桥连接到(一个或多个)处理器1502,而其他装置经由存储器集线器1505和(一个或多个)处理器1502与系统存储器1504通信。在其他备选拓扑中,(一个或多个)并行处理器1512连接到I/O集线器1507,或者直接连接到一个或多个处理器1502之一,而不是连接到存储器集线器1505。在其他实施例中,I/O集线器1507和存储器集线器1505可以集成到单个芯片中。一些实施例可以包括经由多个插槽附接的两组或更多组(一个或多个)处理器1502,所述多个插槽可以与(一个或多个)并行处理器1512的两个或更多个实例耦合。

本文中所示的特定组件中的一些组件是可选的,并且可以不被包括在计算系统1500的所有实现中。例如,可以支持任何数量的插件卡或外围设备,或者可以去除一些组件。此外,一些架构可以使用与图15中所示的那些组件类似的组件的不同术语,例如,在一些架构中存储器集线器1505可以被称为北桥,而I/O集线器1507可以被称为南桥。

图16A示出根据实施例的并行处理器1600。可使用一个或多个集成电路装置来实现并行处理器1600的各种组件,所述一个或多个集成电路装置诸如可编程处理器、专用集成电路(ASIC)或现场可编程门阵列(FPGA)。所示出的并行处理器1600是根据实施例的在图15中所示的一个或多个并行处理器1512的变型。

在一个实施例中,并行处理器1600包括并行处理单元1602。并行处理单元包括I/O单元1604,其使得能够与包括并行处理单元1602的其他实例的其他装置通信。I/O单元1604可以直接连接到其他装置。在一个实施例中,I/O单元1604经由使用集线器或交换机接口(诸如存储器集线器1505)与其他装置连接。存储器集线器1505和I/O单元1604之间的连接形成通信链路1513。在并行处理单元1602内,I/O单元1604与主机接口1606和存储器交叉开关1616连接,其中主机接口1606接收针对执行处理操作的命令,并且存储器交叉开关1616接收针对执行存储器操作的命令。

当主机接口1606经由I/O单元1604接收命令缓冲区时,主机接口1606可以将用于执行那些命令的工作操作引导到前端1608。在一个实施例中,前端1608与调度器1610耦合,所述调度器1610配置成将命令或其他工作项目分发到处理集群阵列1612。在一个实施例中,调度器1610确保处理集群阵列1612被正确配置,并且在任务被分发到处理集群阵列1612的处理集群之前处于有效状态。在一个实施例中,调度器1610经由在微控制器上执行的固件逻辑来实现。微控制器实现的调度器1610可配置成以粗粒度和细粒度执行复杂调度和工作分发操作,从而实现在处理阵列1612上执行的线程的快速抢占和上下文切换。在一个实施例中,主机软件可以经由多个图形处理门铃之一来证明用于在处理阵列1612上调度的工作负载。然后,可以由调度器微控制器内的调度器1610逻辑跨处理阵列1612自动地分发工作负载。

处理集群阵列1612可包括多达“N”个处理集群(例如,集群1614A、集群1614B到集群1614N)。处理集群阵列1612的每个集群1614A-1614N可以执行大量并发线程。调度器1610可以使用各种调度和/或工作分发算法将工作分配给处理集群阵列1612的集群1614A-1614N,所述算法可以根据针对每种类型的程序或计算所产生的工作负荷而变化。调度可以由调度器1610动态地处置,或者可以在配置用于由处理集群阵列1612执行的程序逻辑的编译期间由编译器逻辑部分地辅助。在一个实施例中,处理集群阵列1612的不同集群1614A-1614N可以被分配用于处理不同类型的程序或用于执行不同类型的计算。

处理集群阵列1612可配置成执行各种类型的并行处理操作。在一个实施例中,处理集群阵列1612配置成执行通用并行计算操作。例如,处理集群阵列1612可以包括用于执行处理任务的逻辑,所述处理任务包括视频和/或音频数据的过滤、执行建模操作(包括物理操作)以及执行数据变换。

在一个实施例中,处理集群阵列1612配置成执行并行图形处理操作。在其中并行处理器1600配置成执行图形处理操作的实施例中,处理集群阵列1612可包括用于支持此类图形处理操作的执行的附加逻辑,其包括但不限于用于执行纹理操作的纹理采样逻辑以及曲面细分逻辑和其他顶点处理逻辑。另外,处理集群阵列1612可配置成执行图形处理相关着色器程序,诸如但不限于顶点着色器、曲面细分着色器、几何着色器和像素着色器。并行处理单元1602可经由I/O单元1604从系统存储器传递数据以用于处理。在处理期间,所传递的数据可在处理期间存储到片上存储器(例如,并行处理器存储器1622),接着写回到系统存储器。

在一个实施例中,当并行处理单元1602用于执行图形处理时,调度器1610可配置成将处理工作负载划分成大致相等大小的任务,以更好地实现将图形处理操作分发至处理集群阵列1612的多个集群1614A到1614N。在一些实施例中,处理集群阵列1612的部分可以配置成执行不同类型的处理。例如,第一部分可以配置成执行顶点着色和拓扑生成,第二部分可以配置成执行曲面细分和几何着色,并且第三部分可以配置成执行像素着色或其他屏幕空间操作,以产生用于显示的渲染图像。由集群1614A-1614N中的一个或多个集群产生的中间数据可以存储在缓冲器中,以允许中间数据在集群1614A-1614N之间传送,以用于进一步处理。

在操作期间,处理集群阵列1612可以经由调度器1610接收要执行的处理任务,该调度器1610从前端1608接收定义处理任务的命令。对于图形处理操作,处理任务可包括要处理的数据(例如,表面(补片)数据、图元数据、顶点数据和/或像素数据)的索引,以及定义要如何处理数据(例如,要执行什么程序)的状态参数和命令。调度器1610可以配置成获取对应于任务的索引,或者可以从前端1608接收索引。前端1608可配置成确保在发起由传入命令缓冲器(例如,批缓冲器、推送缓冲器等)指定的工作负载之前处理集群阵列1612被配置成有效状态。

并行处理单元1602的一个或多个实例中的每个实例可以与并行处理器存储器1622耦合。可以经由存储器交叉开关1616访问并行处理器存储器1622,所述存储器交叉开关1616可以从处理集群阵列1612以及I/O单元1604接收存储器请求。存储器交叉开关1616可以经由存储器接口1618访问并行处理器存储器1622。存储器接口1618可包括多个分区单元(例如,分区单元1620A、分区单元1620B到分区单元1620N),它们可各自耦合到并行处理器存储器1622的一部分(例如,存储器单元)。在一个实现中,分区单元1620A-1620N的数量配置成等于存储器单元的数量,使得第一分区单元1620A具有对应的第一存储器单元1624A,第二分区单元1620B具有对应的存储器单元1624B,并且第N分区单元1620N具有对应的第N存储器单元1624N。在其他实施例中,分区单元1620A-1620N的数量可以不等于存储器装置的数量。

在各种实施例中,存储器单元1624A-1624N可包括各种类型的存储器装置,包括动态随机存取存储器(DRAM)或图形随机存取存储器,诸如同步图形随机存取存储器(SGRAM),包括图形双倍数据速率(GDDR)存储器。在一个实施例中,存储器单元1624A-1624N还可以包括3D堆叠存储器,包括但不限于高带宽存储器(HBM)。本领域技术人员将意识到,存储器单元1624A-1624N的具体实现可以变化,并且可以从各种常规设计之一中选择。诸如帧缓冲器或纹理图的渲染目标可以跨存储器单元1624A-1624N来被存储,允许分区单元1620A-1620N并行地写入每个渲染目标的部分,以高效地使用并行处理器存储器1622的可用带宽。在一些实施例中,可以排除并行处理器存储器1622的本地实例,以有利于统一存储器设计,其利用结合本地高速缓冲存储器的系统存储器。

在一个实施例中,处理集群阵列1612的集群1614A-1614N中的任何一个能够处理将被写入并行处理器存储器1622内的存储器单元1624A-1624N中的任何存储器单元的数据。存储器交叉开关1616可配置成将每个集群1614A-1614N的输出传递到任何分区单元1620A-1620N或传递到另一集群1614A-1614N,所述另一集群1614A-1614N可对输出执行附加处理操作。每个集群1614A-1614N可以通过存储器交叉开关1616与存储器接口1618通信,以从各种外部存储器装置读取或向其写入。在一个实施例中,存储器交叉开关1616具有到存储器接口1618的连接以与I/O单元1604通信,并且具有到并行处理器存储器1622的本地实例的连接,使得不同处理集群1614A-1614N内的处理单元能够与系统存储器或不在并行处理单元1602本地的其他存储器通信。在一个实施例中,存储器交叉开关1616能够使用虚拟通道来分离集群1614A-1614N和分区单元1620A-1620N之间的业务流。

虽然在并行处理器1600内示出并行处理单元1602的单个实例,但是可包括并行处理单元1602的任何数量的实例。例如,并行处理单元1602的多个实例可以被提供在单个插件卡上,或者多个插件卡可以被互连。并行处理单元1602的不同实例可配置成互操作,即使所述不同实例具有不同数量的处理核、不同量的本地并行处理器存储器和/或其他配置差异。例如在一个实施例中,并行处理单元1602的一些实例可包括相对于其他实例的更高精度浮点单元。合并并行处理单元1602或并行处理器1600的一个或多个实例的系统能够以各种配置和形状因素来实现,包括但不限于桌面型、膝上型或手持式个人计算机、服务器、工作站、游戏控制台和/或嵌入式系统。

图16B是根据实施例的分区单元1620的框图。在一个实施例中,分区单元1620是图16A的分区单元1620A-1620N之一的实例。如所示出的,分区单元1620包括L2高速缓存1621、帧缓冲器接口1625和ROP 1626(光栅操作单元)。L2高速缓存1621是读/写高速缓存,其配置成执行从存储器交叉开关1616和ROP 1626接收的加载和存储操作。读取未命中及紧急写回请求由L2高速缓存1621输出到帧缓冲器接口1625以供处理。更新也可经由帧缓冲器接口1625被发送到帧缓冲器以供处理。在一个实施例中,帧缓冲器接口1625与并行处理器存储器中的存储器单元之一通过接口交互,所述存储器单元诸如图16的存储器单元1624A-1624N(例如,在并行处理器存储器1622内)。

在图形应用中,ROP 1626是执行光栅操作的处理单元,所述光栅操作诸如模板(stencil)、z测试、混合等。ROP 1626然后输出存储在图形存储器中的经处理的图形数据。在一些实施例中,ROP 1626包括压缩逻辑以压缩写入存储器的深度或颜色数据并且解压缩从存储器读取的深度或颜色数据。压缩逻辑可以是利用多种压缩算法中的一种或多种的无损压缩逻辑。由ROP1626执行的压缩的类型可基于要压缩的数据的统计特性而变化。例如,在一个实施例中,在每贴片的基础上对深度和颜色数据执行增量颜色压缩。

在一些实施例中,ROP 1626被包括在每个处理集群(例如,图16的集群1614A-1614N)内而不是在分区单元1620内。在此类实施例中,通过存储器交叉开关1616传送对像素数据的读取和写入请求而不是像素片段数据。经处理的图形数据可以显示在显示装置(诸如图15的一个或多个显示装置1510之一)上,被路由以用于由(一个或多个)处理器1502进一步处理,或被路由以用于由图16A的并行处理器1600内的处理实体之一进一步处理。

图16C是根据实施例的并行处理单元内的处理集群1614的框图。在一个实施例中,处理集群是图16的处理集群1614A-1614N中的一个处理集群的实例。处理集群1614可配置成并行地执行许多线程,其中术语“线程”是指对输入数据的特定集合执行的特定程序的实例。在一些实施例中,单指令多数据(SIMD)指令发布技术用于支持大量线程的并行执行,而不提供多个独立指令单元。在其他实施例中,单指令多线程(SIMT)技术用于使用配置成向处理集群中的每一个处理集群内的一组处理引擎发布指令的共同指令单元来支持大量一般同步的线程的并行执行。不同于SIMD执行机制,其中所有处理引擎通常执行相同的指令,SIMT执行允许不同的线程更容易地遵循通过给定线程程序的发散执行路径。本领域技术人员将理解SIMD处理机制表示SIMT处理机制的功能子集。

可以经由将处理任务分发给SIMT并行处理器的流水线管理器1632来控制处理集群1614的操作。流水线管理器1632从图16的调度器1610接收指令,并且经由图形多处理器1634和/或纹理单元1636管理那些指令的执行。所示出的图形多处理器1634是SIMT并行处理器的示例性实例。然而,不同架构的各种类型的SIMT并行处理器可以被包括在处理集群1614内。图形多处理器1634的一个或多个实例可以被包括在处理集群1614内。图形多处理器1634可处理数据,并且数据交叉开关1640可用于将经处理的数据分发到多个可能目的地(包括其他着色器单元)之一。流水线管理器1632可通过指定要经由数据交叉开关1640分发的经处理的数据的目的地来促进经处理的数据的分发。

处理集群1614内的每个图形多处理器1634可包括功能执行逻辑(例如,算术逻辑单元、加载-存储单元等)的相同集合。功能执行逻辑可以以流水线方式配置,其中新指令可以在先前指令完成之前被发布。功能执行逻辑支持各种运算,包括整数和浮点算术、比较运算、布尔运算、移位和各种代数函数的计算。在一个实施例中,可以利用相同的功能单元硬件来执行不同的操作,并且可以存在功能单元的任何组合。

传送到处理集群1614的指令构成线程。跨并行处理引擎集合执行的线程集合是线程组。线程组对不同的输入数据执行相同的程序。线程组内的每个线程可被指派给图形多处理器1634内的不同处理引擎。线程组可包括比图形多处理器1634内的处理引擎的数量少的线程。当线程组包括比处理引擎的数量少的线程时,处理引擎中的一个或多个处理引擎可能在处理该线程组的循环期间空闲。线程组也可包括比图形多处理器1634内的处理引擎的数量多的线程。当线程组包括比图形多处理器1634内的处理引擎的数量多的线程时,可在连续时钟循环上执行处理。在一个实施例中,多个线程组可以在图形多处理器1634上并发地执行。

在一个实施例中,图形多处理器1634包括内部高速缓冲存储器以执行加载和存储操作。在一个实施例中,图形多处理器1634可以放弃内部高速缓存,并使用处理集群1614内的高速缓冲存储器(例如,L1高速缓存308)。每个图形多处理器1634还可以访问分区单元(例如,图16的分区单元1620A-1620N)内的L2高速缓存,所述L2高速缓存在所有处理集群1614之间共享且可用于在线程之间传递数据。图形多处理器1634还可访问芯片外全局存储器,其可包括本地并行处理器存储器和/或系统存储器中的一个或多个。并行处理单元1602外部的任何存储器可用作全局存储器。其中处理集群1614包括图形多处理器1634的多个实例的实施例可共享可存储在L1高速缓存1708中的公共指令和数据。

每个处理集群1614可以包括MMU 1645(存储器管理单元),其配置成将虚拟地址映射到物理地址。在其他实施例中,MMU 1645的一个或多个实例可以驻留在图16的存储器接口1618内。MMU 1645包括用于将虚拟地址映射到贴片(更多地讨论拼贴)的物理地址的页表条目(PTE)的集合以及可选的高速缓存线索引。MMU 1645可包括可驻留在图形多处理器1634或L1高速缓存或处理集群1614内的高速缓存或地址转换后备缓冲器(TLB)。处理物理地址以分发表面数据访问局部性,以允许在分区单元之间的高效请求交错。高速缓存线索引可用于确定对高速缓存线的请求是命中还是未命中。

在图形及计算应用中,处理集群1614可配置成使得每个图形多处理器1634耦合至纹理单元1636以便执行纹理映射操作,例如,确定纹理样本位置、读取纹理数据以及过滤纹理数据。纹理数据从内部纹理L1高速缓存(未示出)读取,或者在一些实施例中从图形多处理器1634内的L1高速缓存读取,并且根据需要从L2高速缓存、本地并行处理器存储器或系统存储器获取。每个图形多处理器1634将经处理的任务输出到数据交叉开关1640,以将经处理的任务提供给另一处理集群1614以用于进一步处理,或经由存储器交叉开关1616将经处理的任务存储在L2高速缓存、本地并行处理器存储器或系统存储器中。preROP 1642(预光栅操作单元)配置成从图形多处理器1634接收数据,将数据引导到ROP单元,所述ROP单元可与如本文中所述的分区单元(例如,图16的分区单元1620A-1620N)一起定位。preROP1642单元可以执行对颜色混合的优化、组织像素颜色数据并且执行地址转换。

将意识到,本文中描述的核架构是说明性的,并且变化和修改是可能的。在处理集群1614内可以包括任何数量的处理单元,例如图形多处理器1634、纹理单元1636、preROP1642等。此外,虽然仅示出一个处理集群1614,但如本文中描述的并行处理单元可以包括处理集群1614的任何数量的实例。在一个实施例中,每个处理集群1614可以配置成使用单独且不同的处理单元、L1高速缓存等来独立于其他处理集群1614进行操作。

图16D示出根据一个实施例的图形多处理器1634。在此类实施例中,图形多处理器1634与处理集群1614的流水线管理器1632耦合。图形多处理器1634具有执行流水线,其包括但不限于指令高速缓存1652、指令单元1654、地址映射单元1656、寄存器堆1658、一个或多个通用图形处理单元(GPGPU)核1662以及一个或多个加载/存储单元1666。GPGPU核1662和加载/存储单元1666经由存储器和高速缓存互连1668与高速缓冲存储器1672和共享存储器1670耦合。

在一个实施例中,指令高速缓存1652从流水线管理器1632接收要执行的指令流。指令被高速缓存在指令高速缓存1652中,并被分派以便由指令单元1654执行。指令单元1654可将指令分派为线程组(例如,线程束(warp)),其中线程组的每个线程被指派给GPGPU核1662内的不同执行单元。指令可通过指定统一地址空间内的地址来访问本地、共享或全局地址空间中的任何一个。地址映射单元1656可用于将统一地址空间中的地址转换成可由加载/存储单元1666访问的不同的存储器地址。

寄存器堆1658为图形多处理器1724的功能单元提供一组寄存器。寄存器堆1658为操作数提供连接到图形多处理器1724的功能单元(例如,GPGPU核1662、加载/存储单元1666)的数据路径的临时存储。在一个实施例中,寄存器堆1658在功能单元中的每个功能单元之间划分,使得每个功能单元被分配寄存器堆1658的专用部分。在一个实施例中,寄存器堆1658在由图形多处理器1724执行的不同线程束之间划分。

GPGPU核1662可各自包括用于执行图形多处理器1724的指令的浮点单元(FPU)和/或整数算术逻辑单元(ALU)。根据实施例,GPGPU核1662可在架构上类似或可在架构上不同。例如在一个实施例中,GPGPU核1662的第一部分包括单精度FPU和整数ALU,而GPGPU核的第二部分包括双精度FPU。在一个实施例中,FPU可以实现用于浮点算数的IEEE 754-2008标准,或者使得能够进行可变精度浮点算数。图形多处理器1724可另外包括一个或多个固定功能或特殊功能单元以执行特定功能,诸如复制矩形或像素混合操作。在一个实施例中,GPGPU核中的一个或多个也可包括固定或特殊功能逻辑。

在一个实施例中,GPGPU核1662包括能够对多个数据集合执行单个指令的SIMD逻辑。在一个实施例中,GPGPU核1662可以在物理上执行SIMD4、SIMD8和SIMD16指令,并且在逻辑上执行SIMD1、SIMD2和SIMD32指令。用于GPGPU核的SIMD指令可以在编译时由着色器编译器生成,或者在执行针对单程序多数据(SPMD)或SIMT架构编写和编译的程序时自动被生成。为SIMT执行模型配置的程序的多个线程可以经由单个SIMD指令执行。例如在一个实施例中,执行相同或相似操作的八个SIMT线程可以经由单个SIMD8逻辑单元并行执行。

存储器和高速缓存互连1668是互连网络,其将图形多处理器1724的功能单元中的每个功能单元连接到寄存器堆1658和共享存储器1670。在一个实施例中,存储器和高速缓存互连1668是交叉开关互连,其允许加载/存储单元1666实现共享存储器1670和寄存器堆1658之间的加载和存储操作。寄存器堆1658能够以与GPGPU核1662相同的频率操作,因此GPGPU核1662与寄存器堆1658之间的数据传递有非常低的时延。共享存储器1670可用于实现在图形多处理器1634内的功能单元上执行的线程之间的通信。高速缓冲存储器1672可用作数据高速缓存,例如,以对在功能单元与纹理单元1636之间传递的纹理数据进行高速缓存。共享存储器1670也可以用作程序管理的高速缓存。除了存储在高速缓冲存储器1672内的自动高速缓存的数据之外,在GPGPU核1662上执行的线程还能够以编程方式将数据存储在共享存储器内。

图17A-17B示出了根据实施例的附加图形多处理器。所示出的图形多处理器1725、1750是图16C的图形多处理器1634的变型。所示出的图形多处理器1725、1750可以配置为能够同时执行大量执行线程的流多处理器(SM)。

图17A示出根据附加实施例的图形多处理器1725。图形多处理器1725包括相对于图16D的图形多处理器1634的执行资源单元的多个附加实例。例如,图形多处理器1725可包括指令单元1732A-1732B、寄存器堆1734A-1734B和(一个或多个)纹理单元1744A-1744B的多个实例。图形多处理器1725还包括多组图形或计算执行单元(例如,GPGPU核1736A-1736B、GPGPU核1737A-1737B、GPGPU核1738A-1738B)和多组加载/存储单元1740A-1740B。在一个实施例中,执行资源单元具有公共指令高速缓存1730、纹理和/或数据高速缓冲存储器1742以及共享存储器1746。

各种组件可经由互连组构1727通信。在一个实施例中,互连组构1727包括一个或多个交叉开关交换器以实现图形多处理器1725的各种组件之间的通信。在一个实施例中,互连组构1727是单独的高速网络组构层,图形多处理器1725的每个组件堆叠在该单独的高速网络组构层上。图形多处理器1725的组件经由互连组构1727与远程组件通信。例如,GPGPU核1736A-1736B、1737A-1737B和1738A-1738B可各自经由互连组构1727与共享存储器1746通信。互连组构1727可以仲裁图形多处理器1725内的通信,以确保组件之间的公平带宽分配。

图17B示出根据附加实施例的图形多处理器1750。图形处理器包括多组执行资源1756A-1756D,其中每组执行资源包括多个指令单元、寄存器堆、GPGPU核以及加载存储单元,如图16D和图17A中所示。执行资源1756A-1756D可与(一个或多个)纹理单元1760A-1760D协同工作以用于纹理操作,同时共享指令高速缓存1754和共享存储器1762。在一个实施例中,执行资源1756A-1756D可共享指令高速缓存1754和共享存储器1762,以及纹理和/或数据高速缓冲存储器1758A-1758B的多个实例。各种组件可经由类似于图17A的互连组构1727的互连组构1752通信。

本领域技术人员将理解,图15、16A-16D和17A-17B中描述的架构是描述性的,而不是对本实施例范围的限制。因此,在不脱离本文中所述实施例的范围的情况下,本文中所述的技术可实现在任何适当配置的处理单元上,所述处理单元非限制地包括一个或多个移动应用处理器、一个或多个桌面型电脑或服务器中央处理单元(CPU)(包括多核CPU)、一个或多个并行处理单元(诸如图16的并行处理单元1602)以及一个或多个图形处理器或专用处理单元。

在一些实施例中,如本文中所述的并行处理器或GPGPU在通信上耦合到主机/处理器核以加速图形操作、机器学习操作、模式分析操作和各种通用GPU(GPGPU)功能。GPU可通过总线或其他互连(例如,高速互连,诸如PCIe或NVLink)在通信上耦合到主机处理器/核。在其他实施例中,GPU可以集成在与核相同的封装或芯片上,并且通过内部处理器总线/互连(即,在封装或芯片内部)在通信上耦合到核。不管连接GPU的方式如何,处理器核可以用工作描述符中包含的命令/指令的序列的形式将工作分配给GPU。GPU接着使用专用电路/逻辑以便高效地处理这些命令/指令。

图18A示出其中多个GPU 1810-1813通过高速链路1840-1843(例如,总线、点对点互连等)在通信上耦合到多个多核处理器1805-1806的示例性架构。在一个实施例中,高速链路1840-1843支持4GB/s、30GB/s、80GB/s或更高的通信吞吐量,这取决于实现。可以使用各种互连协议,包括但不限于PCIe 4.0或5.0和NVLink 2.0。然而,本发明的基本原理不限于任何特定通信协议或吞吐量。

另外,在一个实施例中,GPU 1810-1813中的两个或更多个GPU通过高速链路1844-1845互连,所述高速链路1844-1845可使用与用于高速链路1840-1843的那些协议/链路相同或不同的协议/链路来实现。类似地,多核处理器1805-1806中的两个或更多个多核处理器可通过高速链路1833连接,该高速链路1833可以是以20GB/s、30GB/s、120GB/s或者更高操作的对称多处理器(SMP)总线。备选地,图18A中所示的各种系统组件之间的所有通信可以使用相同的协议/链路(例如,通过公共互连组构)来实现。然而,如所提到的,本发明的基本原理不限于任何特定类型的互连技术。

在一个实施例中,每个多核处理器1805-1806分别经由存储器互连1830-1831在通信上耦合到处理器存储器1801-1802,并且每个GPU 1810-1813分别通过GPU存储器互连1850-1853在通信上耦合到GPU存储器1820-1823。存储器互连1830-1831和1850-1853可以利用相同或不同的存储器访问技术。通过示例并且非限制的方式,处理器存储器1801-1802和GPU存储器1820-1823可以是易失性存储器,诸如动态随机存取存储器(DRAM)(包括堆叠式DRAM)、图形DDR SDRAM(GDDR)(例如,GDDR5、GDDR6)或高带宽存储器(HBM),和/或可以是非易失性存储器,诸如3D XPoint或Nano-Ram。在一个实施例中,存储器的一些部分可以是易失性存储器,并且另一部分可以是非易失性存储器(例如,使用两级存储器(2LM)层级)。

如下文所述,尽管各种处理器1805-1806和GPU 1810-1813可分别物理耦合到特定存储器1801-1802、1820-1823,但可实现统一的存储器架构,其中相同的虚拟系统地址空间(也称为“有效地址”空间)分布在所有的各种物理存储器之中。例如,处理器存储器1801-1802可以各自包括64GB的系统存储器地址空间,并且GPU存储器1820-1823可以各自包括32GB的系统存储器地址空间(在该示例中导致总共256GB可寻址存储器)。

图18B示出了根据一个实施例的多核处理器1807和图形加速模块1846之间的互连的附加细节。图形加速模块1846可以包括集成在线路卡上的一个或多个GPU芯片,该线路卡经由高速链路1840耦合到处理器1807。备选地,图形加速模块1846可集成在与处理器1807相同的封装或芯片上。

所示出的处理器1807包括多个核1860A-1860D,其各自具有转换后备缓冲器1861A-1861D和一个或多个高速缓存1862A-1862D。核可以包括用于执行指令和处理数据的各种其他组件(例如,指令获取单元、分支预测单元、解码器、执行单元、重排序缓冲器等),所述其他组件未被示出以避免模糊本发明的基本原理。高速缓存1862A-1862D可包括1级(L1)和2级(L2)高速缓存。另外,一个或多个共享高速缓存1826可以被包括在高速缓存层级中,并且由核1860A-1860D的集合共享。例如,处理器1807的一个实施例包括24个核(每个核具有其自己的L1高速缓存)、十二个共享L2高速缓存以及十二个共享L3高速缓存。在该实施例中,L2和L3高速缓存之一由两个相邻核共享。处理器1807和图形加速器集成模块1846与系统存储器1841连接,该系统存储器1841可以包括处理器存储器1801-1802。

经由一致性总线1864上的核间通信,为存储在各个高速缓存1862A-1862D、1856和系统存储器1841中的数据和指令保持一致性。例如,每个高速缓存可以具有与之相关联的高速缓存一致性逻辑/电路,以响应于检测到的对特定高速缓存线的读或写而通过一致性总线1864进行通信。在一个实现中,在一致性总线1864上实现高速缓存探听协议以探听高速缓存访问。高速缓存探听/一致性技术是本领域技术人员所熟知的,并且在此将不详细描述以避免模糊本发明的基本原理。

在一个实施例中,代理电路1825将图形加速模块1846在通信上耦合到一致性总线1864,允许图形加速模块1846作为核的对等方参与高速缓存一致性协议。特别地,接口1835通过高速链路1840(例如,PCIe总线、NVLink等)提供到代理电路1825的连接性,并且接口1837将图形加速模块1846连接到链路1840。

在一个实现中,加速器集成电路1836代表图形加速模块1846的多个图形处理引擎1831、1832、N提供高速缓存管理、存储器访问、上下文管理和中断管理服务。图形处理引擎1831、1832、N可各自包括单独的图形处理单元(GPU)。备选地,图形处理引擎1831、1832、N可以包括在GPU内的不同类型的图形处理引擎,诸如图形执行单元、媒体处理引擎(例如,视频编码器/解码器)、采样器和blit引擎。换句话说,图形加速模块可以是具有多个图形处理引擎1831-1832、N的GPU,或者图形处理引擎1831-1832、N可以是集成在公共封装、线路卡或芯片上的单独GPU。

在一个实施例中,加速器集成电路1836包括存储器管理单元(MMU)1839,其用于执行各种存储器管理功能,诸如虚拟到物理存储器转换(也称为有效到真实存储器转换)和用于访问系统存储器1841的存储器访问协议。MMU 1839还可以包括转换后备缓冲器(TLB)(未示出),其用于高速缓存虚拟/有效到物理/真实地址转换。在一个实现中,高速缓存1838存储命令和数据以用于由图形处理引擎1831、1832、N高效访问。在一个实施例中,存储在高速缓存1838和图形存储器1833-1834、N中的数据保持与核高速缓存1862A-1862D、1856和系统存储器1811一致。如所提到的,这可以经由代理电路1825来实现,该代理电路1825代表高速缓存1838和存储器1833-1834、N参与高速缓存一致性机制(例如,向高速缓存1838发送与处理器高速缓存1862A-1862D、1856上的高速缓存行的修改/访问相关的更新,并从高速缓存1838接收更新)。

寄存器1845的集合储存由图形处理引擎1831-1832、N执行的线程的上下文数据,并且上下文管理电路1848管理线程上下文。例如,上下文管理电路1848可以执行保存和恢复操作,以在上下文切换期间保存和恢复各个线程的上下文(例如,其中保存第一线程,并且存储第二线程,使得第二线程可以由图形处理引擎执行)。例如,在上下文切换时,上下文管理电路1848可以将当前寄存器值存储到存储器中的规定区域(例如,由上下文指针标识的)。然后,当返回到上下文时,它可以恢复寄存器值。在一个实施例中,中断管理电路1847接收和处理从系统装置接收的中断。

在一个实现中,来自图形处理引擎1831的虚拟/有效地址由MMU 1839转换成系统存储器1811中的真实/物理地址。加速器集成电路1836的一个实施例支持多个(例如,4、8、16个)图形加速器模块1846和/或其他加速器装置。图形加速器模块1846可以专用于在处理器1807上执行的单个应用,或者可以在多个应用之间共享。在一个实施例中,呈现了虚拟化图形执行环境,其中图形处理引擎1831-1832、N的资源与多个应用或虚拟机(VM)共享。资源可以被细分为“切片”,基于与VM和/或应用相关联的处理要求和优先级,将所述切片分配给不同的VM和/或应用。

因此,加速器集成电路充当图形加速模块1846的到系统的桥,并且提供地址转换和系统存储器高速缓存服务。另外,加速器集成电路1836可以为主机处理器提供虚拟化工具,以管理图形处理引擎、中断和存储器管理的虚拟化。

因为图形处理引擎1831-1832、N的硬件资源被显式地映射到由主机处理器1807所见的真实地址空间,所以任何主机处理器都可以使用有效地址值来直接寻址这些资源。在一个实施例中,加速器集成电路1836的一个功能是图形处理引擎1831-1832、N的物理分离,使得它们对于系统表现为独立单元。

如所提到的,在所示出的实施例中,一个或多个图形存储器1833-1834、M分别耦合到图形处理引擎1831-1832、N中的每个图形处理引擎。图形存储器1833-1834、M存储由图形处理引擎1831-1832、N中的每个图形处理引擎处理的指令和数据。图形存储器1833-1834、M可以是易失性存储器,诸如DRAM(包括堆叠式DRAM)、GDDR存储器(例如GDDR5、GDDR6)或HBM,和/或可以是非易失性存储器,诸如3D XPoint或Nano-Ram。

在一个实施例中,为了减少链路1840上的数据业务,使用偏置技术来确保存储在图形存储器1833-1834、M中的数据是将被图形处理引擎1831-1832、N最频繁地使用并且优选地不被核1860A-1860D使用(至少不频繁)的数据。类似地,偏置机制试图将核(并且优选地不是图形处理引擎1831-1832、N)所需要的数据保持在核和系统存储器1811的高速缓存1862A-1862D、1856内。

图18C示出其中加速器集成电路1836集成在处理器1807内的另一个实施例。在该实施例中,图形处理引擎1831-1832、N经由接口1837和接口1835(其也可以利用任何形式的总线或接口协议)在高速链路1840上直接向加速器集成电路1836通信。加速器集成电路1836可以执行与相对于图18B描述的那些操作相同的操作,但是考虑到其非常接近一致性总线1862和高速缓存1862A-1862D、1826潜在地以更高的吞吐量执行该操作。

一个实施例支持不同的编程模型,包括专用进程编程模型(没有图形加速模块虚拟化)和共享编程模型(具有虚拟化)。后者可以包括由加速器集成电路1836控制的编程模型和由图形加速模块1846控制的编程模型。

在专用进程模型的一个实施例中,图形处理引擎1831-1832、N专用于单个操作系统下的单个应用或进程。单个应用可以将其他应用请求汇集到图形引擎1831-1832、N,在VM/分区内提供虚拟化。

在专用进程编程模型中,图形处理引擎1831、1832、N可以由多个VM/应用分区共享。共享模型要求系统管理程序来虚拟化图形处理引擎1831-1832、N,以允许由每个操作系统进行访问。对于没有管理程序的单分区系统,图形处理引擎1831-1832、N由操作系统拥有。在这两种情况下,操作系统都可以虚拟化图形处理引擎1831-1832、N,以提供对每个进程或应用的访问。

对于共享编程模型,图形加速模块1846或单独的图形处理引擎1831-1832、N使用进程句柄选择进程元素。在一个实施例中,进程元素存储在系统存储器1811中,并且可使用本文中描述的有效地址到真实地址转换技术来寻址。进程句柄可以是当向图形处理引擎1831-1832、N注册其上下文(即,调用系统软件以将进程元素添加到进程元素链接列表)时提供给主机进程的可以特定于实现的值。进程句柄的较低16位可以是进程元素链接列表内的进程元素的偏移。

图18D示出了示例性加速器集成切片1890。如本文所使用的,“切片”包括加速器集成电路1836的处理资源的指定部分。系统存储器1811内的应用有效地址空间1882存储进程元素1883。在一个实施例中,响应于来自在处理器1807上执行的应用1880的GPU调用1881而存储进程元素1883。进程元素1883包含对应应用1880的进程状态。被包含在进程元素1883中的工作描述符(WD)1884可以是应用所请求的单个作业,或者可以包含指向作业队列的指针。在后一种情况下,WD 1884是指向应用的地址空间1882中的作业请求队列的指针。

图形加速模块1846和/或各个图形处理引擎1831-1832、N可以由系统中的进程的全部或子集共享。本发明的实施例包括用于设置进程状态并将WD 1884发送到图形加速模块1846以在虚拟化环境中启动作业的基础设施。

在一个实现中,专用进程编程模型是实现特定的。在该模型中,单个进程拥有图形加速模块1846或单独的图形处理引擎1831。因为图形加速模块1846由单个进程拥有,所以管理程序为拥有的分区初始化加速器集成电路1836,并且操作系统在图形加速模块1846被指派时为拥有的进程初始化加速器集成电路1836。

在操作中,加速器集成切片1890中的WD获取单元1891提取下一WD 1884,其包括对要由图形加速模块1846的图形处理引擎之一进行的工作的指示。来自WD 1884的数据可以存储在寄存器1845中,并且由MMU 1839、中断管理电路1847和/或上下文管理电路1846使用,如所示出的。例如,MMU 1839的一个实施例包括用于访问OS虚拟地址空间1885内的段/页表1886的段/页行走电路(segment/page walk circuitry)。中断管理电路1847可以处理从图形加速模块1846接收的中断事件1892。当执行图形操作时,由图形处理引擎1831-1832、N生成的有效地址1893被MMU 1839转换为真实地址。

在一个实施例中,寄存器1845的相同集合针对每个图形处理引擎1831-1832、N和/或图形加速模块1846来复制,并且可以由管理程序或操作系统来初始化。这些复制的寄存器中的每个都可以被包括在加速器集成切片1890中。表1中示出了可以由管理程序初始化的示例性寄存器。

表1-管理程序初始化的寄存器

在表2中示出可由操作系统初始化的示例性寄存器。

表2-操作系统初始化的寄存器

在一个实施例中,每个WD 1884特定于特定图形加速模块1846和/或图形处理引擎1831-1832、N。它包含图形处理引擎1831-1832、N进行其工作所要求的所有信息,或者它可以是指向存储器位置的指针,在该存储器位置,应用已经设立了要完成的工作的命令队列。

图18E示出了共享模型的一个实施例的附加细节。该实施例包括其中存储进程元素列表1899的管理程序实际地址空间1898。管理程序真实地址空间1898可经由虚拟化用于操作系统1895的图形加速模块引擎的管理程序1896来访问。

共享编程模型虑及来自系统中的分区的全部或子集的进程的全部或子集使用图形加速模块1846。存在其中图形加速模块1846由多个进程和分区共享的两个编程模型:时间切片共享和图形定向共享。

在该模型中,系统管理程序1896拥有图形加速模块1846并使其功能对所有操作系统1895可用。为了使图形加速模块1846支持由系统管理程序1896进行的虚拟化,图形加速模块1846可以遵守以下要求:1)应用的作业请求必须是自主的(即,在作业之间不需要维持状态),或者图形加速模块1846必须提供上下文保存和恢复机制。2)应用的作业请求由图形加速模块1846保证在指定时间量内完成,包括任何转换错误,或者图形加速模块1846提供抢占作业的处理的能力。3)当在定向共享编程模型中操作时,必须保证图形加速模块1846在进程之间的公平性。

在一个实施例中,对于共享模型,要求应用1880用图形加速模块1846类型、工作描述符(WD)、权限屏蔽寄存器(AMR)值和上下文保存/恢复区域指针(CSRP)来进行操作系统1895系统调用。图形加速模块1846类型描述用于系统调用的目标加速功能。图形加速模块1846类型可以是系统特定值。WD被专门格式化以用于图形加速模块1846,并且可以采用图形加速模块1846命令、指向用户定义结构的有效地址指针、指向命令队列的有效地址指针、或描述要由图形加速模块1846进行的工作的任何其他数据结构的形式。在一个实施例中,AMR值是要用于当前进程的AMR状态。传递到操作系统的值类似于设置AMR的应用。如果加速器集成电路1836和图形加速模块1846实现不支持用户权限屏蔽覆盖寄存器(UAMOR),则操作系统可以在管理程序调用中传递AMR之前将当前UAMOR值应用于AMR值。管理程序1896可以在将AMR放入进程单元1883之前可选地应用当前的权限屏蔽覆盖寄存器(AMOR)值。在一个实施例中,CSRP是寄存器1845之一,其包含应用的地址空间1882中用于图形加速模块1846保存和恢复上下文状态的区域的有效地址。如果在作业之间不要求保存状态或者当作业被抢占时,该指针是可选的。上下文保存/恢复区域可以是固定的系统存储器。

在接收到系统调用时,操作系统1895可验证应用1880已注册并且已被给予使用图形加速模块1846的权限。然后,操作系统1895用表3中所示的信息调用管理程序1896。

表3 - OS到管理程序调用参数

在接收到管理程序调用时,管理程序1896验证操作系统1895已注册并且已被给予使用图形加速模块1846的权限。然后,管理程序1896将进程元素1883放入对应图形加速模块1846类型的进程元素链接列表。进程元素可以包括表4中所示的信息。

表4 - 进程元素信息

在一个实施例中,管理程序初始化多个加速器集成切片1890寄存器1845。

如图18F中所示出的,本发明的一个实施例采用可经由用于访问物理处理器存储器1801-1802和GPU存储器1820-1823的共同虚拟存储器地址空间寻址的统一存储器。在这种实现中,在GPU 1810-1813上执行的操作利用相同的虚拟/有效存储器地址空间来访问处理器存储器1801-1802,并且反之亦然,从而简化了可编程性。在一个实施例中,虚拟/有效地址空间的第一部分被分配给处理器存储器1801,第二部分被分配给第二处理器存储器1802,第三部分被分配给GPU存储器1820等等。整个虚拟/有效存储器空间(有时称为有效地址空间)由此跨处理器存储器1801-1802和GPU存储器1820-1823中的每个存储器分布,允许任何处理器或GPU访问具有映射到该存储器的虚拟地址的任何物理存储器。

在一个实施例中,在MMU 1839A-1839E中的一个或多个MMU内的偏置/一致性管理电路1894A-1894E确保主机处理器(例如,1805)和GPU 1810-1813的高速缓存之间的高速缓存一致性,并且实现指示其中应当存储某些类型的数据的物理存储器的偏置技术。虽然在图18F中示出了偏置/一致性管理电路1894A-1894E的多个实例,但是偏置/一致性电路可以在一个或多个主机处理器1805的MMU内和/或在加速器集成电路1836内实现。

一个实施例允许GPU附接存储器1820-1823被映射为系统存储器的一部分,并使用共享虚拟存储器(SVM)技术来被访问,而不遭受与全系统高速缓存一致性相关联的典型性能缺陷。在没有繁重的高速缓存一致性开销的情况下作为系统存储器来访问GPU附接存储器1820-1823的能力为GPU卸载提供了有益的操作环境。这种安排允许主机处理器1805软件设置操作数和访问计算结果,而没有传统I/O DMA数据拷贝的开销。这样的传统拷贝涉及驱动器调用、中断和存储器映射的I/O(MMIO)访问,其相对于简单的存储器访问都是低效的。同时,在没有高速缓存一致性开销的情况下访问GPU附接存储器1820-1823的能力对于卸载计算的执行时间可以是关键的。例如,在具有大量流式写入存储器业务的情况下,高速缓存一致性开销可以显著地减少GPU 1810-1813所见的有效写入带宽。操作数设置的效率、结果访问的效率以及GPU计算的效率都在确定GPU卸载的有效性中起作用。

在一个实现中,GPU偏置和主机处理器偏置之间的选择由偏置追踪器数据结构驱动。例如,可以使用偏置表,其可以是每个GPU附接的存储器页包括1或2位的页粒度结构(即,以存储器页的粒度控制)。偏置表可以在一个或多个GPU附接的存储器1820-1823的被盗存储器范围中实现,在GPU 1810-1813中具有或不具有偏置高速缓存(例如,以高速缓存偏置表的频繁/最近使用的条目)。备选地,整个偏置表可维持在GPU内。

在一个实现中,在实际访问GPU存储器之前,访问与对GPU附接的存储器1820-1823的每次访问相关联的偏置表条目,导致以下操作。首先,在GPU偏置中找到其页的来自GPU1810-1813的本地请求被直接转发到对应的GPU存储器1820-1823。在主机偏置中找到其页的来自GPU的本地请求被转发到处理器1805(例如,通过如上文所论述的高速链路)。在一个实施例中,在主机处理器偏置中找到所请求的页的来自处理器1805的请求完成类似于正常存储器读取的请求。备选地,可将针对GPU偏置的页的请求转发至GPU 1810-1813。如果GPU当前没有正在使用该页,则GPU可然后将该页转移到主机处理器偏置。

可以通过基于软件的机制、硬件辅助的基于软件的机制、或者对于有限情况集合而言通过仅基于硬件的机制来改变页的偏置状态。

用于改变偏置状态的一种机制采用API调用(例如OpenCL),其接着调用GPU的装置驱动器,所述GPU的装置驱动器接着发送消息(或将命令描述符排队)到GPU,引导GPU改变偏置状态,并且对于某些转换,在主机中执行高速缓存转储清除操作。从主机处理器1805偏置到GPU偏置的转换要求高速缓存转储清除操作,但相反的转变不要求。

在一个实施例中,高速缓存一致性通过临时呈现不可由主机处理器1805高速缓存的GPU偏置的页来维持。为了访问这些页,处理器1805可从GPU 1810请求访问,所述GPU1810可以或可以不立即许可访问,这取决于实现。因此,为了减少处理器1805和GPU 1810之间的通信,确保GPU偏置的页是由GPU而不是主机处理器1805所要求的页是有益的,并且反之亦然。

图19示出根据实施例的图形处理流水线1900。在一个实施例中,图形处理器可实现所示出的图形处理流水线1900。图形处理器可被包括在如本文中所述的并行处理子系统(诸如,图16的并行处理器1600)内,所述并行处理子系统在一个实施例中是图15的(一个或多个)并行处理器1512的变型。各种并行处理系统可经由如本文中所描述的并行处理单元(例如,图16的并行处理单元1602)的一个或多个实例来实现图形处理流水线1900。例如,着色器单元(例如,图17的图形多处理器1634)可配置成执行顶点处理单元1904、曲面细分控制处理单元1908、曲面细分评估处理单元1912、几何处理单元1916和片段/像素处理单元1924中的一个或多个的功能。数据汇编器1902、图元汇编器1906、1914、1918、曲面细分单元1910、光栅化器1922及光栅操作单元1926的功能还可由处理集群(例如,图17的处理集群1614)以及对应分区单元(例如,图16的分区单元220A-220N)内的其他处理引擎执行。图形处理流水线1900还可使用用于一个或多个功能的专用处理单元来实现。在一个实施例中,图形处理流水线1900的一个或多个部分可以由通用处理器(例如,CPU)内的并行处理逻辑执行。在一个实施例中,图形处理流水线1900的一个或多个部分可以经由存储器接口1928访问片上存储器(例如,如图16中的并行处理器存储器1622),该存储器接口1928可以是图16的存储器接口1618的实例。

在一个实施例中,数据汇编器1902是收集表面和图元的顶点数据的处理单元。数据汇编器1902接着将包括顶点属性的顶点数据输出到顶点处理单元1904。顶点处理单元1904是可编程执行单元,其执行顶点着色器程序,所述顶点着色器程序照亮和变换如由顶点着色器程序所指定的顶点数据。顶点处理单元1904读取存储在高速缓存、本地或系统存储器中的数据,以供在处理顶点数据中使用,并且可以编程为将顶点数据从基于对象的坐标表示变换到世界空间坐标空间或规格化装置坐标空间。

图元汇编器1906的第一实例从顶点处理单元1904接收顶点属性。图元汇编器1906根据需要读取所存储的顶点属性,并且构造图形图元以用于由曲面细分控制处理单元1908处理。图形图元包括如由各种图形处理应用编程接口(API)所支持的三角形、线段、点、补片等。

曲面细分控制处理单元1908将输入顶点视为几何补片的控制点。控制点从来自补片的输入表示(例如,补片的基底)变换为适于供在由曲面细分评估处理单元1912进行的表面评估中使用的表示。曲面细分控制处理单元1908还可以计算几何补片的边缘的曲面细分因子。曲面细分因子应用于单个边缘并且量化与所述边缘相关联的视图依赖级别的细节。曲面细分单元1910配置成接收补片的边缘的曲面细分因子,并且将贴片曲面细分成多个几何图元(诸如线、三角形或四边形图元),其被传送到曲面细分评估处理单元1912。曲面细分评估处理单元1912对细分的补片的参数化坐标进行操作,以生成与几何图元相关联的每个顶点的表面表示和顶点属性。

图元汇编器1914的第二实例从曲面细分评估处理单元1912接收顶点属性,根据需要读取存储的顶点属性,并且构造图形图元以用于由几何处理单元1916处理。几何处理单元1916是可编程执行单元,其执行几何着色器程序以如几何着色器程序所指定的那样变换从图元汇编器1914接收的图形图元。在一个实施例中,几何处理单元1916编程为将图形图元细分为一个或多个新的图形图元,并且计算用于光栅化新的图形图元的参数。

在一些实施例中,几何处理单元1916能够添加或删除几何流中的元素。几何处理单元1916将指定新的图形图元的参数和顶点输出到图元汇编器1918。图元汇编器1918从几何处理单元1916接收参数和顶点,并且构造图形图元以用于由视口缩放、剔除和裁剪单元1920处理。几何处理单元1916读取存储在并行处理器存储器或系统存储器中的数据,以供在处理几何数据中使用。视口缩放、剔除和裁剪单元1920执行裁剪、剔除和视口缩放,并将经处理的图形图元输出到光栅化器1922。

光栅化器1922可以执行深度剔除和其他基于深度的优化。光栅化器1922还对新的图形图元执行扫描转换,以生成片段并将那些片段及相关联的覆盖数据输出到片段/像素处理单元1924。片段/像素处理单元1924是配置成执行片段着色器程序或像素着色器程序的可编程执行单元。片段/像素处理单元1924如由片段或像素着色器程序所指定的那样变换从光栅化器1922接收的片段或像素。例如,片段/像素处理单元1924可编程为执行包括但不限于纹理映射、着色、混合、纹理校正和透视校正的操作,以产生输出到光栅操作单元1926的着色片段或像素。片段/像素处理单元1924可读取存储在并行处理器存储器或系统存储器中的数据,以供在处理片段数据时使用。片段或像素着色器程序可配置成取决于配置用于处理单元的采样率而以样本、像素、贴片或其他粒度进行着色。

光栅操作单元1926是执行包括但不限于模板、z测试、混合等的光栅操作的处理单元,并且输出像素数据作为经处理的图形数据以存储在图形存储器(例如,如图16中的并行处理器存储器1622和/或如图15中的系统存储器1504)中,以在一个或多个显示装置1510上显示或用于由一个或多个处理器1502或并行处理器1512中的一个来进一步处理。在一些实施例中,光栅操作单元1926可配置成压缩写入到存储器的z或颜色数据,并且解压缩从存储器读取的z或颜色数据。

用于使用帧间预测的特征点跟踪的设备和方法

特征点跟踪是在诸如运动恢复结构(SFM)和全景处理(例如,如用于虚拟现实实现)的许多视频处理和图形领域中使用的技术。任何实现的第一步是相机校准,其使用特征点跟踪来确定相机的外在参数,这是复杂的问题。

要求特征点跟踪和匹配技术来从每个图像或视频流帧中检测特征点。然后,在图像对之间匹配特征点。对于每对图像,可使用近似最近邻方法来在这对图像之间匹配关键点描述符。图20示出从第一图像帧2001映射到第二图像帧2002的点的示例性集合,如由连接来自这两个图像帧的点的线所指示的。不是对整个第二帧进行编码,而是可使用向量来指定像素或像素集从第一图像帧2001到第二图像帧2002的移动。

解码器帧间预测是用于压缩视频流的广泛使用的技术。使用之前解码的帧或帧集合为当前帧导出预测值。诸如VP9的现代压缩视频位流格式使用帧间预测技术。帧间帧包括多个帧间块,所述帧间块中的每个帧间块包含运动向量,所述运动向量包括先前帧的指定部分的偏移,其用作对当前帧的预测。图21中示出示例,其示出不同大小的块和指示块在帧之间的移动的对应向量/偏移数据。

本发明的一个实施例应用解码器帧间预测技术来跨图像序列中的不同图像跟踪特征点。使用这些技术,用于点比较和匹配的搜索范围显著减少。由于帧间块的大小通常比整个帧小得多,所以可使用这些技术来减少特征点跟踪问题的计算复杂度。

在传统的匹配方法中,假设在帧0中检测到的每个特征点要与来自帧1的每个特征点进行比较。尽管高性能矩阵乘法可优化该问题,但是计算复杂度仍然很高。

如果对视频流的输入数据进行评估,那么帧间技术提供了简化特征点匹配问题的途径。例如,如图22所示,当帧2201是帧间帧时,打算根据相关联的运动向量将来自参考帧2200的块b0转移到当前帧1中的块b1中。本发明的一个实施例认识到,在b0中的任何特征点也转移到b1中。使用该帧间帧和运动向量数据,不将两个帧间帧之间的关键点与彼此逐个比较。而是,关键点对只出现在帧间帧之间的帧间块对中。

帧间块的大小显著小于整个帧的大小。使用VP9作为示例,帧间块的大小从4×4到64×64像素不等。给定帧和帧间块之间的显著的大小差异,极大地简化了对特征点对的搜索。

与传统的特征点跟踪机制相比,本发明的一个实施例通过运动向量将来自当前帧的关键点候选投影到参考帧,然后在参考帧中在它的相对帧间块中找到它的

图23示出了使用参考帧2300和相关联的运动数据2305(例如,帧间块向量)对当前帧2301实现这些技术的设备的一个实施例。图23中示出的组件可以用电路、软件或其任意组合实现。在一个实现中,示出的组件集成在诸如图8中的图形处理器800的GPU内(例如,在GPU内的视频解码器单元中)。在一个实施例中,一些组件在媒体流水线830内实现,并且一些组件使用在执行逻辑850上执行的软件实现。然而,本发明的基本原理不限于任何特定的架构布置。

关键点提取器2310从当前帧2301和参考帧2300中提取关键点。参考帧关键点可能已经在之前的迭代中被提取。点投影器2320使用运动数据2305来使用相关联的帧间块2302A-B的运动向量将来自当前帧2301的点

然后,邻居标识器2330标识p'的

图24中示出根据一个实施例的方法。该方法可在本文中描述的系统/处理器架构上执行,但不限于任何特定的系统/处理器架构。

在2400和2401,分别从帧f0和f1中提取关键点。在2402,使用与点

在2404,丢弃不在对应的帧间块(即,与

该实施例的仿真提供了证明这些技术的有效性和性能的以下结果。使用尺度不变特征转换(SIFT)作为关键点检测方法。运行时环境是MATLAB,并且使用VP9作为视频位流格式,其中从视频位流中提取前100个帧。

在对100个帧执行SIFT关键点检测方法和传统的匹配处理之后,在序列帧对中找到29751个点对。图25示出显示当前帧2501和它的参考帧2502之间的匹配的点对的示例。显著地,在29751对的整个集合中的27462对(92.3%)在通过运动向量匹配的对应的帧间块中。

在实现本发明的实施例时,对于第一帧对(帧1和帧2),分别找到1270和1226个关键点候选,并且匹配了306对。传统技术花费0.118786秒来匹配,而本发明的实施例仅花费0.015110秒。下表A示出平均加速为9.37的前10对帧的数据。

表A

为了简化仿真,将从第二个帧开始的所有帧看作帧间帧,并且丢弃非帧间块。在实践中,可对那些非帧间帧和非帧间块中的点执行传统的匹配技术,以实现大于92.3%的准确率。

还假设,所有的参考帧是先前帧,情况不总是如此。本发明的一个实施例使用与现有的视频解码器相同的参考策略来记录多个参考帧。然而,考虑到仿真中的100个帧中的大多数帧是指先前帧,所以结果是鲁棒的。

为了处理未命中跟踪/匹配问题(这意味着所述对将由传统方法来检测,而未能由本发明的实施例检测到),一个实现将参考帧中的搜索区域在帧间块之外扩展某个指定量。在一个实施例中,假设如果在“块对”中找到一些“点对”,那么所有相关的“点对”应当存在。然后,扩展搜索区域,直到标识所有点对为止。

使用这些技术,在仿真中匹配了另外460对,将准确率提高到93.9%。为了实现在本文中描述的技术,可将SIFT关键点检测过程和跟踪/匹配方法添加到视频流解码器(例如,在GPU的媒体处理单元中,如FPGA等)中。

本发明的实施例可包括上文已经描述的各种步骤。可以用机器可执行指令体现所述步骤,所述机器可执行指令可用于使通用或专用处理器执行所述步骤。备选地,这些步骤可由包含用于执行所述步骤的硬接线逻辑的特定硬件组件或由编程的计算机组件和定制硬件组件的任意组合来执行。

如本文中所描述的,指令可以指:硬件的特定配置,诸如配置成执行某些操作或具有预定功能性的专用集成电路(ASIC);或存储在用非暂时性计算机可读介质体现的存储器中的软件指令。因此,图中示出的技术可使用在一个或多个电子装置(例如,终端站、网络元件等)上存储和执行的代码和数据来实现。此类电子装置使用计算机机器可读介质来存储并(在内部和/或通过网络与其他电子装置)传递代码和数据,所述计算机机器可读介质诸如非暂时性计算机机器可读存储介质(例如,磁盘;光盘;随机存取存储器;只读存储器;闪速存储器装置;相变存储器)和暂时性计算机机器可读通信介质(例如,电、光、声或其他形式的传播信号,诸如载波、红外信号、数字信号等)。

另外,此类电子装置通常包括耦合到一个或多个其他组件的一个或多个处理器的集合,所述一个或多个其他组件诸如一个或多个存储装置(非暂时性机器可读存储介质)、用户输入/输出装置(例如,键盘、触摸屏和/或显示器)和网络连接。处理器的集合和其他组件的耦合通常通过一个或多个总线和桥接器(又称为总线控制器)。存储装置和携带网络业务的信号分别表示一个或多个机器可读存储介质和机器可读通信介质。因此,给定电子装置的存储装置通常存储代码和/或数据以便在该电子装置的一个或多个处理器的集合上执行。当然,本发明的实施例的一个或多个部分可使用软件、固件和/或硬件的不同组合来实现。在该详细描述通篇中,出于解释的目的,阐述了众多具体细节,以便提供对本发明的充分理解。然而,本领域技术人员将明白,没有这些具体细节中的一些细节的情况下可实践本发明。在某些情况下,没有详细地描述公知的结构和功能,以便避免混淆本发明的主题。因此,应当按照随附的权利要求来判断本发明的范围和精神。

- 用于使用帧间预测的特征点跟踪的设备和方法

- 用于使用手持设备来利用激光跟踪仪选择、锁定和跟踪后向反射器的方法