一种动态环境下移动机器人定位方法及系统

文献发布时间:2023-06-19 10:48:02

技术领域

本发明涉及移动机器人导航领域,特别是涉及一种动态环境下移动机器人的视觉定位方法及系统。

背景技术

机器人定位技术是完成其他任务的基础。机器人通过传感器感知周围环境信息,并对自身的姿态进行估计。激光雷达是机器人定位的一个较为流行的选择。然而,由于激光雷达有其自身的探测范围限制,以及仅仅能感知环境的位置信息,从而忽略信息更为丰富的纹理以及语义,因此,近年来,更多的人选择视觉传感器如单目、多目和深度相机来进行信息感知。

现有的基于视觉的机器人定位技术通常分为两种;直接法和间接法。间接法是首先对图片进行特征提取,然后匹配估计帧间相机位姿。直接法直接利用了图片像素的梯度信息来估计相机位姿。然而,不论是直接法还是间接法,目前的工作大都假定环境是静态的。对于动态环境例如商场、办公室等,目前方法往往不能达到令人满意的定位效果。

发明内容

为了弥补上述现有技术的不足,本发明提出一种稳定准确的动态环境下移动机器人的视觉定位方法及系统。

为此,本发明所提出的动态环境下移动机器人定位方法包括如下步骤:S1、进行图片动态区域检测;S2、进行动态环境精确定位,包括:S21、通过视觉定位与建图模块提供了移动机器人最基本的定位;S22、通过检测到的动态区域信息以及纹理信息,有选择的分配每个区域的特征点采集数量。

在一些实施例中,还包括如下特征:

所述步骤S1包括:S11、追踪动态区域;S12、获取目前帧的状态,并得到当前帧的动态特性;S13、得到最终的动态区域。

步骤S11中,利用输入视频帧间的序列信息关系,来追踪动态区域。

步骤S12中,利用动态区域中帧间的差异信息获取目前帧的状态;通过设置参考帧与有效阈值,得到当前帧的动态特性。

步骤S13中,通过融合跟踪模块和增量式检测模块,从而得到最终的动态区域。

步骤S11中,一旦动态区域确定,将作为下一帧图片的输入,通过特征追踪匹配,得到下一帧相应的动态区域;步骤S11的输入包括当前帧和上一帧;对于上一帧图片,动态区域是作为先验知识。

系统每输入一张图片,首先将其栅格化,然后针对上一帧的动态区域进行特征提取;特征提取之后,使用光流模型追踪这些特征点到当前帧,得到与之匹配的特征点。

步骤S13中,通过栅格中追踪到的特征点的数量来确定当前帧的动态区域。

步骤S12中,利用动态区域中帧间的差异信息来获取目前帧的状态。

本发明还提出一种动态环境下移动机器人定位系统,采用如上所述的方法。

本发明与现有技术对比的有益效果包括:(1)通过构建贝叶斯网络,有效融合了视频序列帧间关系包括相似信息与差异,有效检测出了输入图片的动态区域,从而为精准定位提供了基础。(2)通过构建特征点提取模块,有效降低了动态特征点的比例,提高了定位的精准性;同时通过合理分配特征点采集数量,保证了丰富的特征信息。

附图说明

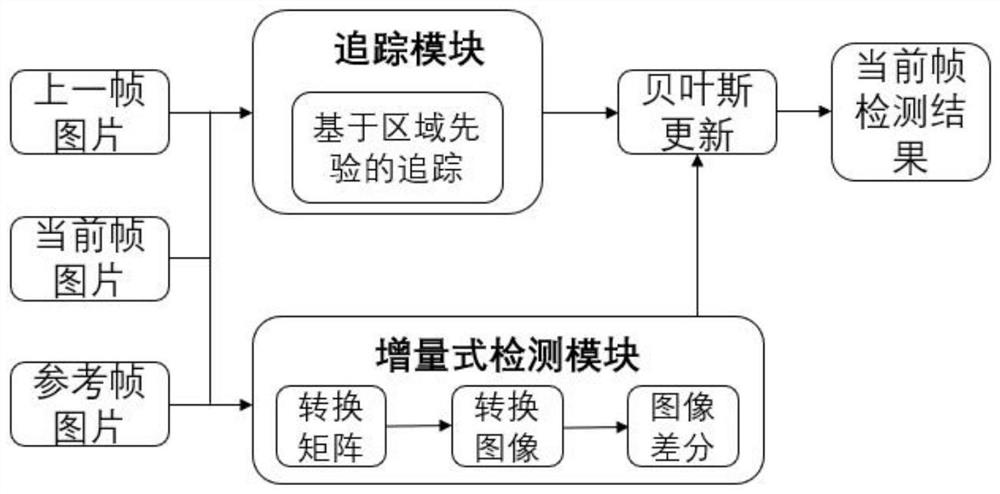

图1是本发明实施例的图片动态区域检测模型示意图;

图2是本发明实施例的动态环境下移动机器人视觉定位示意图;

图3a、3b、3c是本发明实施例的追踪动态区域示意图。

图4a、4b、4c、4d是本发明实施例的得到动态物体的位置示意图。

图5a、5b是本发明实施例的得到最终的动态区域示意图。

具体实施方式

下面对照附图并结合优选的实施方式对本发明作进一步说明。需要说明的是,在不冲突的情况下,本申请中的实施例及实施例中的特征可以相互组合。

需要说明的是,本实施例中的左、右、上、下、顶、底等方位用语,仅是互为相对概念,或是以产品的正常使用状态为参考的,而不应该认为是具有限制性的。

本实施例所要解决的技术问题包括:

(1)输入图片的动态区域检测的问题;

(2)利用帧间的序列关系检测图片实时特性的问题;

(3)动态区域检测与现有定位模块集成的问题。

本实施例的技术问题通过以下的技术方案予以解决:

第一方面,本申请实施例提供了一图片动态区域检测系统,可以包括跟踪模块,增量式检测模块和贝叶斯更新模块;

所述跟踪模块,通过利用输入视频帧间的序列信息关系,追踪动态区域。一旦动态区域确定,将作为下一帧图片的输入,通过特征追踪匹配,得到下一帧相应的动态区域;

所述增量式检测模块,利用了动态区域中帧间的差异信息来获取目前帧的状态。通过设置参考帧与有效阈值,得到当前帧的动态特性;

所述贝叶斯更新模块通过融合跟踪模块和增量式检测模块,既考虑了视频的序列信息,又考虑了物体运动所带来的帧间差异,从而得到最终的动态区域。

第二方面,本申请实施例提供了一种动态环境精确定位模型,可以包括:视觉同时定位与建图模块和稳定特征点提取模块;

所述视觉定位与建图模块提供了移动机器人最基本的定位技术,包括数据关联,图优化和回环检测。

所述稳定特征点提取模块通过检测到的动态区域信息以及纹理信息,有选择的分配每个区域的特征点采集数量,一方面保证了数据的丰富性,另一方面提高了信息的稳定性。

如图1所示,本申请实施例提供了一图片动态区域检测系统,可以包括跟踪模块,增量式检测模块和贝叶斯更新模块;

所述跟踪模块,通过利用输入视频帧间的序列信息关系,追踪动态区域。一旦动态区域确定,将作为下一帧图片的输入,通过特征追踪匹配,得到下一帧相应的动态区域。跟踪模块的输入包括当前帧和上一帧。对于上一帧图片,动态区域是作为先验知识。是由于,一旦当前帧的动态区域确定,也会作为上一帧输入到下一幅图片。系统每输入一张图片,首先将其栅格化,然后针对上一帧的动态区域进行特征提取。特征提取之后,我们使用光流模型追踪这些特征点到当前帧,得到与之匹配的特征点。同时,我们利用一个规律:特征对之间的坐标差异不会太大,从而剔除错误匹配。最终,我们通过栅格中追踪到的特征点的数量来确定当前帧的动态区域。如图3a、3b、3c所示。

所述增量式检测模块,利用了动态区域中帧间的差异信息来获取目前帧的状态。通过设置参考帧与有效阈值,得到当前帧的动态特性。造成两帧之间差异的原因有两个,相机运动和动态物体的运动。因此,为了有效得到由于动态物体运动所造成的差异,我们首先恢复两帧之间的位姿。通过计算出两帧之间的转换矩阵,我们将上一帧图片投射到当前帧,然后通过比对两帧之间的差异,从而得到动态物体的位置。如图4a、4b、4c、4d所示。

所述贝叶斯更新模块通过融合跟踪模块和增量式检测模块,既考虑了视频的序列信息,又考虑了物体运动所带来的帧间差异,从而得到最终的动态区域。如图5a、5b所示。

如图2所示,本申请实施例提供了一种动态环境精确定位模型,可以包括:视觉同时定位与建图模块和稳定特征点提取模块;其中,本方法的新颖之处在于对于输入图片进行动态区域检测以及根据检测结果进行权重化静态特征提取。

所述视觉定位与建图模块提供了移动机器人最基本的定位技术,包括数据关联,图优化和回环检测。

所述稳定特征点提取模块通过检测到的动态区域信息以及纹理信息,有选择的分配每个区域的特征点采集数量,一方面保证了数据的丰富性,另一方面提高了信息的稳定性。

以上内容是结合具体的优选实施方式对本发明所作的进一步详细说明,不能认定本发明的具体实施只局限于这些说明。对于本发明所属技术领域的技术人员来说,在不脱离本发明构思的前提下,还可以做出若干等同替代或明显变型,而且性能或用途相同,都应当视为属于本发明的保护范围。

- 一种动态环境下的移动机器人图像视觉定位方法

- 一种在高动态环境下的工业移动机器人定位方法